一. Softmax函数介绍

1. 函数表达式

Softmax函数是一种用于多分类问题的激活函数,它将一个n维向量转换为一个概率分布。每个元素的值被转化为0到1之间的数值,并且这些数值的总和为1。这使得Softmax函数特别适合用于神经网络的输出层,以表示各个类别的概率。函数表达式如下:

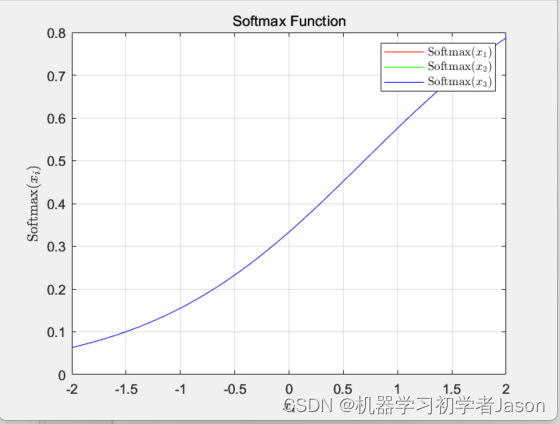

2. 函数图像

函数的特征:

- 概率分布:Softmax函数的输出是一个概率分布,所有输出的和为1。

- 非线性转换:Softmax函数将线性输入转化为非线性输出,有助于多分类任务。

- 差异放大:由于指数函数的作用,Softmax放大了输入向量中较大的值,使其概率更接近1,而较小的值概率接近0。

- 可微性:Softmax函数是可微的,便于在反向传播过程中计算梯度。

-

二. Softmax函数的应用

- 多分类问题:Softmax函数最常用于多分类问题的输出层。在这种情况下,Softmax将网络的输出转换为每个类别的概率分布。例如,在图像分类中,Softmax可以用于确定图像属于哪个类别。

- 概率预测:Softmax函数的输出可以直接解释为概率值,这使得它在需要概率预测的任务中非常有用。

- 神经网络模型:在深度学习模型中,尤其是卷积神经网络(CNN)和循环神经网络(RNN),Softmax通常用于最后一层,以输出各个类别的概率。

Softmax函数的优点

- 输出可解释性强:Softmax函数的输出是概率分布,每个值都在0到1之间,并且所有值的总和为1,这使得输出结果易于解释。

- 稳定的梯度计算:Softmax函数在结合交叉熵损失函数时,能够稳定地计算梯度,适用于反向传播算法。

- 归一化输出:Softmax将输入值归一化,保证输出值的范围在(0,1)之间,方便后续的处理和决策。

Softmax函数的缺点

- 计算复杂度高:Softmax函数需要计算指数和归一化,这在处理非常大的输入向量时计算开销较大。

- 数值不稳定性:在某些情况下,如果输入值非常大或非常小,指数函数可能会导致数值不稳定。通常通过减去最大值来稳定计算。

- 类别不平衡问题:在处理类别不平衡的数据时,Softmax可能会对多数类别产生偏差,需要特殊处理(如调整损失函数或使用加权Softmax)。

总结

Softmax函数在多分类任务中有着广泛的应用,其输出易于解释,适用于概率预测,但在处理大规模输入和类别不平衡问题时可能会遇到挑战。理解其优缺点有助于在具体应用中更好地使用和优化神经网络模型。

Softmax函数详解

Softmax函数详解

2404

2404

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?