自注意力机制(self-attention)

首先,其核心思想为:

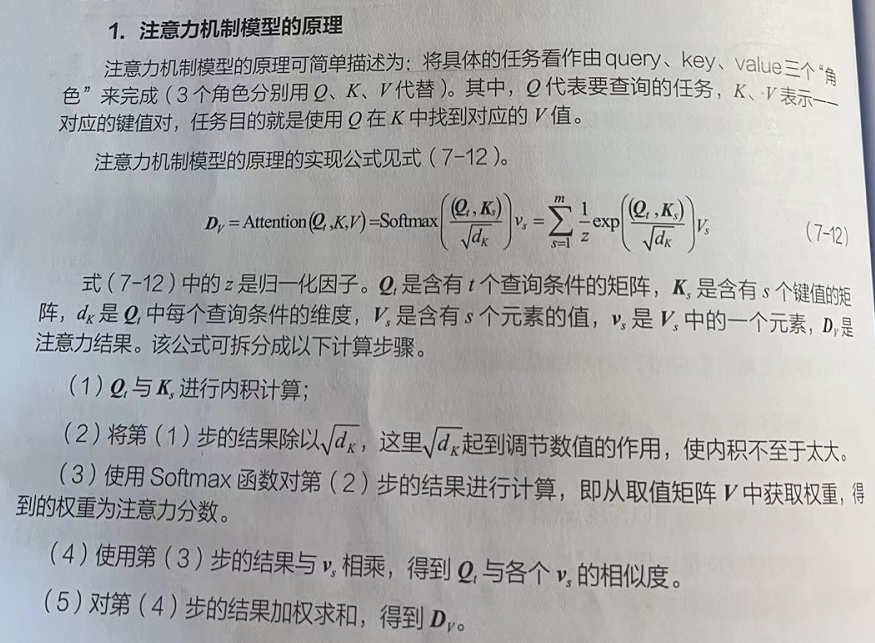

其中,Q为query, ,即查询、要查询的信息

K为key, ,即索引、被查询的向量

V为value, ,即值、查询到的内容

dk代表k的维度,除以k的维度的平方根,使训练时的梯度保持稳定

Q,K,V都是输入x经过经过线性变换得到的,和它们分别相乘的三个矩阵W是通过学习得到的矩阵,使用这样的线性变换可以提高的模型的拟合能力

举一个例子

有一个渣男,他有 n 个备胎,他想要从自己的备胎里寻找最符合自己期望的,好分配注意力和管理时间

用 Q 表示择偶标准,K表示自身条件,V表示被

自注意力机制是深度学习中的关键概念,用于比较和加权输入信息。通过查询(Q)、键(K)和值(V)的相互作用,模型能够识别相关特征。例如,一个渣男在选择备胎时,会根据自己的择偶标准(Q)对比备胎的条件(K),计算相似度,并据此分配注意力(V)。点乘运算衡量向量的相似度,通过归一化权重矩阵,确定对每个备胎的关注程度。这一机制在自然语言处理等领域广泛应用,增强了模型的表达能力。

自注意力机制是深度学习中的关键概念,用于比较和加权输入信息。通过查询(Q)、键(K)和值(V)的相互作用,模型能够识别相关特征。例如,一个渣男在选择备胎时,会根据自己的择偶标准(Q)对比备胎的条件(K),计算相似度,并据此分配注意力(V)。点乘运算衡量向量的相似度,通过归一化权重矩阵,确定对每个备胎的关注程度。这一机制在自然语言处理等领域广泛应用,增强了模型的表达能力。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?