《深度学习视频理解》记录

动作识别

个人读书记录,方便以后查阅。

传统算法

VLAD(Vector of Locally Aggregated Descriptor局部聚合描述向量) 将所有特征划分成多个聚类,对聚类内的特征汇合,将所有汇合的特征拼接成一个全局特征向量(特征聚类+特征分配+差值求和)。

HOG(Histogram of Oriented Gradient 方向梯度直方图)

HOF(Histogram of Optical Flow 光流直方图)

MBH(Motion Boundary Histogram 运动边界直方图)

Bag of Features(将图像视为由多个局部特征组成的集合,类似于文档中的词汇)

FisherVector(提取特征后,训练出高斯混合模型GMM,聚合对应的偏导数并归一化得到特征的统计信息)

Optical Flow光流法:计算视频沿水平、垂直和时间方向的梯度,反应了物体运动情况。基于亮度恒定假设。Lucas-Kanade方法,加入邻域光流相似假设。主流光流算法如TV-L1,深度学习后有FlowNet,FlowNet2.0。可视化要用两张图表示运动信息,用箭头或者不同颜色就可以用一张图表示。

传统动作识别算法DT(Dense Trajectories) 1)不同空间尺度密集采样特征点 2)特征点轨迹跟踪 3)特征提取(HOG/HOF/MBH/特征点位移向量) 4)特征编码+SVM分类

iDT DT+对相机运动估计(假设相邻帧变化小,用投影矩阵估计相邻帧关系,用人体检测器避免人的动作影响)+改进特征规范化方式 + Bag of Feature->Fisher Vector

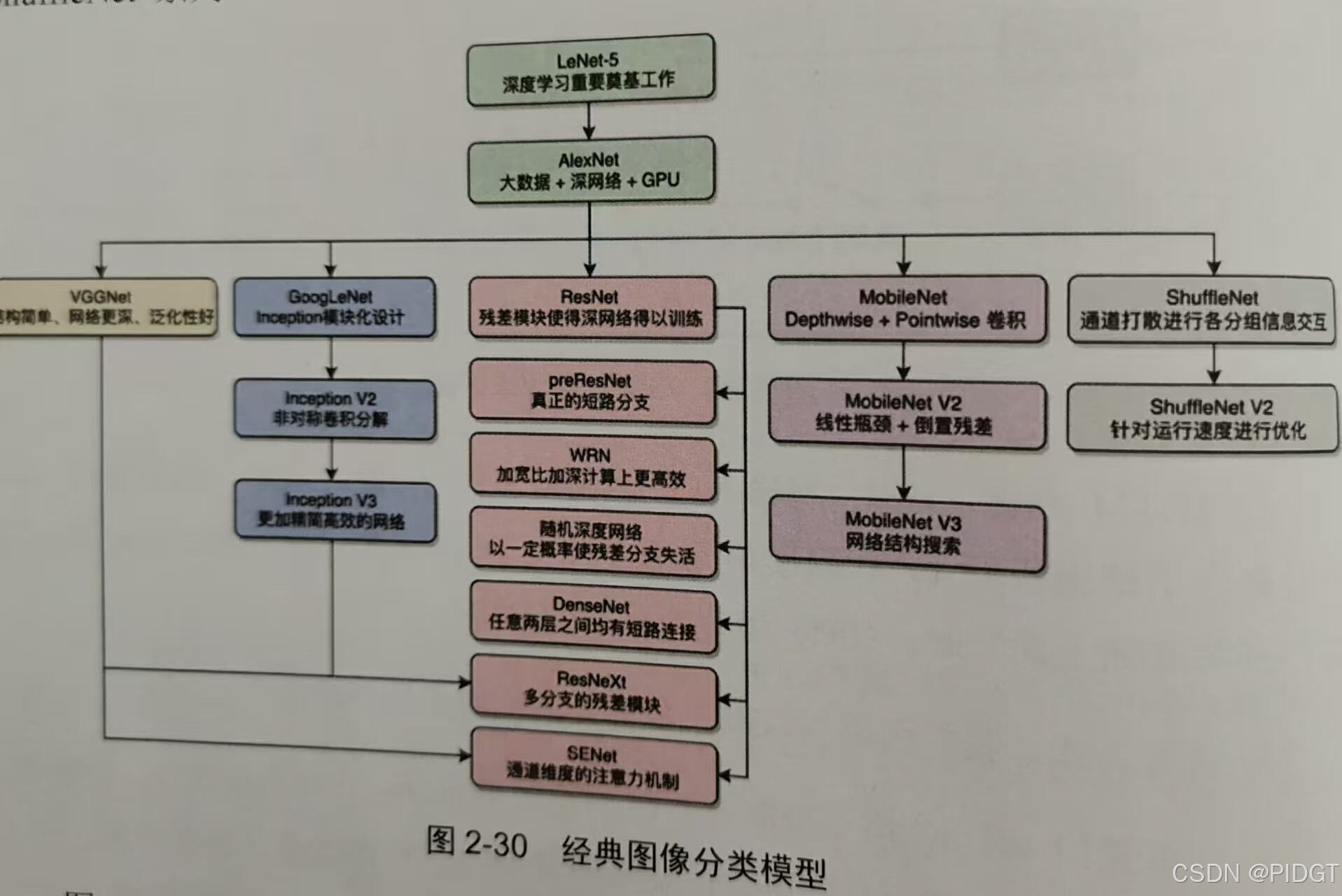

经典网络结构回顾

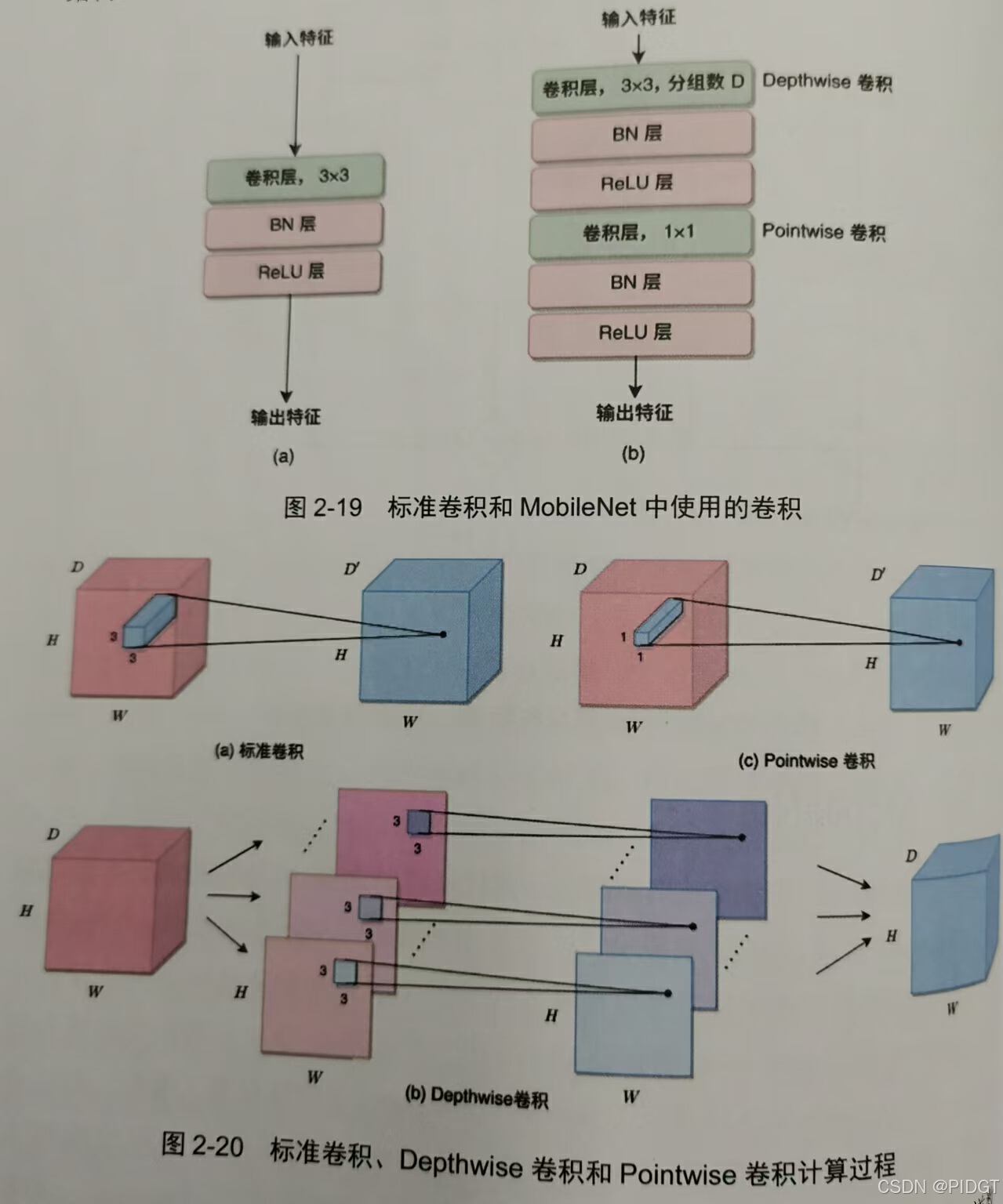

MobileNet:将一个D组标准的3x3卷积替换成一个Depthwise+一个Pointwise

参数量:9D^2 参数量9D 参数量D ^2

计算量:9D^2HW 计算量9DHW 计算量D ^2 HW

当D>>9,mobilnet的卷积 / 标准卷积=1/D+1/9(参数量和计算量都是,比值大概是1/9)

MobileNetv2: Pointwi

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

36万+

36万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?