【机器学习】广义回归神经网络(GRNN)的python实现

一、广义回归神经网络原理

1.1、GRNN与PNN的关系

广义回归神经网络(Generalized Regression Neural Network)的网络结构类似于RBF神经网络。与概率神经网络(PNN)相同,GRNN也是一个前向传播的网络,不需要反向传播求模型参数;不同的是GRNN用于求解回归问题,而PNN用于求解分类问题。关于GRNN的数学原理可以参考资料【1】。

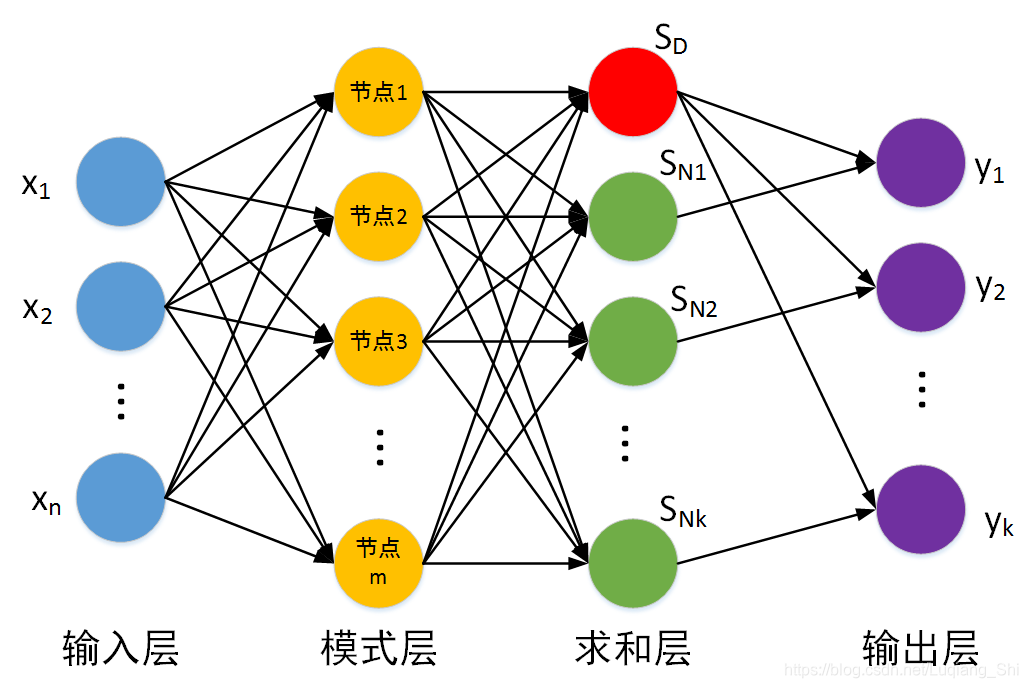

2.2、GRNN的网络结构

如下图所示,GRNN与PNN一样也是一个四层的网络结构。

对于回归问题训练数据集包括样本特征集与标签集,假设样本特征集为: { t r x 1 , t r x 2 , ⋯   , t r x m } \left\{ {tr{x_1},tr{x_2}, \cdots ,tr{x_m}} \right\} {

trx1,trx2,⋯,trxm},每一个样本的维度为 n n n,即 t r x i = [ x 1 , x 2 , ⋯   , x n ] tr{x_i} = [{x_1},{x_2}, \cdots ,{x_n}] trxi=[x1,x2,⋯,xn]。标签集为: { t r y 1 , t r y 2 , ⋯   , t r y m } \left\{ {tr{y_1},tr{y_2}, \cdots ,tr{y_m}} \right\} {

try1,try2,⋯,trym},每一个标签的维度为 k k k,即 t r y i = [ y 1 , y 2 , ⋯   , y k ] tr{y_i} = [{y_1},

本文介绍了广义回归神经网络(GRNN)的基本原理,包括其与PNN的关系和网络结构。GRNN作为回归问题的解决方案,具有快速收敛和非线性逼近的优点,但也存在计算复杂度高的问题。文章提供了GRNN的Python实现,并使用sine函数数据集进行演示,展示了如何计算模式层、求和层和输出层。

本文介绍了广义回归神经网络(GRNN)的基本原理,包括其与PNN的关系和网络结构。GRNN作为回归问题的解决方案,具有快速收敛和非线性逼近的优点,但也存在计算复杂度高的问题。文章提供了GRNN的Python实现,并使用sine函数数据集进行演示,展示了如何计算模式层、求和层和输出层。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

320

320

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?