为什么可以ReLU 加速训练(梯度不饱和),缓解梯度消失问题。

ReLU(Rectified Linear Unit,修正线性单元)是一种常用的激活函数,其定义为 $ f(x) = \max(0, x) $。在深度学习中,ReLU 能够加速训练并缓解梯度消失问题,主要原因在于其数学特性和对梯度的影响。以下是详细解释:

1. ReLU 的定义和特性

-

定义

f(x)=max(0,x) f(x) = \max(0, x) f(x)=max(0,x)- 如果输入 $ x \geq 0 $,输出为 $ x $;

- 如果输入 $ x < 0 $,输出为 0。

-

导数

f′(x)={1,if x>00,if x≤0 f'(x) = \begin{cases} 1, & \text{if } x > 0 \\ 0, & \text{if } x \leq 0 \end{cases} f′(x)={1,0,if x>0if x≤0- 对于 $ x > 0 $,导数为 1;

- 对于 $ x \leq 0 $,导数为 0(在 $ x = 0 $ 处导数不连续,但在实践中通常定义为 0 或 1)。

-

特性

- 非线性:ReLU 引入了非线性,使网络能够学习复杂的非线性模式。

- 稀疏性:ReLU 将负值置为 0,导致部分神经元输出为 0,增加了网络的稀疏性(sparsity),有助于减少过拟合。

- 简单计算:ReLU 的计算非常简单(仅需比较和取最大值),比 sigmoid 或 tanh 的指数运算更快。

2. 为什么 ReLU 可以加速训练?

ReLU 加速训练的原因主要与以下几点有关:

2.1 梯度不饱和(Gradient Non-Saturation)

-

传统激活函数的问题

-

传统激活函数如 sigmoid 和 tanh 存在梯度饱和问题:

-

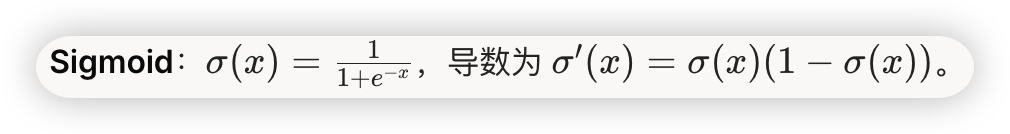

Sigmoid

-

- 当 $ x $ 很大或很小(例如 $ |x| > 5 )时,)时,)时, \sigma(x) $ 接近 0 或 1,导数 $ \sigma’(x) $ 接近 0。

-

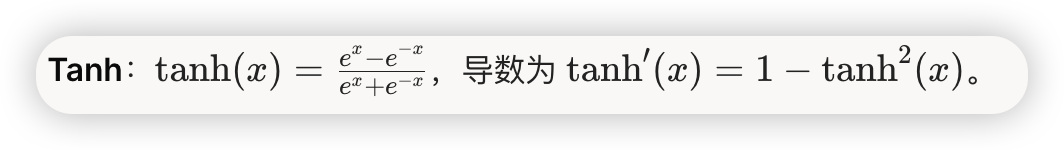

Tanh

- 类似地,当 $ |x| $ 很大时,$ \tanh(x) $ 接近 ±1,导数接近 0。

-

-

这种梯度饱和导致梯度在反向传播时变得非常小,尤其在深层网络中,梯度会逐渐消失(梯度消失问题),使参数更新非常缓慢。

-

-

ReLU 的优势

- 对于 $ x > 0 $,ReLU 的导数恒为 1,不会发生梯度饱和。

- 只要输入 $ x $ 是正值,梯度就不会因为激活函数而变小,保持了梯度的稳定性。

- 相比 sigmoid 和 tanh,ReLU 在正值区域的梯度始终为 1,避免了梯度在反向传播中的指数衰减,从而加速了梯度下降的收敛。

2.2 避免梯度消失问题

- 梯度消失问题

- 在深层网络中,梯度通过链式法则逐层反向传播: ∂L∂w=∂L∂a⋅∂a∂z⋅∂z∂w\frac{\partial L}{\partial w} = \frac{\partial L}{\partial a} \cdot \frac{\partial a}{\partial z} \cdot \frac{\partial z}{\partial w}∂w∂L=∂a∂L⋅∂z∂a⋅∂w∂z 其中 $ \frac{\partial a}{\partial z} $ 是激活函数的导数。

- 如果激活函数的导数很小(例如 sigmoid 在饱和区域的导数接近 0),梯度会在每一层成倍缩小,经过多层后几乎消失,导致深层网络的参数无法有效更新。

- ReLU 的作用

- 对于 $ x > 0 $,ReLU 的导数为 1,梯度不会因为激活函数而缩小。

- 只要网络中有部分神经元的输入是正值,梯度就能通过这些神经元有效传播到前层,避免了梯度消失问题。

- 即使某些神经元的输入 $ x \leq 0 $,导数为 0(梯度为 0),也不会导致整个网络的梯度消失,因为其他正值神经元仍能传播梯度。

2.3 稀疏性加速计算

- 稀疏性

- ReLU 将负值置为 0,导致部分神经元输出为 0,增加了网络的稀疏性。

- 例如,在 AlexNet 中(参考第十九张图),ReLU 使许多神经元在训练过程中输出为 0,减少了后续层的计算量。

- 加速训练

- 稀疏性减少了需要计算的神经元数量,降低了前向传播和反向传播的计算成本。

- 稀疏性还使梯度更新更集中于活跃的神经元(输出非 0 的神经元),提高了训练效率。

2.4 简单计算

- 计算效率

- ReLU 的计算非常简单(仅需比较和取最大值),相比 sigmoid 和 tanh 的指数运算(例如 $ e^x $),计算成本更低。

- 在深层网络中,激活函数会被调用无数次,ReLU 的简单性显著减少了训练时间。

3. ReLU 在 AlexNet 中的应用

- AlexNet 的创新

- AlexNet 首次大规模使用 ReLU 激活函数(图中标注为“ReLU”)。

- 相比 LeNet-5 的 sigmoid/tanh(参考第十九张图),ReLU 显著加速了训练:

- AlexNet 的参数数量为 60M(6000万),远大于 LeNet-5 的 60K(6万)。

- 如果使用 sigmoid/tanh,梯度消失问题会使训练非常缓慢,甚至无法收敛。

- 效果

- ReLU 使 AlexNet 能够在合理的时间内完成训练(2012 年使用两块 GPU)。

- 在 ImageNet 数据集上,AlexNet 取得了 top-5 错误率 15.3% 的突破性成果,远低于传统方法。

4. ReLU 的局限性及改进

尽管 ReLU 有显著优势,但也存在一些问题:

- 死神经元问题(Dying ReLU)

- 当输入 $ x \leq 0 $,ReLU 的导数为 0,导致这些神经元在训练过程中无法更新(“死亡”)。

- 如果学习率过高或输入数据分布不佳,可能导致大量神经元“死亡”,降低网络的表达能力。

- 改进方法

- Leaky ReLU:$ f(x) = \max(\alpha x, x) $,其中 $ \alpha $ 是一个小的正数(例如 0.01),允许负值区域有非零梯度。

- Parametric ReLU (PReLU):将 $ \alpha $ 作为可学习的参数。

- ELU (Exponential Linear Unit):在负值区域使用指数函数,平滑过渡。

5. 总结

ReLU 加速训练并缓解梯度消失问题的原因:

- 梯度不饱和:对于 $ x > 0 $,导数恒为 1,避免了梯度在正值区域的衰减。

- 缓解梯度消失:梯度在正值区域保持稳定,能有效传播到前层。

- 稀疏性:负值置为 0,减少计算量,提高训练效率。

- 简单计算:ReLU 的计算成本低,适合深层网络。

在 AlexNet 中,ReLU 的使用显著加速了训练,使深度网络(8层,60M 参数)能够在 2012 年的计算资源下完成训练,取得了突破性成果。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?