1.网络总体结构

Mask2former是一种基于Transformer的神经网络模型,可用于语言建模、机器翻译、文本生成等NLP任务。其原理是将输入序列中的一部分词汇(称为“掩码”)替换成特殊的掩码标记,然后利用Transformer来预测这些掩码标记所代表的词汇。这个过程可以看作是一种填空题,模型需要根据上下文来推断并填写正确的词汇。在模型训练过程中,通过对不同数量和位置的掩码进行预测和评估,可以有效地提高模型的表现能力。整个模型的训练过程分为两个阶段,第一阶段是利用掩码预测生成目标序列,第二阶段则是利用已生成的序列来预测掩码,从而让生成的序列更加符合原始文本的内容和语法结构。

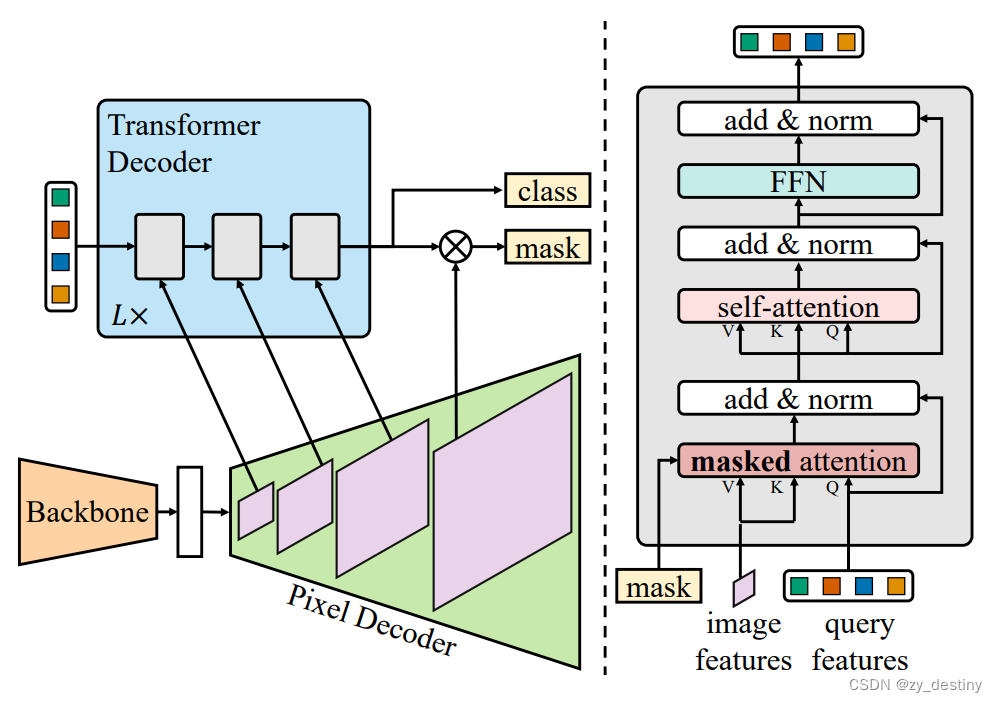

Mask2Former网络结构如上图所示,和mask-rcnn一样,mask2former采用mask classification的方式来进行分割。mask-rcnn和mask2former在如何生产二值mask上的做法不同。mask-rcnn是通过bounding boxes的方式来表示,使得mask-rcnn无法进行semantic segmentaion任务。而Mask2Former参考了Detr的做法,将这些二值mask用一组C维的特征向量来表示(object query),这样就可以用transformer decoder,通过一组固定的query来进行训练。

2.Mask2Former主要创新点

Mask2Former是一种新型的图像分割模型,其创新点主要包括以下几个方面:

使用Transformer结构进行图像分割:Mask2Former采用了Transformer结构来捕获图像中的全局关系,避免了传统卷积神经网络(CNN)在处理大量像素时出现的信息丢失问题。

<

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?