原创 | 文 BFT机器人

01

“卷积网络之父”杨立昆谈人工智能

今年GPT爆火以后,杨立昆化身“杠精”。从提出“GPT系统将很快被抛弃”的观点,到回怼特斯拉创始人马斯克“延缓大模型研究和开发是一种新的模糊主义,没有任何意义”,杨立昆的言论引发了激烈的讨论。

在今年6月的智源大会上,杨立昆教授做了精彩的线上演讲,题目为“从机器学习到自主智能:朝向能够学习、推理和规划的机器进发”。在演讲中,他提出了未来人工智能将面临的三大挑战:1、学习表征并预测世界的模型;2、学会推理;3、学习规划复杂的行动序列。

而他认为战胜这些挑战的答案就是“世界模型”,通过世界模型,未来人工智能可以真正的理解这个世界,并预测和规划未来。通过成本核算模块,结合一个简单的需求(一定按照最节约行动成本的逻辑去规划未来),它就可以杜绝一切潜在的毒害和不可靠性。虽然这一方案目前还没有形成完整可行的系统,但也具有了一些初步的研究成果。杨立昆认为这是人工智能领域下一个十年的重要研究方向。

杨立昆是法国计算机科学家、Facebook首席人工智能科学家、纽约大学教授,在人工智能领域极富盛名。作为 2018 年的图灵奖得主之一,杨立昆与杰弗里・辛顿、约书亚・本吉奥并成为“深度学习三巨头”。他大幅完善了卷积神经网络(CNN),并将其用于计算机视觉领域,极大地拓宽了应用范围,被誉为“卷积网络之父”。

02

深度学习领域的里程碑之一:LeNet-5的开发

近年来,神经网络热度较高,许多 AI 应用都离不开 “三巨头” 构建的深度学习理论基础和指导框架。但在 20 多年前,计算机学界和产业界都对它完全提不起兴趣,甚至是嗤之以鼻。在长达近 15 年的神经网络 “寒冬” 里,学术会议多次拒收神经网络论文,也没人愿意公开支持。

上世纪八十年代末,杨立昆和本吉奥以及其他组员进入了当时美国电信巨头AT&T所属的实验室──AT&T贝尔实验室。在这里,他和他的组员将反向传播算法应用在卷积神经网路上,这种进阶版的人工神经网路,可以自动寻找数据中的模式和表征,适合应用在图像与文字的识别上。在这个基础上,他们成功开发出拥有 6.4 万个连接的 LeNet 卷积神经网络,并成功研发出升级版——拥有34万个连接的LeNet-5,将其部署到银行支票数字读取系统,最终应用在美国和法国的许多自动取款机上。这是卷积网络的首次商业应用,直至20 世纪 90 年代末,美国所有支票的10%-20%都是它处理的。

03

LeNet-5的基本原理

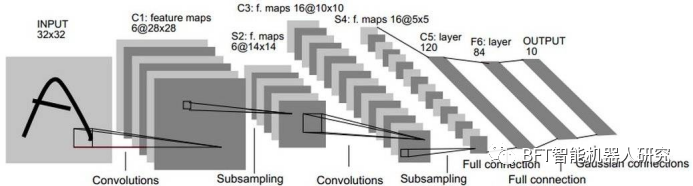

卷积神经网络是一种深度学习架构,主要分为三个部分:卷积层、池化层和全连接层。卷积神经网络的核心是卷积层,它运算的目的是提取输入的不同特征;池化层用于降低特征图的空间分辨率,并增强模型对输入图像的平移不变性和鲁棒性;全连接层能够整合卷积层或者池化层中具有类别区分性的局部信息。

LeNet-5的基本结构包含7层网络结构(不含输入层),它具有2个卷积层、2个降采样层(池化层)、2个全连接层和输出层。

04

LeNet-5的贡献

LeNet-5在当时的手写数字识别任务中拥有高达98%以上的准确率,它的成功也吸引了更多研究者加入到深度学习的研究中。同时,LeNet-5也为AlexNet、VGG、ResNet等更加复杂的卷积神经网络奠定了基础。

如今,卷积神经网络已经席卷计算机视觉、语音识别、语音合成、图像合成和自然语言处理领域,成为行业标准。杨立昆也因深度学习的研究贡献,与杰弗里・辛顿、约书亚・本吉奥共同获得了2018年计算机科学最高荣誉图灵奖。

作者 | 小河

排版 | 居居手

更多精彩内容请关注公众号:BFT机器人

本文为原创文章,版权归BFT机器人所有,如需转载请与我们联系。若您对该文章内容有任何疑问,请与我们联系,将及时回应。

著名AI科学家杨立昆在演讲中提出,人工智能面临的三大挑战包括学习世界模型、推理和规划。他强调世界模型对于理解世界的重要性,并提到LeNet-5在深度学习历史上的突破。杨立昆与图灵奖有关,深度学习领域正在向着更高级别的自主智能发展。

著名AI科学家杨立昆在演讲中提出,人工智能面临的三大挑战包括学习世界模型、推理和规划。他强调世界模型对于理解世界的重要性,并提到LeNet-5在深度学习历史上的突破。杨立昆与图灵奖有关,深度学习领域正在向着更高级别的自主智能发展。

1160

1160

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?