FROM

- 🍨 本文为🔗365天深度学习训练营 中的学习记录博客

- 🍖 原作者:K同学啊

我的环境

- 语言环境:Python 3.11.9

- 开发工具:Jupyter Lab

- 深度学习环境:

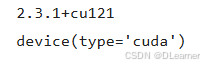

- torch==2.3.1+cu121

- torchvision==0.18.1+cu121

1. 准备知识

1.1 检查环境

import torch # 导入PyTorch库,用于构建深度学习模型

import torch.nn as nn # 导入torch.nn模块,包含构建神经网络所需的类和函数

import matplotlib.pyplot as plt # 导入matplotlib.pyplot模块,用于数据可视化

import torchvision # 导入torchvision库,包含处理图像和视频的工具和预训练模型

# 设置硬件设备,如果有GPU则使用,没有则使用cpu

device = torch.device("cuda" if torch.cuda.is_available() else "cpu") # 检查系统是否有可用的GPU,如果有则使用GPU,否则使用CPU

print(torch.__version__) # 输出torch版本

device # 打印当前设备,以确认是使用GPU还是CPU

输出:

1.2 数据导入

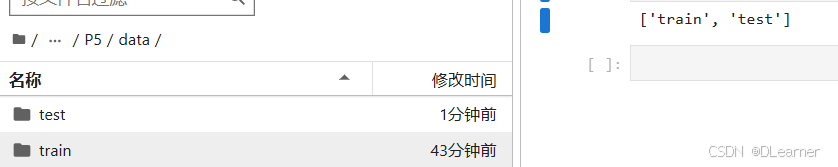

导入本地数据

# 导入必要的库

import os, PIL, random, pathlib

# 设置数据目录路径

data_dir = './data/'

data_dir = pathlib.Path(data_dir)

# 获取数据目录下的所有文件路径

data_paths = list(data_dir.glob('*'))

# 提取每个文件路径中的类别名称

# 假设文件路径的结构是:'./data/类别名称/文件名'

# 这里使用列表推导式来创建类别名称的列表

classeNames = [str(path).split("/")[1] for path in data_paths if path.is_dir()]

# 输出类别名称列表

print(classeNames)

输出:

# 引入torchvision库中的transforms模块,该模块包含多种图像预处理功能

from torchvision import transforms

from torchvision.datasets import ImageFolder

from torchvision import datasets

# 定义训练数据的预处理步骤

train_transforms = transforms.Compose([

# 使用Resize变换,将输入图片调整至224x224像素的统一尺寸,以适配模型输入要求

transforms.Resize([224, 224]),

# 将PIL Image或numpy.ndarray格式的图片转换为PyTorch Tensor,并归一化到[0,1]区间

transforms.ToTensor(),

# 标准化处理,将Tensor转换为标准正态分布(高斯分布),使模型训练更容易收敛

# 这里使用的均值(mean)和标准差(std)是针对ImageNet数据集计算得到的,常用于预训练模型

transforms.Normalize(

mean=[0.485, 0.456, 0.406],

std=[0.229, 0.224, 0.225])

])

# 定义测试数据的预处理步骤,与训练数据预处理步骤相同

test_transforms = transforms.Compose([

# 使用Resize变换,将输入图片调整至224x224像素的统一尺寸

transforms.Resize([224, 224]),

# 将PIL Image或numpy.ndarray格式的图片转换为PyTorch Tensor,并归一化到[0,1]区间

transforms.ToTensor(),

# 标准化处理,使用与训练数据相同的均值和标准差

transforms.Normalize(

mean=[0.485, 0.456, 0.406],

std=[0.229, 0.224, 0.225])

])

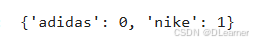

# 使用ImageFolder类加载训练数据集,指定数据集路径和预处理步骤

# "./data/train/"是训练数据集的路径,transform参数应用train_transforms定义的预处理步骤

train_dataset = datasets.ImageFolder("./data/train/", transform=train_transforms)

# 使用ImageFolder类加载测试数据集,指定数据集路径和预处理步骤

test_dataset = datasets.ImageFolder("./data/test/", transform=test_transforms)

train_dataset.class_to_idx

输出:

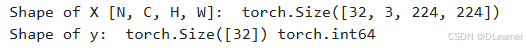

# 设置批量大小

batch_size = 32

# 创建训练数据加载器

train_dl = torch.utils.data.DataLoader(train_dataset,

batch_size=batch_size,

shuffle=True,

num_workers=1)

# 创建测试数据加载器

test_dl = torch.utils.data.DataLoader(test_dataset,

batch_size=batch_size,

shuffle=True,

num_workers=1)

# 遍历测试数据加载器,打印第一个批次的输入和标签的形状

for X, y in test_dl:

print("Shape of X [N, C, H, W]: ", X.shape)

print("Shape of y: ", y.shape, y.dtype)

break

输出:

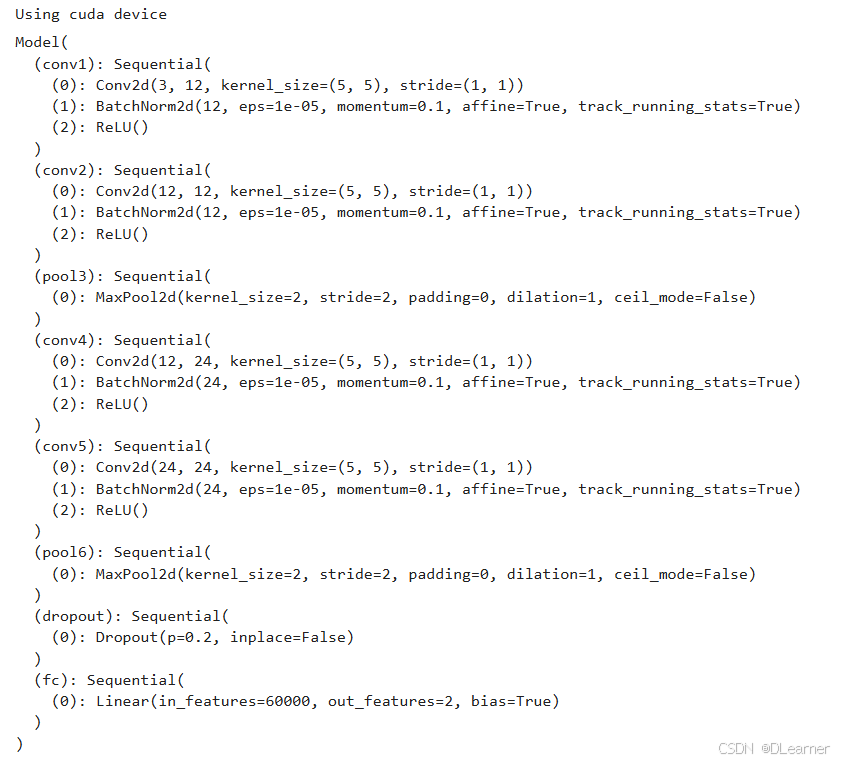

2. 构建简单的CNN网络

![[图片]](https://i-blog.csdnimg.cn/direct/604d4cbfd1c4407dac11052499944efb.png)

import torch.nn.functional as F

class Model(nn.Module):

def __init__(self):

super(Model, self).__init__()

# 第一个卷积层,输入通道数为3(RGB图像),输出通道数为12,卷积核大小为5x5,不添加padding

self.conv1 = nn.Sequential(

nn.Conv2d(3, 12, kernel_size=5, padding=0), # 输出特征图尺寸:12*(220-5+2*0)=12*220

nn.BatchNorm2d(12), # 批量归一化

nn.ReLU()) # 激活函数

# 第二个卷积层,输入通道数为12,输出通道数为12

self.conv2 = nn.Sequential(

nn.Conv2d(12, 12, kernel_size=5, padding=0), # 输出特征图尺寸:12*(216-5+2*0)=12*216

nn.BatchNorm2d(12), # 批量归一化

nn.ReLU()) # 激活函数

# 最大池化层,池化窗口大小为2x2

self.pool3 = nn.Sequential(

nn.MaxPool2d(2)) # 输出特征图尺寸:12*(108-2+2*0)/2=12*108

# 第三个卷积层,输入通道数为12,输出通道数为24

self.conv4 = nn.Sequential(

nn.Conv2d(12, 24, kernel_size=5, padding=0), # 输出特征图尺寸:24*(104-5+2*0)=24*104

nn.BatchNorm2d(24), # 批量归一化

nn.ReLU()) # 激活函数

# 第四个卷积层,输入通道数为24,输出通道数为24

self.conv5 = nn.Sequential(

nn.Conv2d(24, 24, kernel_size=5, padding=0), # 输出特征图尺寸:24*(100-5+2*0)=24*100

nn.BatchNorm2d(24), # 批量归一化

nn.ReLU()) # 激活函数

# 第二个最大池化层,池化窗口大小为2x2

self.pool6 = nn.Sequential(

nn.MaxPool2d(2)) # 输出特征图尺寸:24*(50-2+2*0)/2=24*50

# Dropout层,丢弃率为0.2

self.dropout = nn.Sequential(

nn.Dropout(0.2))

# 全连接层,输入特征数为24*50*50,输出特征数为类别数(需要定义classeNames)

self.fc = nn.Sequential(

nn.Linear(24*50*50, len(classeNames))) # 这里的classeNames需要在外部定义

def forward(self, x):

# 前向传播过程

batch_size = x.size(0)

x = self.conv1(x) # 卷积-BN-激活

x = self.conv2(x) # 卷积-BN-激活

x = self.pool3(x) # 池化

x = self.conv4(x) # 卷积-BN-激活

x = self.conv5(x) # 卷积-BN-激活

x = self.pool6(x) # 池化

x = self.dropout(x) # Dropout

x = x.view(batch_size, -1) # 展平特征图,准备连接全连接层

x = self.fc(x) # 全连接层

return x

# 检查是否有可用的GPU,如果有则使用GPU,否则使用CPU

device = "cuda" if torch.cuda.is_available() else "cpu"

print("Using {} device".format(device))

# 实例化模型并将其发送到GPU或CPU

model = Model().to(device)

model

输出:

3. 模型训练

3.1 训练函数

# 训练循环

def train(dataloader, model, loss_fn, optimizer):

size = len(dataloader.dataset) # 训练集大小

num_batches = len(dataloader) # 批次数目, (size/batch_size,向上取整)

train_loss, train_acc = 0, 0 # 初始化累计训练损失和准确率

# 遍历数据加载器中的所有批次

for X, y in dataloader:

X, y = X.to(device), y.to(device) # 将特征和标签转移到GPU或CPU

# 前向传播

pred = model(X) # 使用模型进行预测

loss = loss_fn(pred, y) # 计算预测和真实标签之间的损失

# 反向传播和优化

optimizer.zero_grad() # 清零模型参数的梯度

loss.backward() # 反向传播,计算梯度

optimizer.step() # 根据梯度更新模型参数

# 记录准确率和损失

train_acc += (pred.argmax(1) == y).type(torch.float).sum().item() # 计算预测正确的样本数量

train_loss += loss.item() # 累加损失值

# 计算平均准确率和平均损失

train_acc /= size # 将累计准确率除以样本总数,得到平均准确率

train_loss /= num_batches # 将累计损失除以批次数量,得到平均损失

return train_acc, train_loss # 返回训练过程中的平均准确率和平均损失

3.2 测试函数

- 这个

test函数接收三个参数:dataloader、model和loss_fn。 - 它遍历

dataloader中的所有批次,对每个批次执行前向传播和损失计算,但不进行反向传播或参数更新,因为测试阶段的目的是评估模型性能,而不是训练模型。 - 在每个批次中,它计算模型的预测值

target_pred,然后使用损失函数loss_fn计算预测值和真实标签target之间的损失loss。 - 函数还记录了整个测试集上的平均准确率和平均损失。

def test(dataloader, model, loss_fn):

size = len(dataloader.dataset) # 获取测试数据集中的样本总数,例如CIFAR-10数据集有10000张图片

num_batches = len(dataloader) # 计算测试数据加载器中的批次数量

test_loss, test_acc = 0, 0 # 初始化累计测试损失和准确率

# 使用torch.no_grad()上下文管理器,停止梯度计算,因为在测试阶段不需要更新模型参数

with torch.no_grad():

for imgs, target in dataloader:

imgs, target = imgs.to(device), target.to(device) # 将图像和标签转移到GPU或CPU

# 前向传播,获取模型的预测输出

target_pred = model(imgs)

# 计算模型预测输出和真实标签之间的损失

loss = loss_fn(target_pred, target)

# 累加损失和准确率

test_loss += loss.item()

test_acc += (target_pred.argmax(1) == target).type(torch.float).sum().item()

# 计算平均准确率和平均损失

test_acc /= size # 将累计准确率除以样本总数,得到平均准确率

test_loss /= num_batches # 将累计损失除以批次数量,得到平均损失

return test_acc, test_loss # 返回测试过程中的平均准确率和平均损失

3.3 设置动态学习率

def test(dataloader, model, loss_fn):

size = len(dataloader.dataset) # 获取测试数据集中的样本总数,例如CIFAR-10数据集有10000张图片

num_batches = len(dataloader) # 计算测试数据加载器中的批次数量

test_loss, test_acc = 0, 0 # 初始化累计测试损失和准确率

# 使用torch.no_grad()上下文管理器,停止梯度计算,因为在测试阶段不需要更新模型参数

with torch.no_grad():

for imgs, target in dataloader:

imgs, target = imgs.to(device), target.to(device) # 将图像和标签转移到GPU或CPU

# 前向传播,获取模型的预测输出

target_pred = model(imgs)

# 计算模型预测输出和真实标签之间的损失

loss = loss_fn(target_pred, target)

# 累加损失和准确率

test_loss += loss.item()

test_acc += (target_pred.argmax(1) == target).type(torch.float).sum().item()

# 计算平均准确率和平均损失

test_acc /= size # 将累计准确率除以样本总数,得到平均准确率

test_loss /= num_batches # 将累计损失除以批次数量,得到平均损失

return test_acc, test_loss # 返回测试过程中的平均准确率和平均损失

# # 调用官方动态学习率接口时使用

# lambda1 = lambda epoch: (0.92 ** (epoch // 2))

# optimizer = torch.optim.SGD(model.parameters(), lr=learn_rate)

# scheduler = torch.optim.lr_scheduler.LambdaLR(optimizer, lr_lambda=lambda1) #选定调整方法

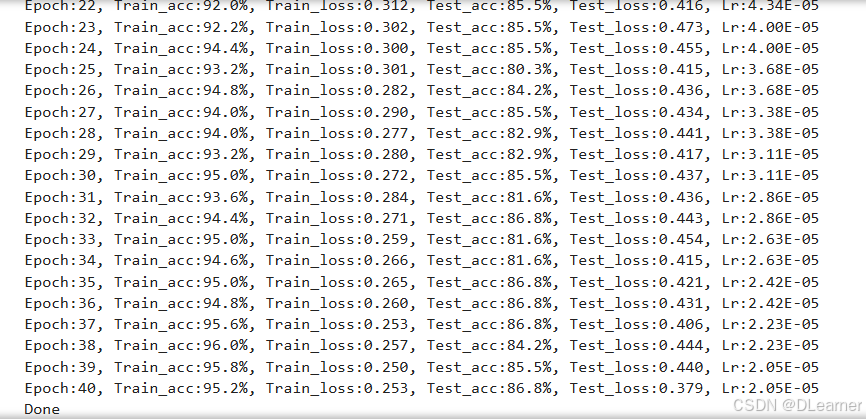

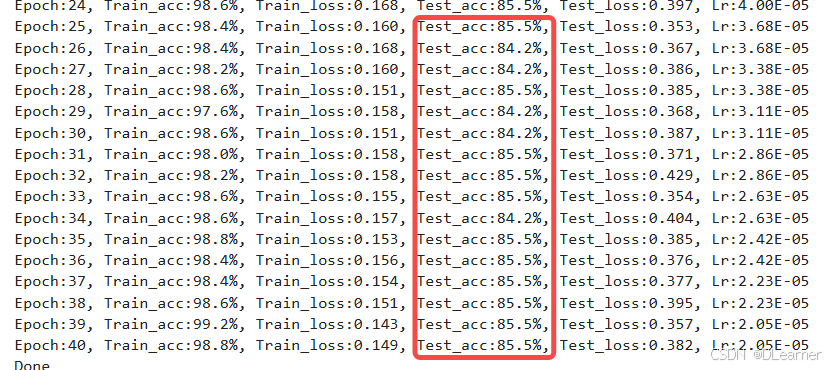

3.4 训练

# 导入必要的库

import torch

import torch.nn as nn

import torch.optim as optim

# 创建交叉熵损失函数

loss_fn = nn.CrossEntropyLoss()

# 设置训练的总轮数(epochs)

epochs = 40

# 初始化用于存储训练和测试损失及准确率的列表

train_loss = []

train_acc = []

test_loss = []

test_acc = []

# 训练循环

for epoch in range(epochs):

# 调整学习率(如果使用自定义的学习率调整策略)

adjust_learning_rate(optimizer, epoch, learn_rate)

# 设置模型为训练模式

model.train()

# 训练一个epoch,并返回该epoch的训练准确率和损失

epoch_train_acc, epoch_train_loss = train(train_dl, model, loss_fn, optimizer)

# 设置模型为评估模式

model.eval()

# 在测试集上评估模型,并返回测试准确率和损失

epoch_test_acc, epoch_test_loss = test(test_dl, model, loss_fn)

# 将当前epoch的训练和测试结果添加到列表中

train_acc.append(epoch_train_acc)

train_loss.append(epoch_train_loss)

test_acc.append(epoch_test_acc)

test_loss.append(epoch_test_loss)

# 获取当前的学习率(从优化器的状态中)

lr = optimizer.state_dict()['param_groups'][0]['lr']

# 打印当前epoch的训练和测试结果

template = ('Epoch:{:2d}, Train_acc:{:.1f}%, Train_loss:{:.3f}, Test_acc:{:.1f}%, Test_loss:{:.3f}, Lr:{:.2E}')

print(template.format(epoch+1, epoch_train_acc*100, epoch_train_loss,

epoch_test_acc*100, epoch_test_loss, lr))

# 训练结束后打印完成信息

print('Done')

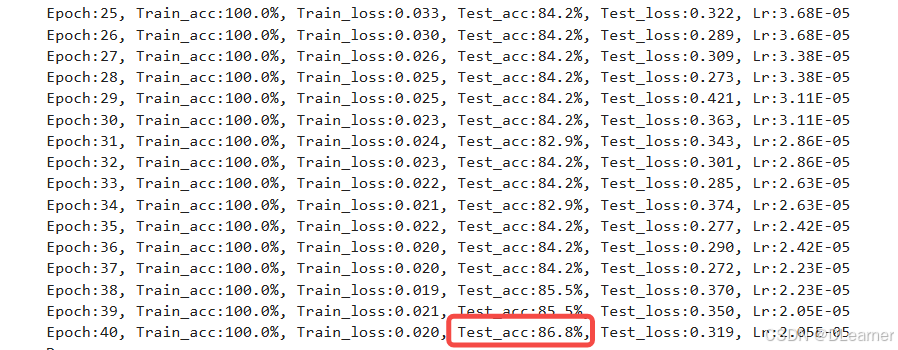

输出:

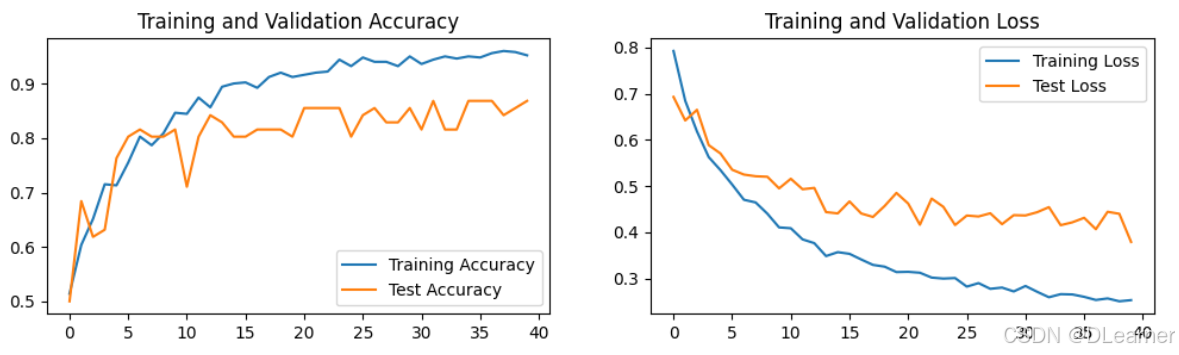

4. 结果可视化

4.1 Loss与Accuracy图

import matplotlib.pyplot as plt # 导入matplotlib的pyplot模块,用于数据可视化

import warnings # 导入警告模块

warnings.filterwarnings("ignore") # 忽略警告信息,避免绘图时出现警告提示

# 设置matplotlib的配置参数

# plt.rcParams['font.sans-serif'] = ['SimHei'] # 设置中文字体,使得图表可以正常显示中文

plt.rcParams['axes.unicode_minus'] = False # 设置正常显示负号

plt.rcParams['figure.dpi'] = 100 # 设置图像的分辨率

epochs_range = range(epochs) # 创建一个从0到epochs-1的范围,用于x轴的刻度

# 设置图像大小

plt.figure(figsize=(12, 3))

# 创建一个1行2列的子图布局,并定位到第1个子图

plt.subplot(1, 2, 1)

# 在第1个子图上绘制训练和测试的准确率曲线

plt.plot(epochs_range, train_acc, label='Training Accuracy') # 绘制训练准确率

plt.plot(epochs_range, test_acc, label='Test Accuracy') # 绘制测试准确率

plt.legend(loc='lower right') # 添加图例,位置在右下角

plt.title('Training and Validation Accuracy') # 设置子图的标题

# 创建一个1行2列的子图布局,并定位到第2个子图

plt.subplot(1, 2, 2)

# 在第2个子图上绘制训练和测试的损失曲线

plt.plot(epochs_range, train_loss, label='Training Loss') # 绘制训练损失

plt.plot(epochs_range, test_loss, label='Test Loss') # 绘制测试损失

plt.legend(loc='upper right') # 添加图例,位置在右上角

plt.title('Training and Validation Loss') # 设置子图的标题

# 显示绘制的图像

plt.show()

输出:

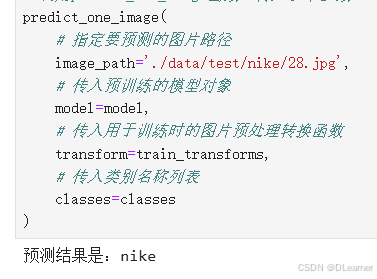

4.2 指定图片进行预测

from PIL import Image

# 获取训练数据集中的类别标签,将其转换为列表形式

classes = list(train_dataset.class_to_idx)

def predict_one_image(image_path, model, transform, classes):

"""

对单张图片进行预测。

参数:

- image_path: 要预测的图片的路径。

- model: 用于预测的模型。

- transform: 对图片进行预处理的转换操作。

- classes: 包含所有类别标签的列表。

返回:

- 预测结果的类别标签。

"""

# 使用PIL库打开图片,并转换为RGB格式

test_img = Image.open(image_path).convert('RGB')

# plt.imshow(test_img) # 这行代码被注释掉了,用于展示预测的图片

# 对图片进行预处理

test_img = transform(test_img)

# 将处理后的图片转换为模型输入需要的格式,添加一个批次维度,并发送到设备(GPU或CPU)

img = test_img.to(device).unsqueeze(0)

# 设置模型为评估模式

model.eval()

# 模型预测

output = model(img)

# 获取预测结果中概率最大的类别索引

_, pred = torch.max(output, 1)

# 根据类别索引获取对应的类别名称

pred_class = classes[pred]

# 打印预测结果

print(f'预测结果是:{pred_class}')

# 调用predict_one_image函数,传入以下参数:

predict_one_image(

# 指定要预测的图片路径

image_path='./data/test/nike/10.jpg',

# 传入预训练的模型对象

model=model,

# 传入用于训练时的图片预处理转换函数

transform=train_transforms,

# 传入类别名称列表

classes=classes

)

输出:

使用其他图片测试:

模型准确率不够高

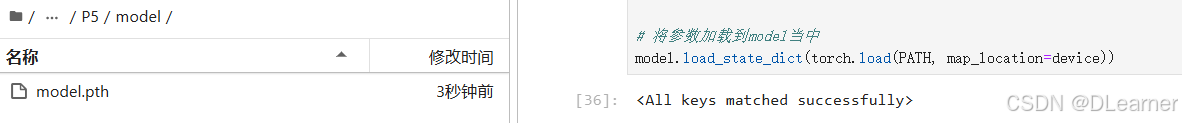

5. 保存并加载模型

# 模型保存

PATH = './model/model.pth' # 保存的参数文件名

torch.save(model.state_dict(), PATH)

# 将参数加载到model当中

model.load_state_dict(torch.load(PATH, map_location=device))

输出:

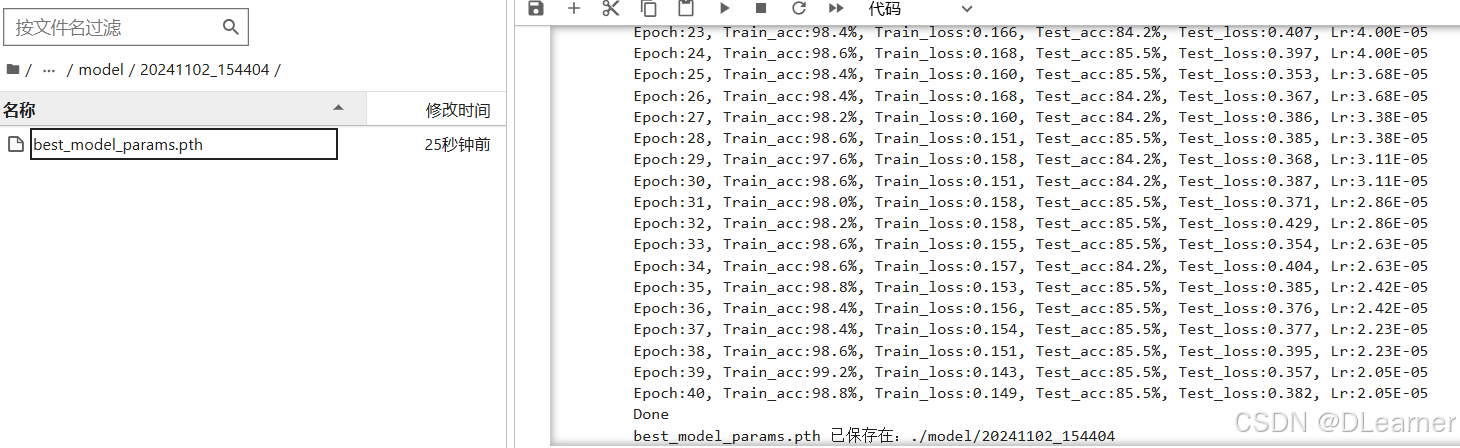

6.课后

-

调整代码使测试集accuracy到达84%。

-

保存训练过程中的最佳模型权重

-

调整代码使测试集accuracy到达86%。

调整优化器为Adam

1129

1129

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?