一、概念

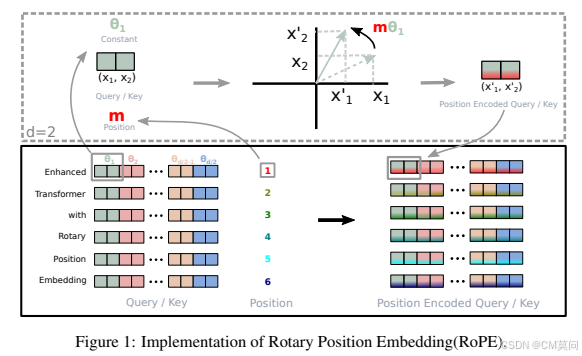

旋转位置编码(Rotary Position Embedding,RoPE)是一种用于大模型(如Transformer)的位置编码方法。它通过旋转embedding向量来引入位置信息,从而在模型中捕捉序列的相对位置信息。RoPE在一些自然语言处理任务中表现出色,尤其是在处理长序列时。

在Transformer模型中,位置编码(Position Embedding)用于引入序列中每个位置的位置信息,因为Transformer的自注意力机制本身是无序的。传统的绝对位置编码(如正弦和余弦位置编码)在处理长序列时可能会遇到一些问题,如无法有效捕捉相对位置信息。目前,诸如Llama、Qwen之类的大模型均在使用旋转位置嵌入方法,可见其重要性。

二、原理

旋转位置编码的核心思想是通过旋转embedding向量来引入位置信息。

1、旋转变换

假设embedding向量为,其维度为 d。RoPE将embedding向量中的特征分成两两一组,共d/2对,每组表示为(

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

361

361

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?