点击下方卡片,关注“自动驾驶之心”公众号

今天自动驾驶之心为大家分享清华大学&伦敦帝国理工学院最新的工作!CBDES MoE:面向自动驾驶BEV感知的功能模块级分层解耦专家混合框架!如果您有相关工作需要分享,请在文末联系我们!

自动驾驶课程学习与技术交流群加入,也欢迎添加小助理微信AIDriver005

>>自动驾驶前沿信息获取→自动驾驶之心知识星球

论文作者 | Qi Xiang等

编辑 | 自动驾驶之心

基于多传感器的BEV感知已经成为端到端自动驾驶的的核心,然而现有方法仍然面临输入适应性有限、建模能力受限以及泛化不佳等问题。针对这些挑战,清华大学、伦敦帝国理工学院和武汉理工的团队提出了CBDES MoE,一种在功能模块层面实现分层解耦的专家混合结构。也是首个在自动驾驶领域内以功能模块粒度构建的模块化专家混合框架。

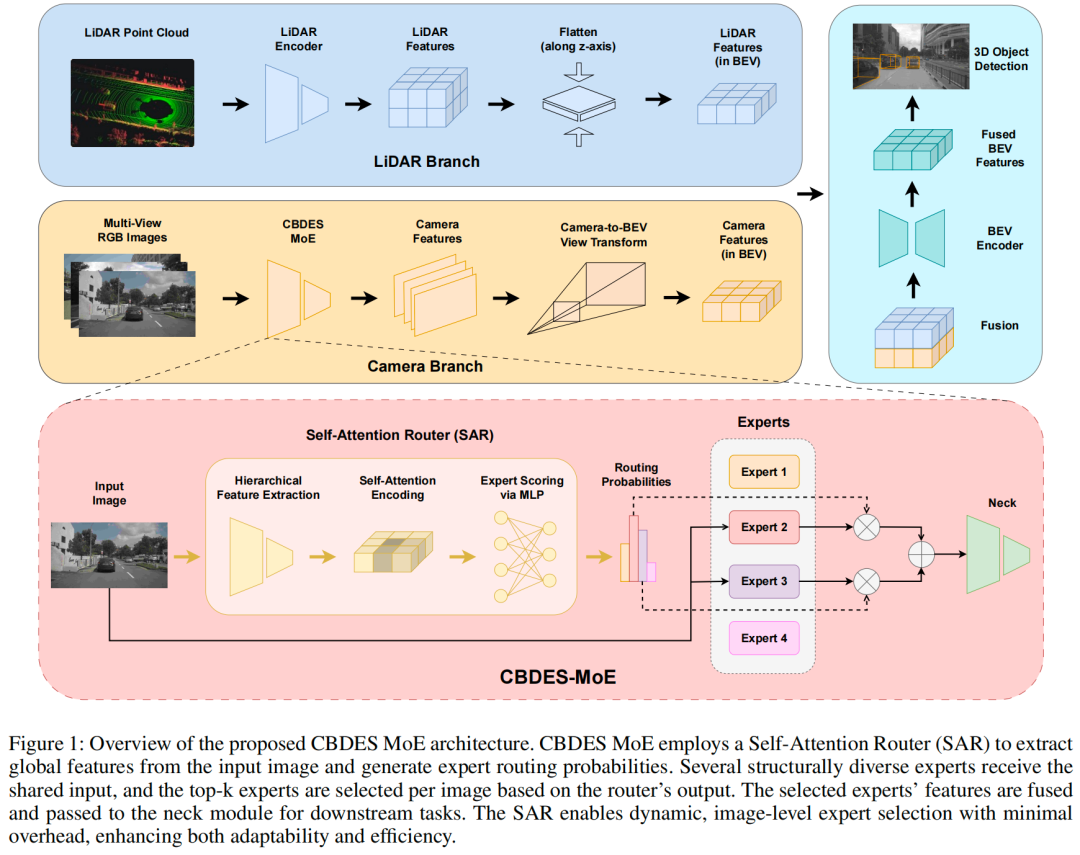

CBDES MoE集成了多个结构异构的专家网络,并采用轻量级的自注意力路由器(Self-Attention Router, SAR)门控机制,从而实现动态专家路径选择以及稀疏、感知输入的高效推理。具体来说,是针对视觉backbone的MoE,集成四种backbone——Swin Transformer、ResNet、ConvNeXt和PVT,有点类似于模型集成,但通过MoE一次性解决。

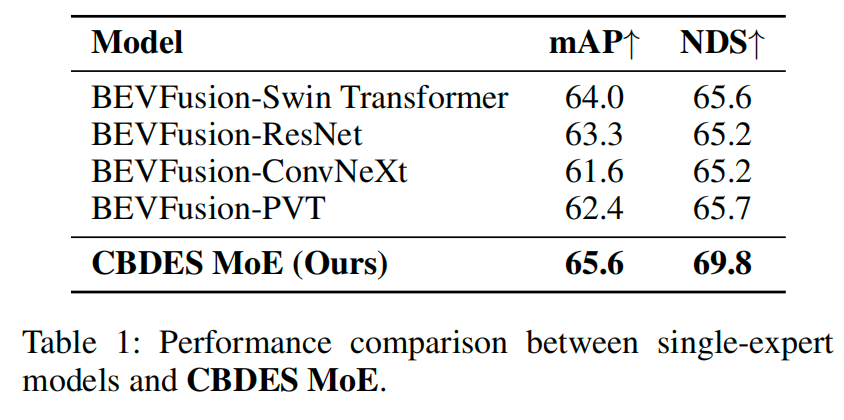

最终的实验结果很不错,在nuScenes的3D目标检测任务上,相较于最强的单专家模型,mAP提升了1.6个百分点,NDS提升了4.1个百分点,验证了所提方法的有效性和实际优势。

和大模型中的MoE不同,由于是backbone层级的MoE,车端部署难度可能较大,但在云端模型中还是值得尝试的。未来可以进一步探索多任务、多模态的MoE,同时针对部署做一些专门的优化。

引言

随着自动驾驶技术的快速发展,三维感知已成为构建安全、智能和可靠驾驶系统的基础。在主流解决方案中,基于鸟瞰图的多模态融合框架(如BEVFusion)展现出巨大潜力,通过将来自相机和激光雷达(LiDAR)的原始传感器输入投影到统一的空间表示中,实现了高效的三维感知。这些结构化的BEV特征能够实现精确的三维目标检测,并支持一系列下游驾驶任务。尽管取得了成功,但大多数现有方法为每种模态采用固定的单backbone特征提取器。虽然这种设计简化了训练流程,但严重限制了模型对多样化和动态变化驾驶环境(如不同光照、天气和相机视角)的适应能力。此外,单backbone架构有限的建模能力削弱了其捕捉语义丰富且复杂的场景信息的能力,最终导致在领域迁移或任务转换时性能下降。

为应对这些挑战,先前的研究探索了自适应模块,例如动态卷积和可变形注意力。尽管这些技术提高了局部灵活性,但仍局限于刚性的单一网络结构。由于缺乏粗粒度的架构适应性,此类模型难以根据输入变化动态重新分配计算资源,从而阻碍了其在安全关键型自动驾驶系统中的大规模部署。专家混合(Mixture-of-Experts, MoE)范式提供了一种新的的解决方案。通过基于学习到的路由机制实现动态专家选择,MoE模型能够在计算效率和表示丰富性之间灵活平衡。尽管MoE在自然语言处理和视觉-语言任务中取得了显著成功,但其在基于BEV的三维感知中的潜力尚未得到充分挖掘。特别是,设计适用于多模态融合的异构专家backbone和路由策略,仍面临独特挑战,尚未得到充分解决。

在本研究中,我们提出了CBDES MoE,一种专为BEV感知任务设计的分层解耦专家混合架构。我们的方法引入了多样化的backbone专家池、轻量级门控路由网络和稀疏激活机制,以实现高效、自适应和可扩展的3D感知。在nuScenes基准上的综合实验表明,我们的方法在复杂和多样的驾驶场景下持续超越强大的单backbone基线模型。我们的主要贡献总结如下:

CBDES MoE 引入了一种全新的基于专家的架构,包含一个多阶段异构backbone设计池。通过支持分层解耦和动态专家选择,该模型增强了场景适应性和特征表示能力。

开发了一种轻量级、分层的路由机制,集成了卷积操作、自注意力和多层感知机(MLP)。该模块实现了从输入到专家的端到端学习映射,支持稀疏激活和高效的动态推理。

在nuScenes数据集上进行了大量实验,结果表明CBDES MoE在多样且具有挑战性的环境条件下持续超越强大的单backbone基线模型。

相关工作回顾

多模态BEV感知

随着自动驾驶系统的发展,多传感器信息融合已成为提升感知精度与鲁棒性的关键技术。早期方法通常依赖于独立的流水线阶段或基于点云的融合方法(例如PointPillars、VoxelNet),但这些方法难以充分利用图像丰富的纹理与语义信息。近年来,由于其统一的空间投影特性,鸟瞰图(BEV)表示方法日益受到关注。BEVDet、BEVDepth、BEVFormer等方法通过将多视角相机图像投影到BEV空间,在三维目标检测和地图分割任务中展现出显著的性能提升。

进一步地,BEVFusion等研究提出了特征级多模态融合框架,通过在BEV空间内对齐并联合建模相机与激光雷达(LiDAR)信息。然而,这些方法通常采用固定的单主干架构(如ResNet、Swin Transformer),缺乏对多样化和动态变化输入条件的适应能力。

动态设计范式

自动驾驶场景具有高度的变异性——包括光照、天气、视角和道路布局——要求感知系统具备灵活且强大的建模能力。单一的固定架构在受控条件下表现可靠,但在领域迁移或任务转换时性能往往下降。

近期研究引入了动态卷积和可变形注意力机制,以实现基于输入特征的自适应参数调整,从而提升模型鲁棒性。然而,这些工作主要在单一架构内的细粒度模块层面进行操作,未能提供宏观层面的架构多样性或动态路径调度能力。在自动驾驶感知研究中,仍迫切需要一种机制,既能实现结构多样性与动态选择,又能保持推理效率。

MoE架构

Jacobs等人最初提出的专家混合(MoE)架构,通过基于输入依赖的门控机制实现动态专家选择,从而在增强表示能力的同时控制计算成本。在自然语言处理(NLP)领域,GShard和Switch Transformers等模型已证明,稀疏激活的专家结构可以在不带来沉重推理开销的情况下线性扩展模型容量。最近,DeepSeekMoE进一步推动了这一边界,通过专家稀疏性和优化路由,将MoE模型扩展至超过千亿参数,同时保持高效性。在视觉领域,Vision MoE通过引入专家模块,在分类和检测等任务中表现出色。

然而,系统性地将MoE集成到自动驾驶的多模态BEV感知中仍处于探索阶段。挑战包括设计合适的专家组合、高效的门控机制,以及在BEV投影空间中保持跨模态一致性。

自动驾驶中的MoE研究

在自动驾驶领域,已有先驱性工作开始将MoE引入端到端任务学习。例如,ARTEMIS将MoE引入轨迹规划,利用动态路由解决在模糊引导条件下的性能退化问题,实现了跨场景的鲁棒规划。DriveMoE则提出了一种基于视觉的MoE用于感知,以及一种基于行为的MoE用于决策,实现了多视角处理的解耦和多样化驾驶技能,并在Bench2Drive基准上取得了最先进的结果。

这些工作证实了MoE能够增强端到端规划和决策模块的多样性与适应性。然而,上述研究主要聚焦于端到端的规划和决策层。目前,尚缺乏在多模态BEV感知系统中实现分层、解耦的动态专家选择的系统性解决方案。

CBDES MoE算法详解

在本节中,我们介绍了所提出的CBDES MoE的架构与设计细节,这是一种专为自动驾驶中多模态BEV感知任务设计的新型多专家模型。CBDES MoE模块被设计为一种即插即用的主干网络,通过利用架构多样性与输入自适应路由机制来增强特征表示能力。

我们的设计通过引入异构专家组合、输入依赖的动态路由以及BEV空间中的特征级聚合,有效解决了单主干融合网络的局限性。

整体框架

CBDES MoE模块集成于类似BEVFusion的框架中,其中多视角相机图像被投影到BEV空间,并与激光雷达(LiDAR)/雷达模态融合,以执行三维目标检测和地图分割等3D感知任务。我们将传统的静态图像主干替换为一个异构的专家混合(Mixture-of-Experts)模块,用于在BEV投影前提取图像特征。每个专家独立处理输入图像,然后利用相机到BEV的视图变换层将特征投影至BEV空间。所有后续操作,如模态融合和任务头,均与BEVFusion等标准流水线保持兼容。

如图1所示,CBDES MoE由四个结构各异的专家网络、一个轻量级可学习的路由模块以及一个专家输出的软特征融合机制组成。每个组件的设计均以效率、多样性与输入适应性为核心,使模型能够在不同视觉条件和任务需求下选择性地激活专家路径。

异构专家集设计

CBDES MoE的一项主要创新在于专家主干网络之间的显式架构异构性。与使用相同架构的专家不同,我们设计了一个由四种不同的视觉主干组成的专家池,每种主干代表深度视觉表示学习中的不同范式:

Swin Transformer:一种采用基于窗口的自注意力与移位窗口机制的分层Transformer,特别擅长捕捉大视野场景中的全局空间结构。

ResNet:一种使用残差连接的经典卷积主干。尽管结构简单,但其为局部结构编码和边缘检测提供了强大的归纳偏置,尤其在光照不足或纹理缺失的条件下表现优异。

ConvNeXt:一种受Transformer启发但保持全卷积设计的现代化卷积网络架构,在局部性与可扩展性之间取得平衡,以较少的手工先验提供强大的表示能力。

yramid Vision Transformer(PVT):一种专为密集预测任务设计的分层Transformer,通过引入空间缩减注意力机制,在全局上下文建模与计算成本之间实现平衡,适用于多尺度目标建模。

通过集成四种结构差异显著的专家主干,模型能够受益于多样化的归纳偏置与表示能力。这些专家不仅在架构上不同,其感受野特性、参数化模式和计算开销也各不相同。这种异构性对于建模真实世界自动驾驶场景中巨大的变异性至关重要(例如城市与乡村、白天与夜晚、晴朗与雾天)。每个专家在捕捉特定图像模式方面表现出色,从而使系统对动态多变的道路场景更具鲁棒性。

自注意力路由器SAR

为动态地为每张输入图像分配最合适的专家,我们提出了一种自注意力路由器(SAR),该路由器结合了卷积特征提取、轻量级自注意力机制和MLP分类器。

SAR接收一个特征图 作为输入,其中 为批量大小, 为输入通道数, 为空间分辨率。该模块随后经历三个主要阶段:分层特征提取、自注意力编码和通过MLP进行专家评分。

分层特征提取。我们首先使用一系列卷积和池化层逐步降低空间分辨率,同时增加通道维度:

其中 为注意力嵌入维度(例如128)。每个ConvModule包含一个卷积层,后接批归一化(Batch Normalization)和PReLU激活函数。池化操作采用步长为2的 最大池化。

自注意力编码。上一阶段的结果 被重塑为一个token序列:

为建模空间token之间的全局交互,我们应用一个多头自注意力(MHA)层:

该操作使路由器能够整合空间依赖关系,并学习更丰富的全局场景上下文表示。

随后,将输出序列 在token维度上取平均,生成图像级嵌入:

通过MLP进行专家评分。将上一阶段的全局描述符 输入一个包含PReLU激活的三层MLP,以生成专家logits:

其中 为专家数量。最后,路由器应用softmax函数得到路由概率:

每一行 表示对 个可用专家的图像级软分配。

这种图像级路由机制使模型能够根据输入语义调整其计算路径。例如,雨天场景可能被路由至以Transformer为主的专家,而纹理丰富的城市场景则可能受益于卷积网络。这种适应性提升了模型对域偏移以及罕见或复杂场景的鲁棒性,解决了静态模型的常见缺陷。

路由器本身结构轻量,仅包含少量卷积层、一个单层多头自注意力机制和一个紧凑的MLP。尽管结构简单,它仍能有效汇总全局场景级信息并生成语义上有意义的路由分数。它使系统能够为每张输入图像动态地为每个专家分配不同的权重。这种路由灵活性使模型能够自动为不同类型的场景、光照条件或空间布局专门化每个专家,而无需人工干预。

专家特征提取

每个专家接收图像作为输入,并生成各自的处理后特征:

其中 表示第 个专家网络。

值得注意的是,所有专家输出均保持相同的空间分辨率和通道维度(必要时通过适配器层实现),以确保在融合过程中的兼容性。架构差异导致每个专家在不同的视觉模式上实现专业化——某些专家可能在检测长距离车辆方面表现出色,而其他专家可能更擅长分割道路边界。

软加权特征融合

在获得路由分数和专家输出后,我们使用路由图在专家间进行加权软融合。最终的融合特征图 计算如下:

该机制实现了专家间的平滑过渡,避免了硬路由带来的不稳定性,同时由于训练过程中softmax的锐化作用,仍能保持稀疏的激活模式。

基于稀疏专家激活的高效推理

在推理阶段,我们根据路由器的输出仅激活每个图像的top-1专家。这种稀疏专家激活策略相比评估所有专家,极大地降低了计算成本,同时由于路由器的判别能力,仍能保持具有竞争力的精度。

形式上,对于批量大小为 的输入,仅需 次专家主干的前向传播,而非 次( 为专家数量)。这使得计算成本随批量大小线性扩展,使系统在边缘硬件上具备实时应用的可行性。

负载均衡正则化

MoE模型的一个常见问题是专家坍塌(expert collapse),即路由器持续选择专家子集,导致其他专家利用率不足。这种不平衡不仅浪费模型容量,还削弱了专家多样性的优势。为解决此问题,我们引入了一个负载均衡正则化项,以鼓励在整个数据集上均匀使用所有专家。

设 为路由概率矩阵,其中 为样本数(如批次中的图像数), 为专家数量。每一行 表示第 个样本分配给 个专家的软路由概率,满足 。

专家的平均激活定义为:

每个专家的总路由负载为:

则负载均衡损失定义为:

该公式惩罚了专家使用频率( )与累积负载( )之间的联合偏差。当所有专家在批次中被均匀分配时,该损失达到最小值,从而促进所有专家的公平参与。

该正则化项被集成到整体训练目标中:

其中 是控制任务性能与路由多样性之间权衡的超参数。实践中,较小的 (如0.01)足以促进负载均衡,而不会干扰任务收敛。

该负载均衡正则化确保了所有专家在训练期间均被激活,从而实现更丰富的专业化,并避免专家利用不足。

与BEVFusion的集成

融合后的特征图 被传递至BEVFusion中标准的camera-to-BEV投影。该模块利用相机内参和外参矩阵将2D特征反投影到一个共享的BEV网格中。生成的BEV特征随后与其他模态(如LiDAR、雷达)融合,并传递至特定任务的head,以实现3D目标检测、语义分割或实例分割。

由于我们设计的即插即用特性,CBDES MoE可以无缝集成到各种基于BEV的感知框架中,而无需修改投影逻辑或下游头网络。

训练策略

我们使用与标准BEVFusion流水线相同的损失函数(如检测的focal loss)对CBDES MoE进行端到端训练,并额外加入专家负载均衡损失以均衡专家使用并促进专业化。

自注意力路由器与模型其余部分联合训练。在训练期间,我们使用软门控(即所有专家输出的加权和)以确保可微性。在推理时,我们切换为每张图像激活top-1专家,以降低计算开销。除非另有说明,所有结果均在此推理模式下报告。

我们采用混合精度训练以减少训练时间和GPU内存消耗。所有专家联合优化,路由参数通过标准反向传播进行训练。

实验结果

为评估所提出的CBDES MoE框架的有效性,我们进行了全面的实验,重点研究自动驾驶场景中的三维目标检测任务。目标是评估动态异构专家选择带来的性能提升以及负载均衡正则化带来的益处。我们将CBDES MoE与多个强单专家基线模型进行比较,并进行消融研究以分离每个组件的贡献。

实验设置

我们将CBDES MoE集成到官方的BEVFusion代码库中进行性能评估。四个专家——Swin Transformer、ResNet、ConvNeXt和PVT——均在ImageNet-1K上进行了预训练,并被适配以匹配BEVFusion相机分支的输入-输出接口。

实验在nuScenes上展开,具体的评测、计算资源和超参数可以参考原文。

与单专家模型的比较

为评估专家多样性和动态路由的贡献,我们将CBDES MoE与四个基线模型进行比较,每个基线使用单一的专家主干:Swin Transformer、ResNet、ConvNeXt和PVT。所有模型共享相同的BEV融合、检测头和训练配置,以确保公平比较。单专家变体省略了MoE结构和路由机制。

如表1所示,CBDES MoE在mAP和NDS上均持续优于所有四个单专家基线。这验证了专家多样性和自适应路由机制在提升三维检测性能方面的有效性。

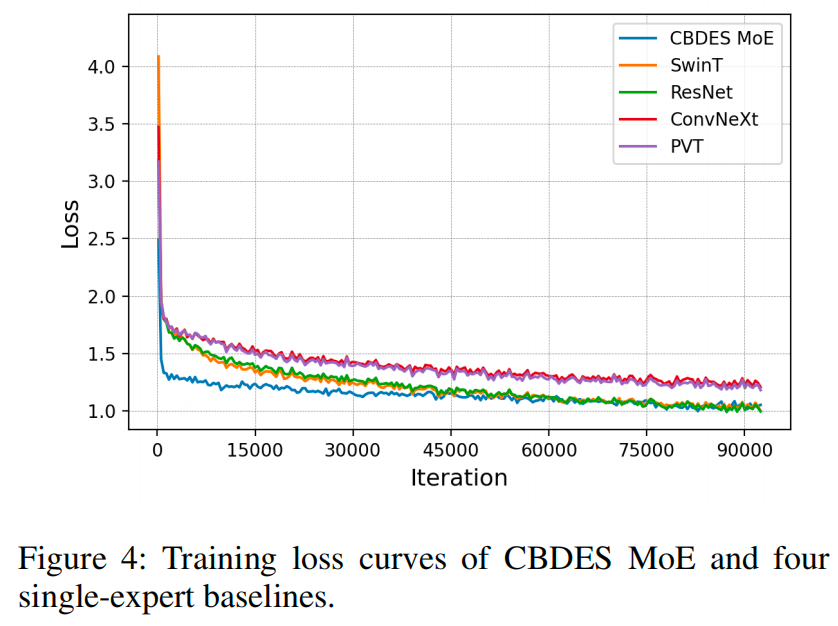

除了精度指标外,我们还在图4中比较了训练过程。CBDES MoE表现出更快的收敛速度,并在整个训练过程中保持更低的损失,表明其优化稳定性更高,学习效率更优。

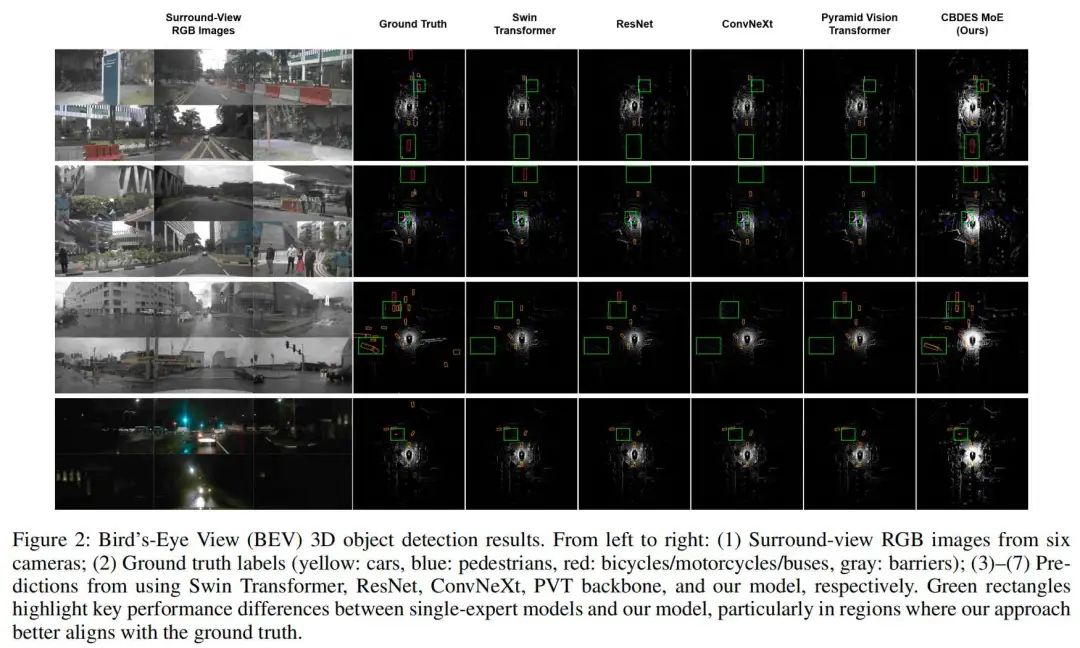

为进一步说明这些定量提升,图2展示了在四种不同环境条件下代表性场景的BEV 3D目标检测结果的定性比较。前两行描绘了能见度良好的正常白天场景,而第三和第四行展示了更具挑战性的条件:第三行包含雨雾,第四行为夜间拍摄。在所有场景中,CBDES MoE产生的结果与GT更为接近,尤其是在绿色框标出的区域。

在晴朗的白天场景中,CBDES MoE相比单专家模型表现出更强的一致性和更少的漏检。在恶劣条件下——例如因雾导致能见度低或夜间光照有限——我们的模型通过在基线模型出现误检或完全无法定位目标时仍能保持稳健的检测而优于基线。这些结果凸显了动态专家路由的优势:通过为每个输入选择最合适的专家,CBDES MoE能够更好地适应环境变化,并在多样化的真实世界条件下展现出卓越的泛化能力。

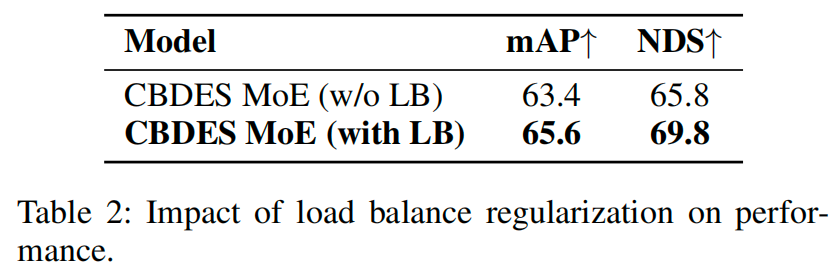

负载均衡正则化的影响

我们进一步分析了负载均衡正则化对检测性能的影响。比较了CBDES MoE的两个变体:一个在训练中加入了负载均衡损失,另一个没有。

如表2所示,使用负载均衡正则化的CBDES MoE在mAP和NDS上均显著优于未使用该正则化的版本。

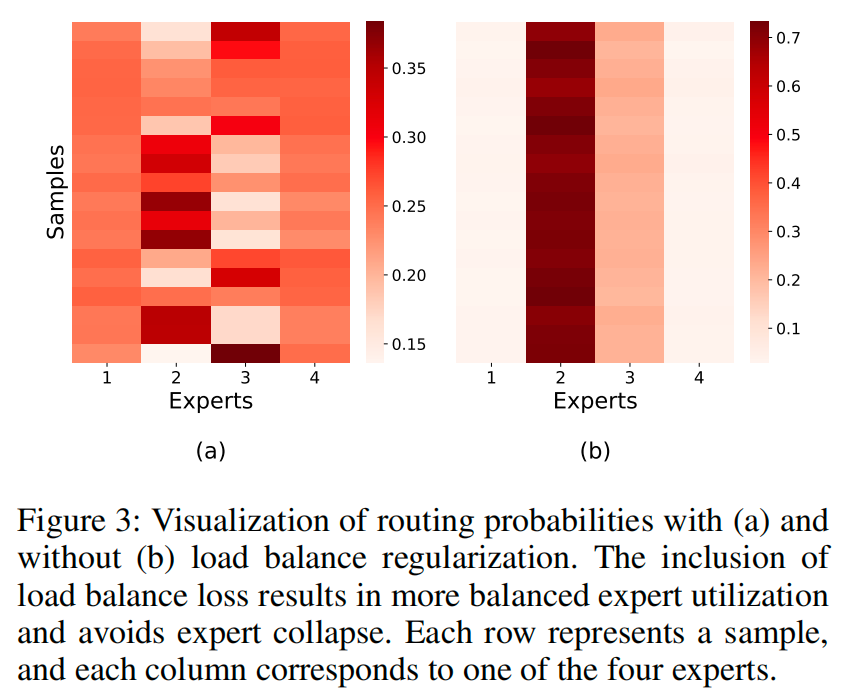

为更好地理解负载均衡损失对专家利用率的影响,我们在图3中可视化了路由器的行为。两个热图分别展示了在有和没有负载均衡正则化项的情况下,分配给每个专家的软路由概率。

为更好地理解负载均衡损失对专家利用率的影响,我们在图3中可视化了路由器的行为。两个热图分别展示了在有和没有负载均衡正则化项的情况下,分配给每个专家的软路由概率。

在没有负载均衡损失(图3b)的情况下,路由概率严重偏向一个主导专家,导致严重的专家不平衡和其余专家的利用不足。相比之下,当应用负载均衡损失(图3a)时,路由概率在所有四个专家之间分布得更加均匀,最终的选择表现出更大的多样性。这证实了正则化项促使路由器探索完整的专家空间,并防止陷入退化的路由模式。

改进的专家多样性直接促成了更好的性能,如表2所示,在专家使用均衡的情况下,mAP和NDS均更高。这些结果凸显了在基于MoE的感知系统中引入负载均衡以充分利用其建模能力的必要性。

结论

本文提出了CBDES MoE,一种专为自动驾驶功能模块设计的新型分层解耦MoE框架。通过集成四种结构异构的专家主干——Swin Transformer、ResNet、ConvNeXt和PVT,并引入轻量级的自注意力路由器(SAR)实现图像级的动态专家选择,我们的模型能够为每个输入自适应地激活最合适的专家。此外,我们还引入了负载均衡正则化项,以防止专家坍塌并确保训练稳定。在nuScenes数据集上的实验结果表明,CBDES MoE在mAP和NDS指标上持续优于单专家基线,验证了所提框架的有效性。

局限性与未来工作:尽管CBDES MoE性能强劲,但仍存在一些局限性。目前,专家路由仅在图像级别进行;未来的工作可以探索基于图像块(patch-wise)或区域感知(region-aware)的路由,以实现更细粒度的适应。未来可以将方法扩展到多任务(例如分割和跟踪)或引入来自激光雷达的跨模态路由信号,可进一步增强泛化能力。我们还计划研究自动化的专家架构搜索和面向硬件的模型压缩,以优化模型的可扩展性和部署效率。

致谢

本工作得到了国家重点研发计划项目"自动驾驶数据闭环大模型技术与场景库构建"(项目编号:2024YFB2505501)和广西重点科技项目"高性能低成本城市试点驾驶技术研究与产业化"(项目编号:桂科AA24206054)的支持。

自动驾驶之心

论文辅导来啦

自驾交流群来啦!

自动驾驶之心创建了近百个技术交流群,涉及大模型、VLA、端到端、数据闭环、自动标注、BEV、Occupancy、多模态融合感知、传感器标定、3DGS、世界模型、在线地图、轨迹预测、规划控制等方向!欢迎添加小助理微信邀请进群。

知识星球交流社区

近4000人的交流社区,近300+自动驾驶公司与科研结构加入!涉及30+自动驾驶技术栈学习路线,从0到一带你入门自动驾驶感知(大模型、端到端自动驾驶、世界模型、仿真闭环、3D检测、车道线、BEV感知、Occupancy、多传感器融合、多传感器标定、目标跟踪)、自动驾驶定位建图(SLAM、高精地图、局部在线地图)、自动驾驶规划控制/轨迹预测等领域技术方案、大模型,更有行业动态和岗位发布!欢迎加入。

独家专业课程

端到端自动驾驶、大模型、VLA、仿真测试、自动驾驶C++、BEV感知、BEV模型部署、BEV目标跟踪、毫米波雷达视觉融合、多传感器标定、多传感器融合、多模态3D目标检测、车道线检测、轨迹预测、在线高精地图、世界模型、点云3D目标检测、目标跟踪、Occupancy、CUDA与TensorRT模型部署、大模型与自动驾驶、NeRF、语义分割、自动驾驶仿真、传感器部署、决策规划、轨迹预测等多个方向学习视频

学习官网:www.zdjszx.com

457

457

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?