2月18日,马斯克带着“地表最聪明AI”Grok-3高调登场,号称用20万块GPU砸出“大力出奇迹”的模型,直接叫板OpenAI和国产新星DeepSeek。这场AI巨头之战,是算力碾压还是技术革新?

一、Grok-3:马斯克的“钞能力”AI

- 性能屠榜,推理能力封神

- 在数学(AIME 2025)、科学(GPQA)、编码(LCB)三大基准测试中,Grok-3全面刷新SOTA,以93分碾压DeepSeek R1(80分)和OpenAI的O3-mini(87分)。

- LMSYS盲测榜单中,Grok-3以1402分的Elo评分断层领先,成为首个突破1400分的模型。

- 在数学(AIME 2025)、科学(GPQA)、编码(LCB)三大基准测试中,Grok-3全面刷新SOTA,以93分碾压DeepSeek R1(80分)和OpenAI的O3-mini(87分)。

- 20万GPU集群炼出“推理怪兽”

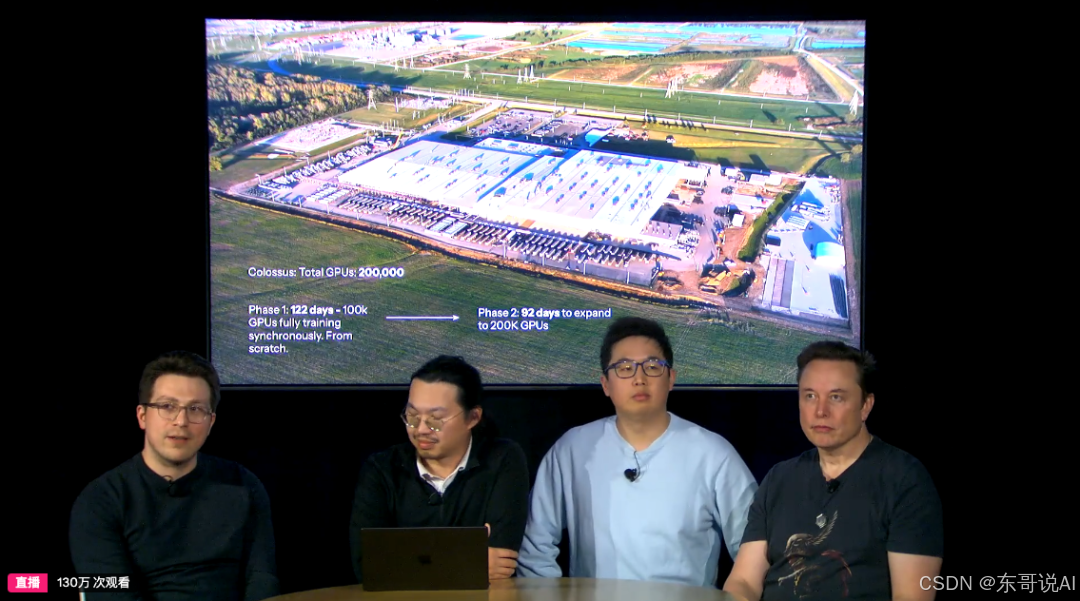

- 马斯克自建超算集群Colossus,第一阶段投入10万块H100 GPU训练122天,第二阶段再砸10万块H100/H200,耗时92天,总耗电超100兆瓦。

- 引入“测试时计算”技术,动态分配算力资源,让模型在复杂问题(如航天轨道计算)中展示完整思维链。

- DeepSearch:要革搜索引擎的命

- 全新智能体功能,可全网深度检索并解析信息,用户能实时查看搜索过程。演示中,Grok-3成功预测NCAA“疯狂三月”比赛结果,直接挑战谷歌搜索。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

833

833

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?