Universal Manipulation Interface: In-The-Wild Robot Teaching Without In-The-Wild Robots

Introduction

目前主流的两种演示方式:遥操作和人类演示,都不是充分有效的演示收集方式,前者对硬件和操作人员来说具有较高的成本,后者对机器人表现出很大的具身差距。

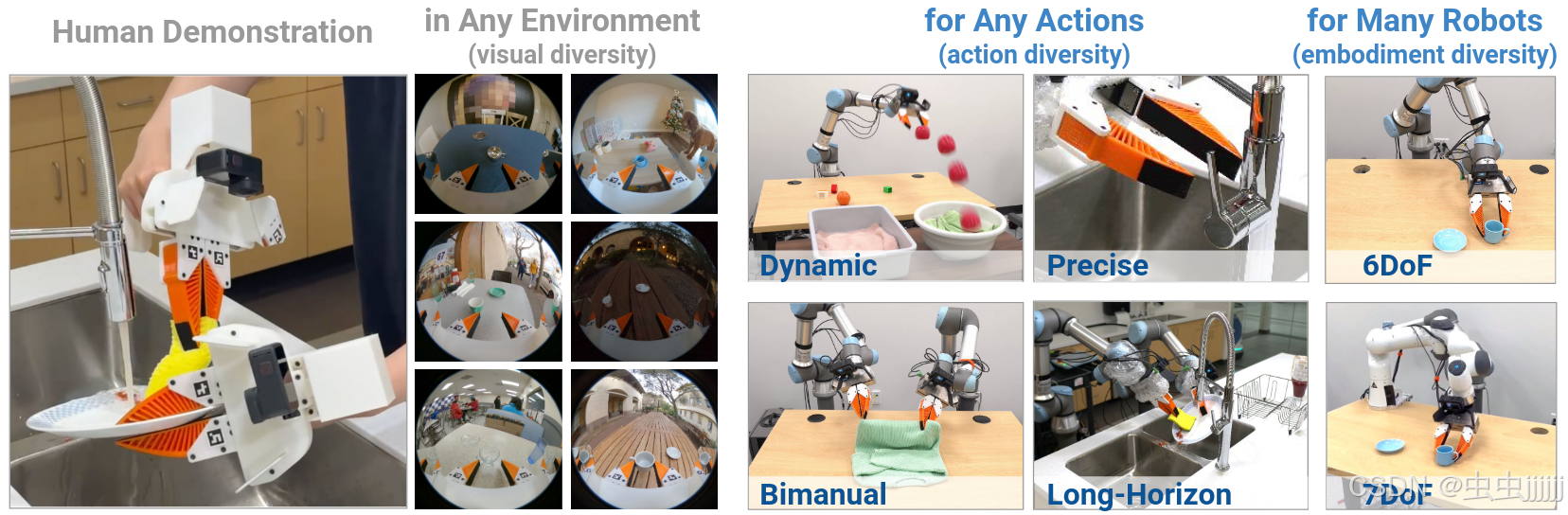

使用传感器化的手持式夹持器作为数据收集接口成为一种很有前途的中地替代方案——保持直观和灵活的同时最小化实施差距,虽然理论上用户可以通过这些手持设备收集任何动作,但其中大部分数据无法传输到有效的机器人策略中。尽管在数以百计的环境中实现了令人印象深刻的视觉多样性,但收集的动作仅限于简单的抓取或准静态的拾取和放置,缺乏动作多样性。

阻碍动作迁移的原因

- 没有充分的上下文信息:摄像机与被操作物体的接近往往会导致严重的遮挡,为动作规划提供不充分的视觉上下文。

- 动作表征不精确:大多数手持设备依靠单目运动产生的结构SfM恢复机器人动作,由于尺度模糊、运动模糊或纹理不足,这样的方法往往难以恢复精确的全局动作,限制了系统所能执行任务的精度。

- 延迟差异:在数据收集过程中,无延迟地进行观察和动作记录。在实际推理过程中,系统内部会产生各种各种延迟源,没有意识到这些延迟差异的策略将遇到分布外的输入,进而产生不同步的动作。对于快速、动态的动作影响由为突出。

- 策略表示不足:过去的工作通常使用MSE作为简单的策略表示,无法捕捉人类数据中固有的复杂多模态动作分布的能力。

本文的改进之处

- 使用鱼眼镜头来增加视野和视觉上下文,并在夹持器上添加侧镜,以提供隐式的立体观测,结合GoPro内置的IMU传感器时,可以实现快速运动下的鲁棒跟踪。

- 使用推理时间延迟匹配来处理不同的传感器观测和执行延迟,使用相对轨迹作为动作表示,以消除对精确全局动作的需求,最后,用扩散模型对多模态动作分布进行建模。

最后构成Universal Manipulation Interface (UMI)系统框架,证明了UMI能够通过只改变每个任务的训练数据来实现包括动态、双手、精确和长时程动作的各种操作任务,此外,当使用不同的人类演示进行训练时,最终的策略对新环境和新对象表现出零样本泛化能力,在非分布测试中取得了显著的成功率。

Related Work

任何数据驱动的机器人系统的一个关键使能因素是数据本身。

遥操作机器人数据

行为克隆利用遥操作机器人演示,因其具有直接可转移性而脱颖而出。以前的方法使用3D空间鼠标,VR或AR控制器,智能手机和触觉设备等接口进行遥操作。这些方法要么非常昂贵,要么由于高延迟和缺乏用户直观性而难以使用。

虽然最近的领航跟随设备的进步,如ALOHA和GELLO

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1547

1547

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?