详解softmax和sigmoid

激活函数简介

从事或对人工智能行业有了解的人员来说,相信对softmax和sigmoid这两个激活函数并不陌生,这两个激活函数实不仅在逻辑回归有应用,也是在面试或笔试中包含的内容,掌握好这两个激活函数及其衍生函数是很重要也是最基础的。下面详细介绍softmax和sigmoid:

softmax函数

在数学上,softmax函数又称归一化指数函数,是逻辑函数的一种推广。它能将一个喊任意实数的k维的向量z的“压缩”到两一个k维向量σ(z) 中,使得每一个元素的范围都在(0, 1)之间,并且所有元素和为1。

softmax函数的性质

softmax函数的公式是:

F

(

x

i

)

=

e

x

p

(

x

i

)

∑

i

=

0

k

e

x

p

(

x

i

)

(

i

=

0

,

1

,

2

,

.

.

.

k

)

F(x_i)=\frac {exp(x_i) } {\sum_{i=0}^k{exp(x_i)}} (i = 0,1,2,...k )

F(xi)=∑i=0kexp(xi)exp(xi)(i=0,1,2,...k)

x:输入数据;

exp:指数运算;

f(x):函数输出;

将所有的x值映射到0到1区间内;

所有x的映射值的和等于1。

softmax函数的使用

- 用于多重分类逻辑回归模型。

- 在构建神经网络时,在不同的层使用softmax函数;softmax在神经网络中是作为一个全连接层出现的,功能是将网络计算后的结果映射到(0, 1)区间,给出每种分类的概率。

softmax的实现代码

python实现

import numpy as np

def softmax(x):

orig_shape=x.shape

#根据输入类型是矩阵还是向量分别做softmax

if len(x.shape)>1:

#矩阵

#找到每一行的最大值max,并减去该max值,目的是为了防止exp溢出

constant_shift=np.max(x,axis=1).reshape(1,-1)

x-=constant_shift

#计算exp

x=np.exp(x)

#每行求和

normlize=np.sum(x,axis=1).reshape(1,-1)

#求softmax

x/=normlize

else:

#向量

constant_shift=np.max(x)

x-=constant_shift

x=np.exp(x)

normlize=np.sum(x)

x/=normlize

assert x.shape==orig_shape

return x

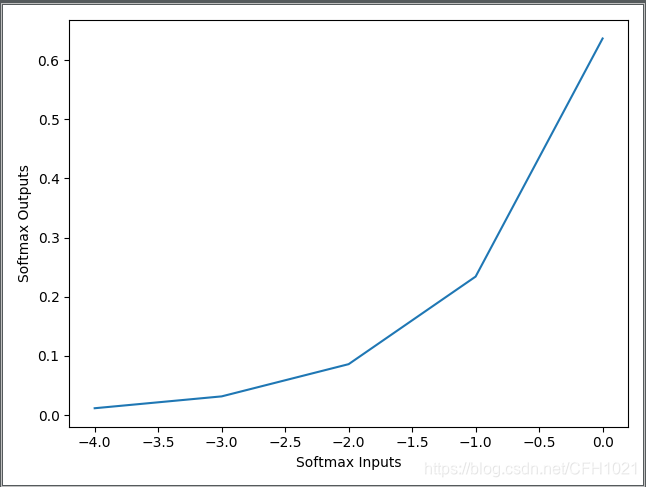

softmax函数图像

import numpy as np

import matplotlib.pyplot as plt

def softmax(x):

orig_shape=x.shape

if len(x.shape)>1:

constant_shift=np.max(x,axis=1).reshape(1,-1)

x-=constant_shift

x=np.exp(x)

normlize=np.sum(x,axis=1).reshape(1,-1)

x/=normlize

else:

constant_shift=np.max(x)

x-=constant_shift

x=np.exp(x)

normlize=np.sum(x)

x/=normlize

assert x.shape==orig_shape

return x

softmax_inputs = np.arange(0,5)

softmax_outputs=softmax(softmax_inputs)

print("softmax input:: {}".format(softmax_inputs))

print("softmax output:: {}".format(softmax_outputs))

# 画图像

plt.plot(softmax_inputs,softmax_outputs)

plt.xlabel("Softmax Inputs")

plt.ylabel("Softmax Outputs")

plt.show()

从图中可以看出softmax的输入值越大,它的输出值也越大。

sigmoid函数

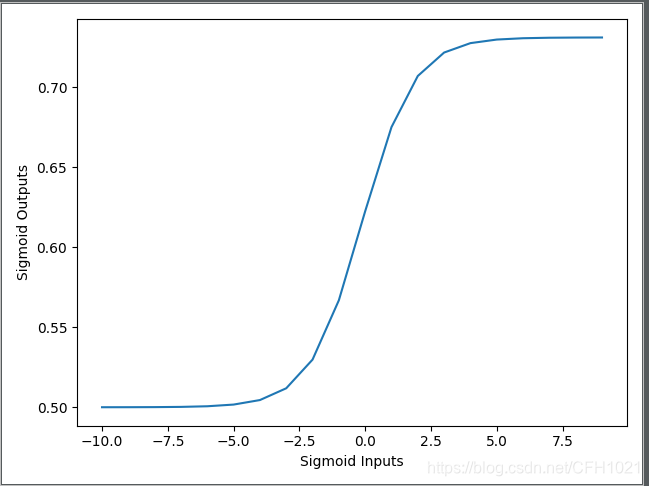

sigmoid函数是一个生物学上常见的S型函数,也称为S型生长曲线。在sigmoid函数常被用作神经网络的阈值函数,将变量映射到0,1之间。

sigmoid函数的性质

sigmoid函数的公式是:

F

(

x

)

=

1

1

+

e

x

p

(

−

x

)

F(x)= \frac{1} {1+exp(-x)}

F(x)=1+exp(−x)1

x:输入数据;

exp:指数运算;

f(x):函数输出,为浮点数;

sigmoid函数的使用

- Sigmoid函数用于逻辑回归模型中的二进制分类。

- 在神经网络中,sigmoid函数用作激活函数。

- 在统计学中,S形函数图像是常见的累积分布函数。

sigmoid的实现代码

python实现

import numpy as np

def sigmoid(x):

return 1.0/(1+np.exp(-x))

sigmoid函数绘图

def sigmoid(x):

return 1.0/(1+np.exp(-x))

sigmoid_inputs = np.arange(-10,10)

sigmoid_outputs=sigmoid(sigmoid(sigmoid_inputs))

print("sigmoid Input :: {}".format(sigmoid_inputs))

print("sigmoid Output :: {}".format(sigmoid_outputs))

plt.plot(sigmoid_inputs,sigmoid_outputs)

plt.xlabel("Sigmoid Inputs")

plt.ylabel("Sigmoid Outputs")

plt.show()

softmax和sigmoid的对比

| common | softmax | sigmoid |

|---|---|---|

| 公式 | F ( x i ) = e x p ( x i ) ∑ i = 0 k e x p ( x i ) F(x_i)=\frac {exp(x_i) } {\sum_{i=0}^k{exp(x_i)}} F(xi)=∑i=0kexp(xi)exp(xi) | F ( x ) = 1 1 + e x p ( − x ) F(x)= \frac{1} {1+exp(-x)} F(x)=1+exp(−x)1 |

| 本质 | 离散概率分布 | 非线性映射 |

| 任务 | 多分类 | 二分类 |

| 定义域 | 某个一维向量 | 单个数值 |

| 值域 | [0, 1] | (0, 1) |

| 结果之和 | 一定为1 | 为某个正数 |

4963

4963

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?