01引言

AI智能体不仅仅是花哨的聊天机器人——它们更像是能自主"思考"和行动的智能助手,能够协调多个步骤或工具来完成目标。在实际应用中,智能体通常结合大语言模型(LLM)的推理能力与外部工具(数据库、API等)来处理复杂任务。

Anthropic将这类架构统称为智能体系统,其核心区别在于:工作流沿预定义代码路径运行,而真正的智能体允许LLM动态决定后续动作。随着越来越多产品依赖LLM进行多步推理,运用经典设计模式来组织这些步骤变得至关重要。正如软件设计模式那样,这些AI工作流模式提供了将复杂任务分解为可管理模块的蓝图,使系统更易于构建、调试和扩展。

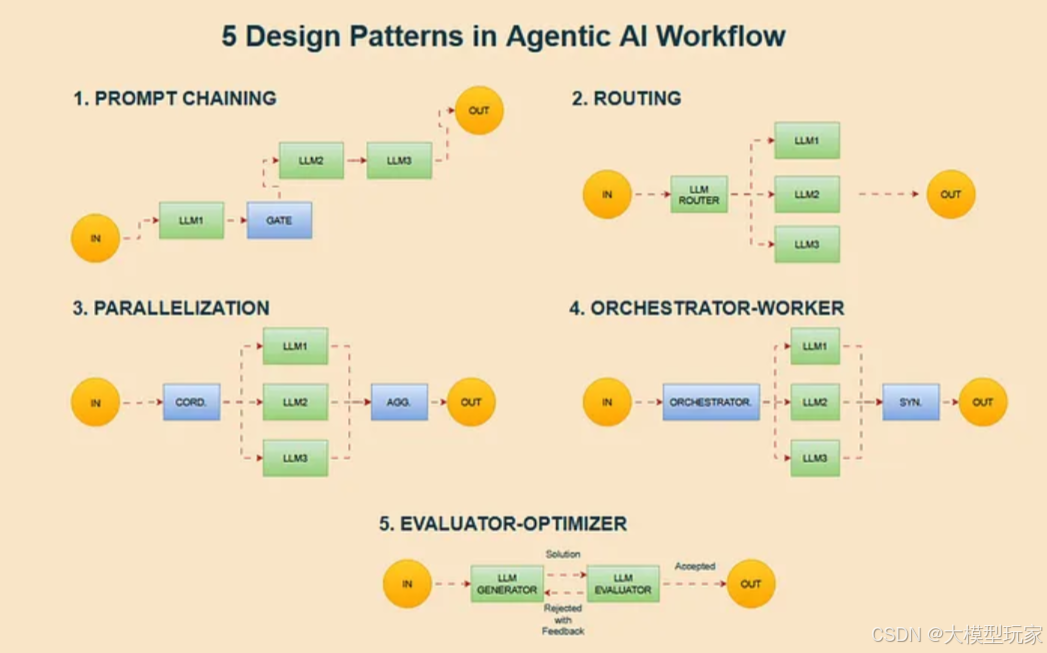

以下是确保智能体工作流畅运行的五大核心模式,每种模式都代表编排LLM调用与工具使用的典型方法。下文将逐一深入解析这些模式。

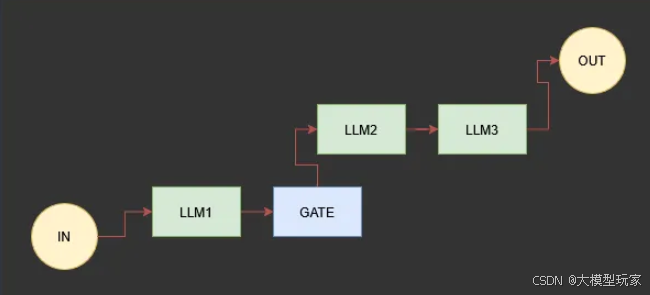

02 Prompt Chaining

提示链(Prompt Chaining)正如其名:将一系列提示串联起来,前一个LLM调用的输出成为下一个提示的输入。换句话说,你需要把任务分解成一个固定的、循序渐进的流程。

例如,要撰写一份报告,第一个提示可能负责生成大纲,第二个填充细节,最后一个优化语言表达。

关键在于,每个步骤都有明确分工,使得每次LLM查询更简单、更精准。正如某指南所述:“提示链将任务分解为一系列步骤,每个LLM调用都处理前一个步骤的输出。”

这种模式就像流水线或烹饪食谱:每个工位(或厨师)都会对产品进行加工,然后传递给下一步。虽然速度较慢(需要更多轮LLM调用),但能显著提升质量。

当任务具有明确的顺序(例如,“提纲→草稿→编辑”)或者你希望通过逐步处理以在速度和准确性之间进行权衡时,可以使用提示链模式。在实际应用中,许多LLM框架都支持轻松实现提示链:只需循环执行每个步骤,用前一个步骤的答案作为下一步的输入,最终生成输出。

**适用场景:**具有明确、有序步骤的任务(例如,多部分问答、结构化分析)。

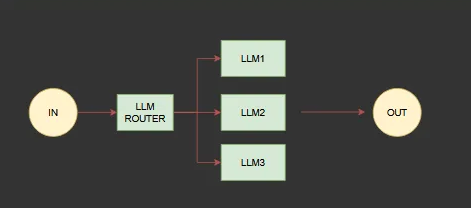

03 Routing

路由模式(Routing)的核心在于智能分配:通过LLM(或简单分类器)分析输入内容,将其分类并引导至专属子任务或智能体处理,而非使用单一通用提示。

例如,客户邮件可能根据内容被路由至「退款处理」智能体或「技术支持」智能体,使每个智能体专注于特定领域,从而提升专业度。

正如Anthropic所述:“路由机制对输入进行分类,并将其定向到专门的后续任务”,这种关注点分离的设计能避免单一提示试图处理所有问题。

可将路由想象成一位友善的前台或客服总机:“您需要什么帮助?”——随后将您转接至对应部门。

若缺乏路由机制,开发者可能将所有规则塞进单一提示,试图一次性处理所有可能的输入,结果往往导致混乱或"样样通、样样松"的效果。而路由模式能让每个分支流程得到针对性优化。

**适用场景:**当你面对不同类别的请求,需要采取非常不同的处理方式(例如,文本摘要、翻译、分类等)。

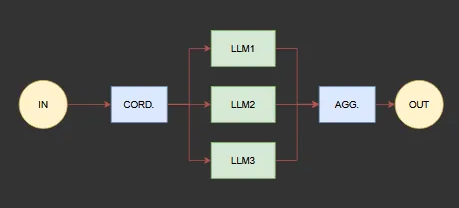

04Parallelization

并行化(Parallelization)使智能体能同时执行多项任务并合并结果,主要体现为两种形式:

- 分块处理(Sectioning):将任务拆分为可并行执行的独立子任务。例如同时分析产品的不同功能特性。

- 投票表决(Voting):多次运行相同提示(可调整参数或使用不同模型)获得多样答案后汇总(如采用多数决或集成学习)。

正如LangChain开发者所述:“LLM有时能同步处理任务,并通过编程方式聚合输出结果”。

换言之,同时发起多个LLM调用后,通过规则或另一个模型整合输出。这种方式能显著提升速度与鲁棒性:并行执行节省时间(无需等待长链条任务依次完成),而投票机制可增强可靠性(若五个模型中有三个达成共识,答案大概率正确)。

例如,假设你需要写一个关于同一主题的创意故事、一首搞笑诗和一份事实摘要。你可以同时启动三个LLM实例——一个写故事,一个写诗,一个写摘要——然后将它们的输出拼接成一个完整的响应。

**适用场景:**适合需要处理大型或时间敏感任务、或者希望从多个角度获得不同观点的情况。

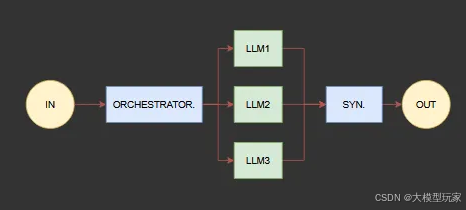

05Orchestrator–Worker

指挥者-工作者模式(Orchestrator–Worker)的核心在于动态任务委派:

- 中央指挥者(由LLM驱动)接收输入后实时分解任务

- 工作者智能体(多个LLM实例)并行处理细分任务

- 指挥者最终整合各模块输出形成完整解决方案

正如Anthropic所定义:“中央LLM动态分解任务、分配给工作者LLM执行,并合成最终结果”。这种模式特别适用于无法预判完整工作流的场景。

例如,在一个编码智能体中,指挥者可能会分析一份bug报告,并决定需要修改三个不同的文件——直到阅读输入之前,它都不知道这些子任务。然后,它将每个文件的任务发送给不同的代码编写LLM,等待它们的修补方案,最后合并或审核它们。

一个日常的比喻是厨房里的主厨:他们根据订单(任务)动态分配冷盘/热厨/甜点工位(子任务),然后品尝或组合所有的菜肴。或者可以想象成项目经理,指派任务给团队成员,并收集进展情况。关键在于适应性——每个新输入都可能产生不同的子任务组合。

**适用场景:**适合处理那些子任务依赖具体问题的复杂任务,例如多文件代码任务、综合报告等。

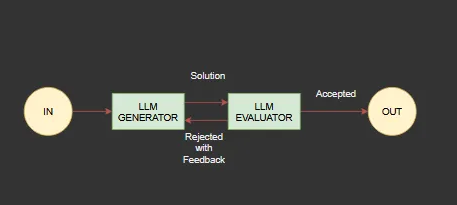

06 Evaluator–Optimizer

评估器-优化器(有时称为generator–critic 循环)将两个智能体配对工作:一个负责生成响应,另一个负责评估并提出改进建议。

本质上这是一个反馈循环:生成器大语言模型写出答案,评估器大语言模型进行评分或批评(指出问题或打分),随后生成器根据反馈修改输出。该循环可重复进行,直至答案达到质量标准。

这个过程类似于学生写作文、教师批改、学生根据评语重写的流程。正如某描述所言:“一个大语言模型调用生成响应,另一个则在循环中持续提供评估和反馈”。

例如:首先生成初始代码方案,随后交由自动化"审查器"检查代码风格或正确性;若评估器发现问题,会指导智能体如何修正,智能体则进行新一轮尝试。

该模式能显著提升可靠性和精细度,特别适用于存在明确质量标准的场景(语法正确性、事实准确性、测试通过率)。每一轮批评都推动输出更接近目标。

**适用场景:**需要迭代优化的任务,例如创意写作或有精确要求的代码生成。

07 为什么需要学习这些模式?

理解这些模式绝非纸上谈兵——它对构建可靠、可维护的AI系统至关重要。

产品团队通过选择正确模式(或组合运用),能让复杂的智能体工作流既清晰又健壮。

模块化模式意味着大家可以单独测试优化某个环节,而不会影响整体系统。这些模式还能帮助控制延迟和成本:大家可以自主决定何时并行处理或拆分任务,何时采用顺序链式执行。值得庆幸的是,现代框架正在不断涌现以应对这种复杂性。

例如,开发者常用LangChain(及其LangGraph扩展)、CrewAI等平台快速搭建智能体应用原型。微软开源的AutoGen库则专门针对多智能体工作流设计。这些工具提供了任务链、路由选择、流程编排等基础模块,让你能专注于业务逻辑而非底层实现。

总之,智能体工作流正处在AI产品设计的前沿。产品经理和工程师若能识别并应用这五大模式,就能设计出不仅更智能、而且具备扩展性和迭代便利性的系统。

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

如果你真的想学习大模型,请不要去网上找那些零零碎碎的教程,真的很难学懂!你可以根据我这个学习路线和系统资料,制定一套学习计划,只要你肯花时间沉下心去学习,它们一定能帮到你!

大模型全套学习资料领取

这里我整理了一份AI大模型入门到进阶全套学习包,包含学习路线+实战案例+视频+书籍PDF+面试题+DeepSeek部署包和技巧,需要的小伙伴文在下方免费领取哦,真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

部分资料展示

一、 AI大模型学习路线图

整个学习分为7个阶段

二、AI大模型实战案例

涵盖AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,皆可用。

三、视频和书籍PDF合集

从入门到进阶这里都有,跟着老师学习事半功倍。

四、LLM面试题

五、AI产品经理面试题

六、deepseek部署包+技巧大全

😝朋友们如果有需要的话,可以V扫描下方二维码联系领取~

468

468

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?