今天要给大家推荐项目是VLM-R1!它将DeepSeek的R1方法(基于GRPO强化学习技术)从纯文本领域成功迁移到视觉语言模型

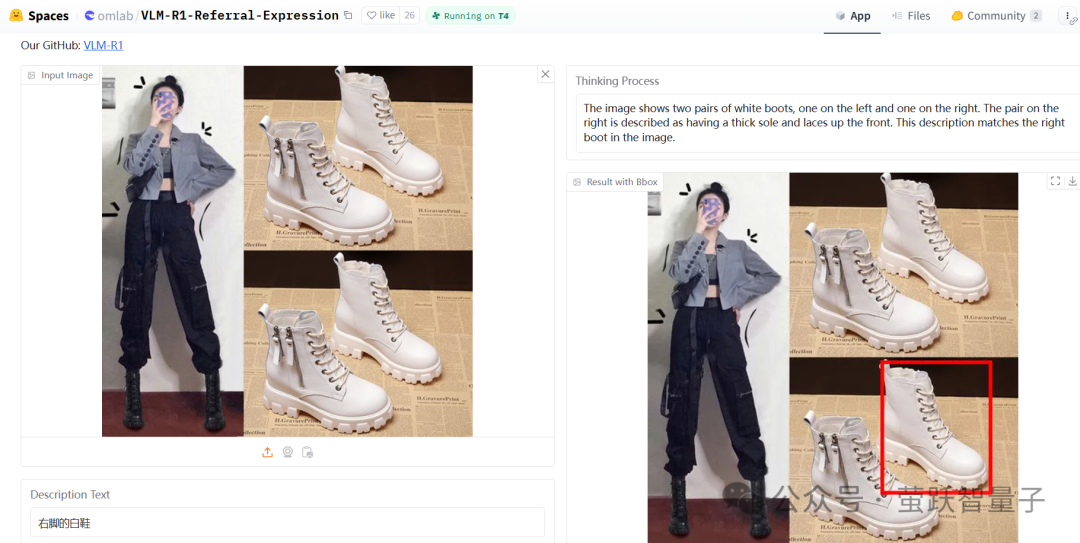

VLM-R1的核心创新在于将DeepSeek的GRPO(Group Relative Policy Optimization)强化学习技术从文本领域迁移到视觉领域。简单来说,就是用文本领域“打游戏通关”的思路,训练视觉模型“看图解题”:

-

GRPO强化学习

:通过动态调整奖励函数,让模型从“死记硬背”转向“理解本质”。例如在蛋白质识别任务中,模型不仅能说出“面饼蛋白质高”,还能精准框选出鸡蛋饼的位置!

-

稳定性碾压传统方法

:在复杂场景下,R1模型性能始终在线,而传统SFT模型越训练越“糊涂”(领域外数据表现暴跌)

2025年2月21日,已经发布了模型的检查点:快照

https://huggingface.co/omlab/Qwen2.5VL-3B-VLM-R1-REC-500steps

官方的Demo试了下,有些图片不支持,不造为啥。

还是很震撼的。

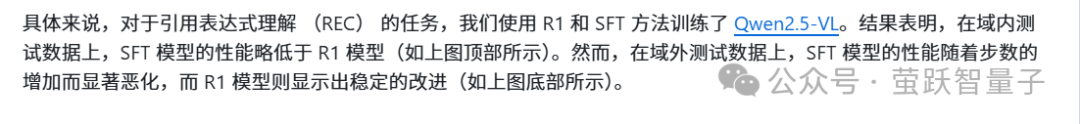

找了一张模特自拍,让他找手机。完美

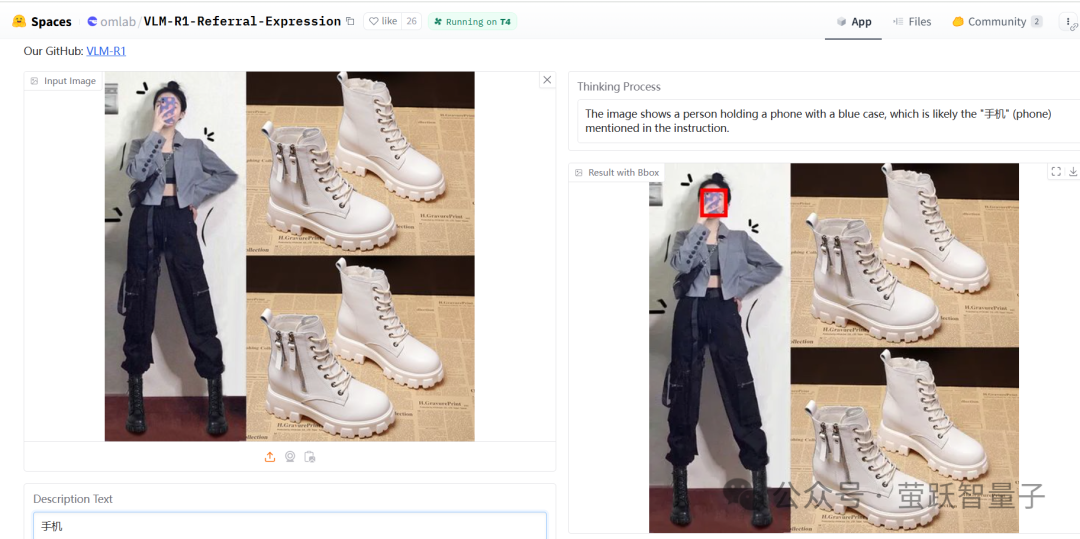

找所有白鞋。OK

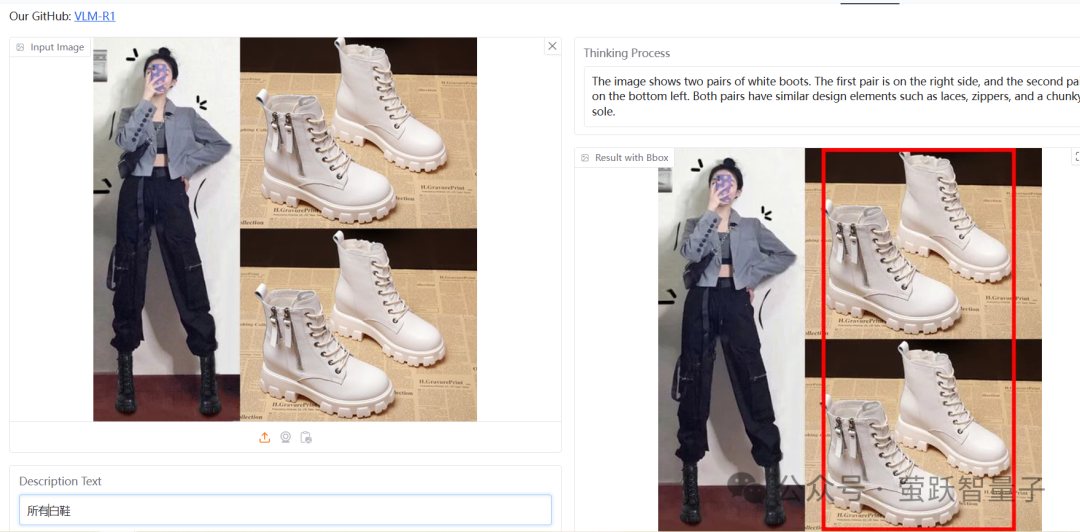

找“右脚的白鞋”错误。

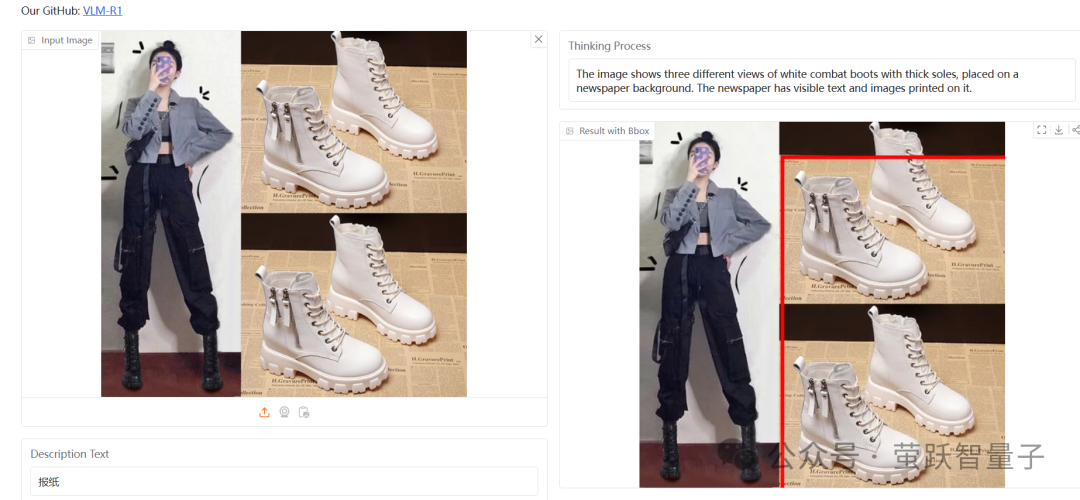

找报纸 OK

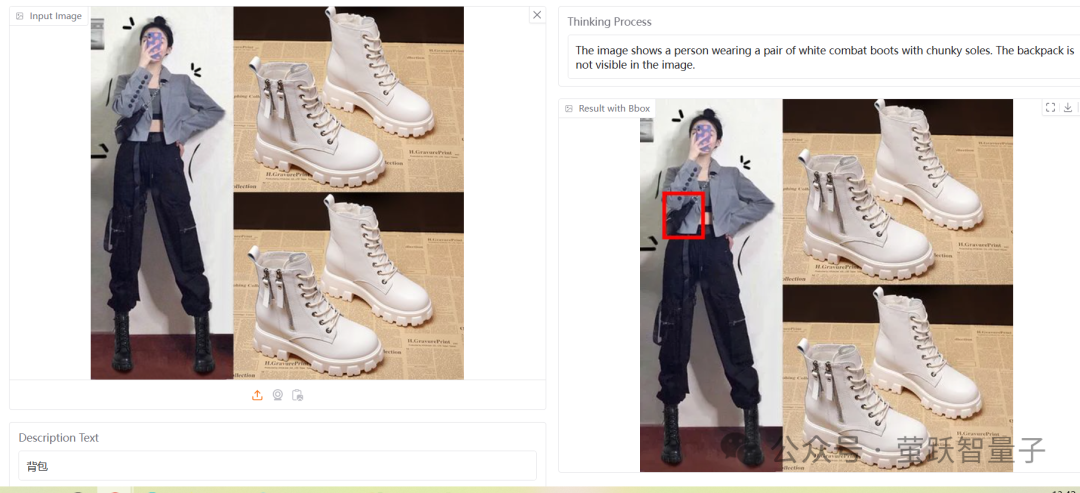

背包也OK

Think的过程目前还是英文,但基本不影响结果。

LLM学会反思,下一步就要学会提问了

AI大模型学习福利

作为一名热心肠的互联网老兵,我决定把宝贵的AI知识分享给大家。 至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

大模型&AI产品经理如何学习

求大家的点赞和收藏,我花2万买的大模型学习资料免费共享给你们,来看看有哪些东西。

1.学习路线图

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

2.视频教程

网上虽然也有很多的学习资源,但基本上都残缺不全的,这是我自己整理的大模型视频教程,上面路线图的每一个知识点,我都有配套的视频讲解。

(都打包成一块的了,不能一一展开,总共300多集)

因篇幅有限,仅展示部分资料,需要点击下方图片前往获取

3.技术文档和电子书

这里主要整理了大模型相关PDF书籍、行业报告、文档,有几百本,都是目前行业最新的。

4.LLM面试题和面经合集

这里主要整理了行业目前最新的大模型面试题和各种大厂offer面经合集。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

508

508

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?