XGBoost(eXtreme Gradient Boosting)是一种基于梯度提升的机器学习算法,其核心思想是通过前向分布算法(Forward Stagewise Algorithm)逐步构建一个加法模型,最终由多棵回归树组成。以下是对XGBoost模型形式的详细分析:

1. 模型形式

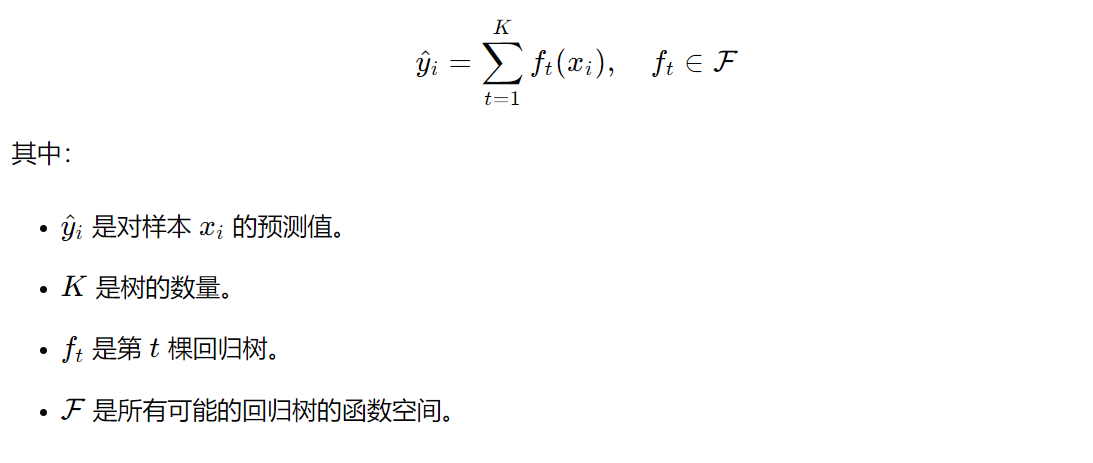

XGBoost的模型形式是一个加法模型,表示为:

2. 前向分布算法

XGBoost通过前向分布算法逐步构建每棵树。每一步的目标是通过添加一棵新的树来最小化损失函数。具体步骤如下:

-

初始化:从一个简单的初始模型开始,通常是常数预测。

-

迭代构建树:在每一步 (t),通过优化目标函数来确定新的树 (f_t)。

3. 目标函数

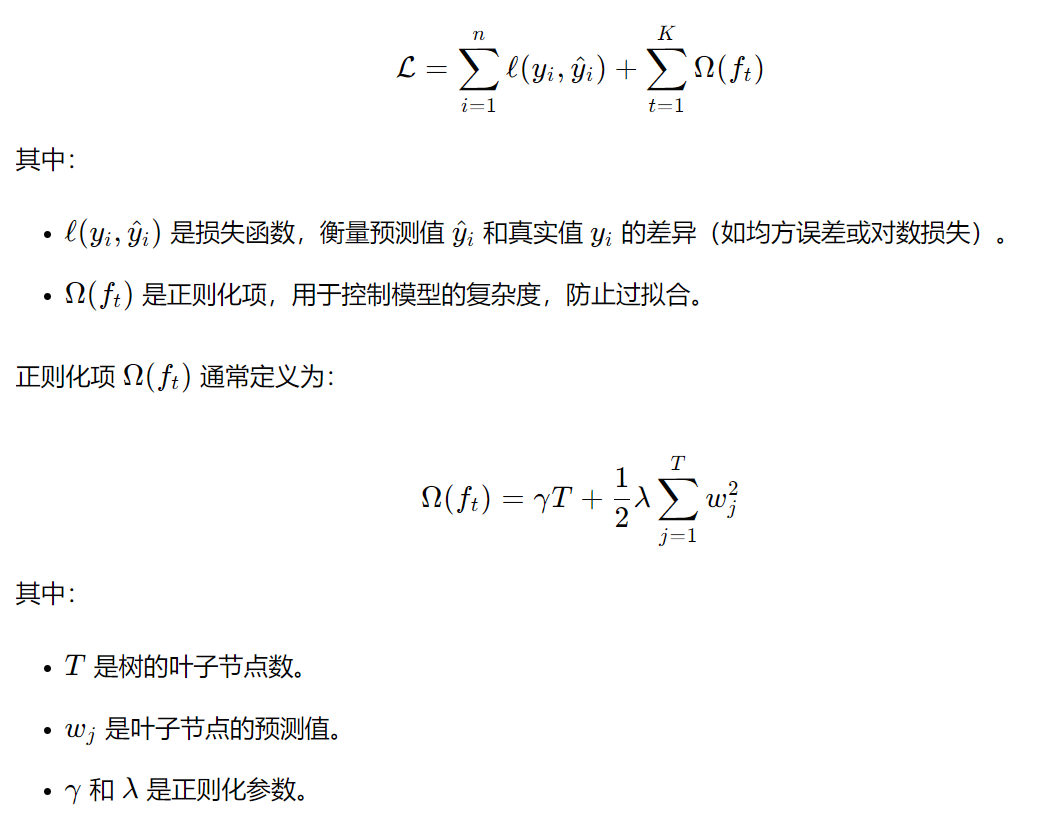

XGBoost的目标函数是损失函数与正则化项的组合:

4. 梯度提升

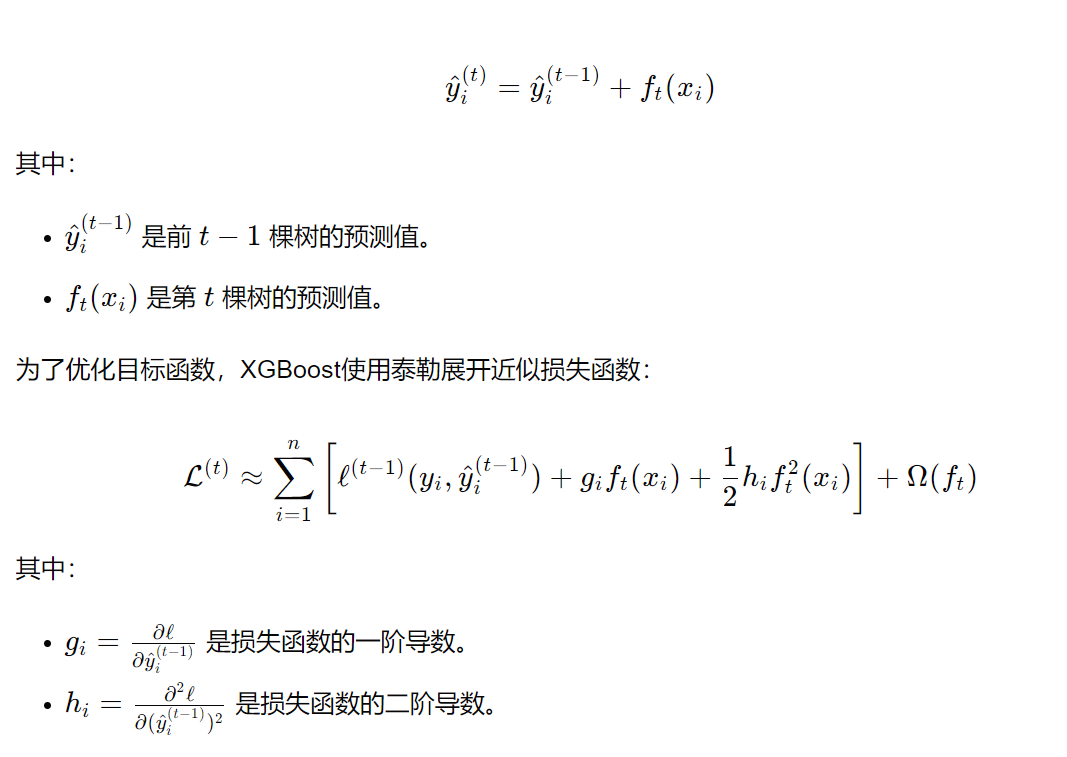

XGBoost通过梯度提升的思想来优化目标函数。每一步 (t),模型的预测值可以表示为:

5. 树的结构与叶子节点预测

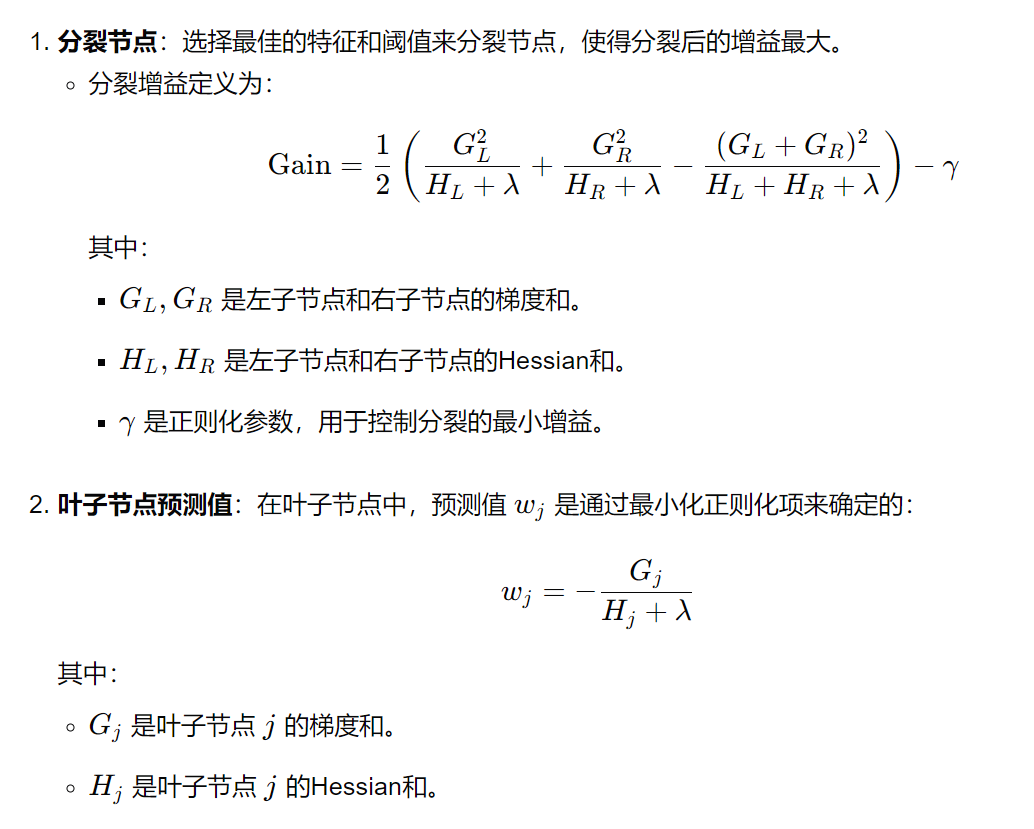

每棵树的结构和叶子节点的预测值是通过以下步骤确定的:

6. 模型优势

-

高效性:XGBoost通过并行计算和稀疏感知优化提高了训练速度。

-

灵活性:支持多种损失函数和正则化项,适用于回归、分类等任务。

-

正则化:通过正则化项 (\Omega(f_t)) 防止过拟合,提高模型的泛化能力。

总结来说,XGBoost通过前向分布算法逐步构建多棵回归树,每棵树的结构和叶子节点的预测值是通过优化目标函数(损失函数 + 正则化项)来确定的。这种设计使得XGBoost在许多机器学习任务中表现出色。

2096

2096

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?