任务概览

1、基础任务:

- 使用结合W4A16量化与kv cache量化的

internlm2_5-1_8b-chat模型封装本地API并与大模型进行一次对话,作业截图需包括显存占用情况与大模型回复,参考4.1 API开发(优秀学员必做),请注意2.2.3节与4.1节应使用作业版本命令。 - 使用Function call功能让大模型完成一次简单的"加"与"乘"函数调用,作业截图需包括大模型回复的工具调用情况,参考4.2 Function call(选做)

开始任务:

基础任务:

启动 30%A100*1(24GB显存容量)开发机,创建一个名为lmdeploy的conda环境,python版本为3.10,创建成功后激活环境并安装0.5.3版本的lmdeploy及相关包。

conda create -n lmdeploy python=3.10 -y

conda activate lmdeploy

conda install pytorch==2.1.2 torchvision==0.16.2 torchaudio==2.1.2 pytorch-cuda=12.1 -c pytorch -c nvidia -y

pip install timm==1.0.8 openai==1.40.3 lmdeploy[all]==0.5.3

pip install datasets==2.19.2

为方便文件管理,文件统一放置在/root/models/目录用于存放模型。运行命令,创建文件夹并设置开发机共享目录的软链接。

mkdir /root/models

ln -s /root/share/new_models/Shanghai_AI_Laboratory/internlm2_5-7b-chat /root/models

ln -s /root/share/new_models/Shanghai_AI_Laboratory/internlm2_5-1_8b-chat /root/models

ln -s /root/share/new_models/OpenGVLab/InternVL2-26B /root/models

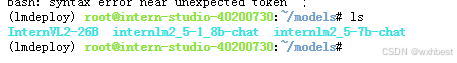

执行完毕,可以看到/root/models中会出现internlm2_5-7b-chat、internlm2_5-1_8b-chat和InternVL2-26B文件夹。

先测一下获取到的文件模型是否能够正常使用。

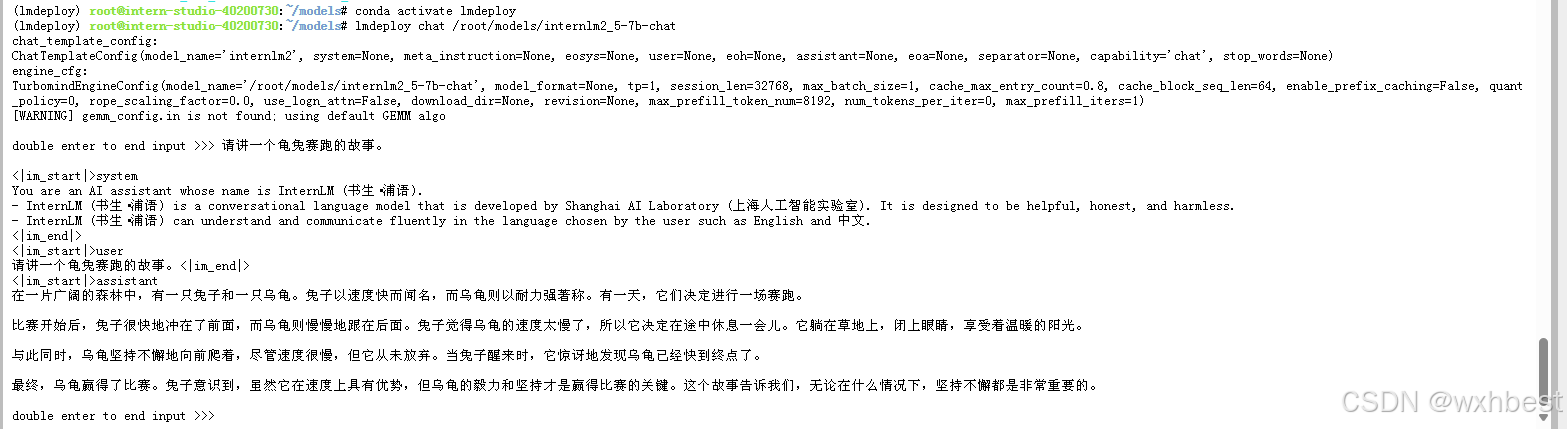

conda activate lmdeploy

lmdeploy chat /root/models/internlm2_5-7b-chat

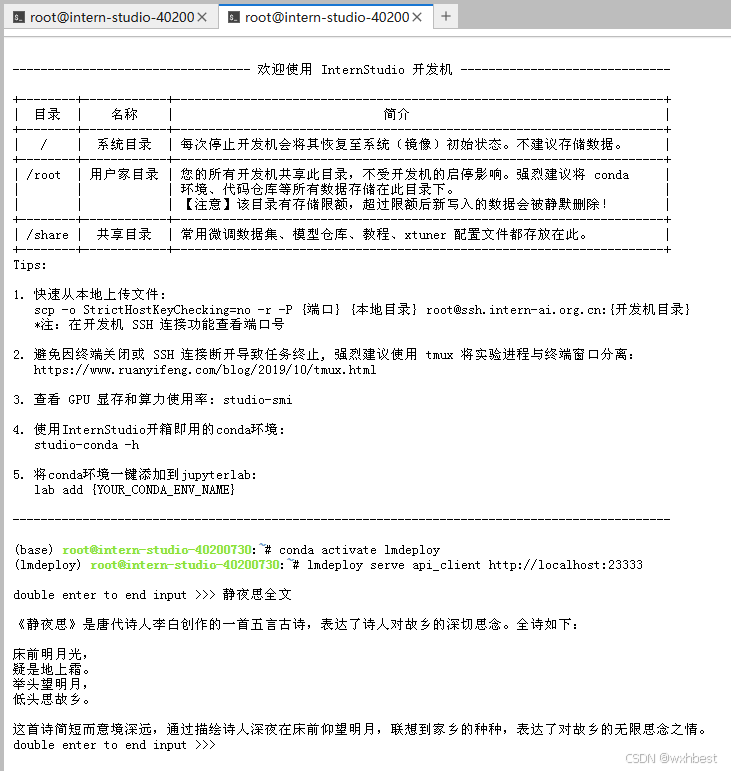

执行命令如果成功,会显示如下,同时我们测试一下相关功能,注意输入内容完成后需要按两次回车才能够执行,以下为示例。

同时可以看到,显存占用非常厉害。

接下来,我们将大模型封装为API接口服务来使用。

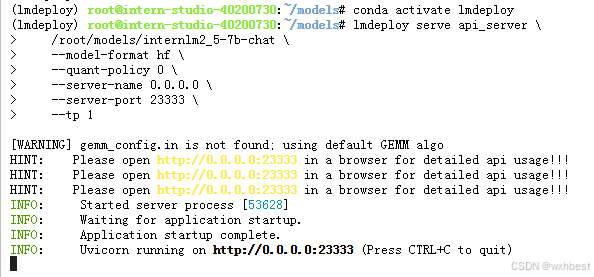

首先进入创建好的conda环境,启动API服务器

conda activate lmdeploy

lmdeploy serve api_server \

/root/models/internlm2_5-7b-chat \

--model-format hf \

--quant-policy 0 \

--server-name 0.0.0.0 \

--server-port 23333 \

--tp 1

稍待片刻,显示如下。

然后本地输入下面的命令,做一下ssh转发就能直接访问了。

ssh -CNg -L 23333:127.0.0.1:23333 root@ssh.intern-ai.org.cn -p 你的ssh端口号

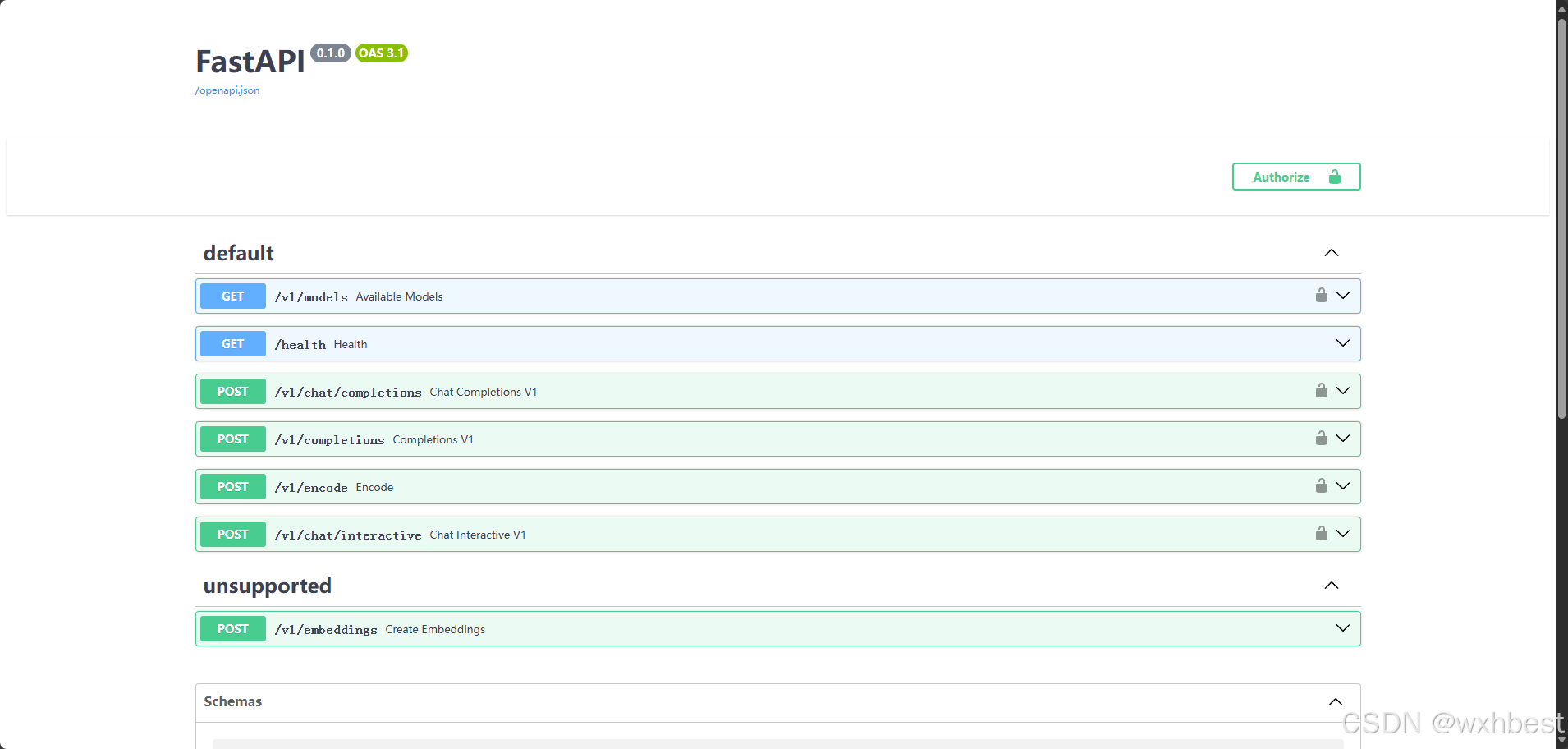

然后打开浏览器,访问http://127.0.0.1:23333看到如下界面即代表部署成功。

当然,通过新建一个终端,也能打开命令行的conda界面。

conda activate lmdeploy

lmdeploy serve api_client http://localhost:23333

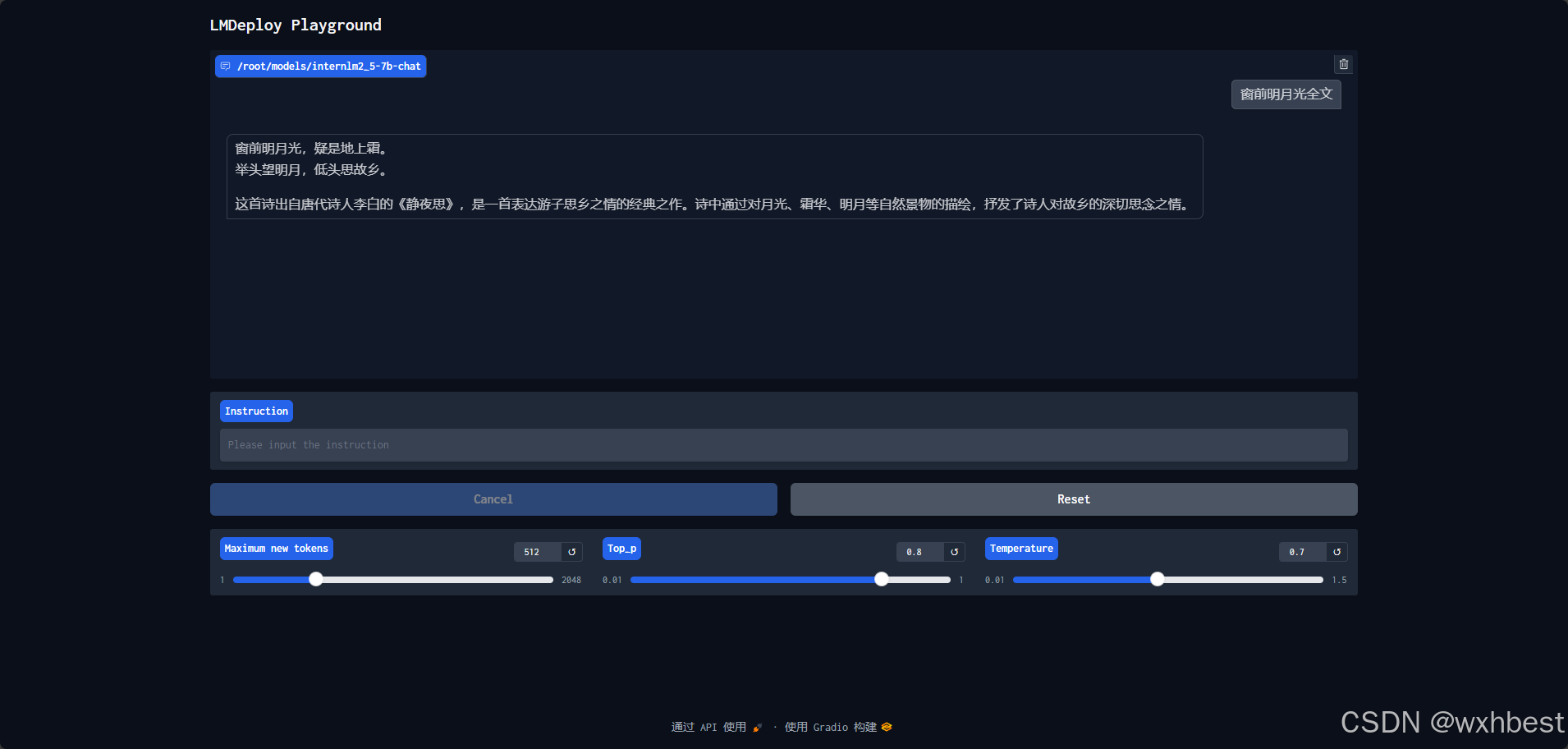

以Gradio网页形式连接API服务器

输入如下命令,一样通过ssh的转发在本地打开浏览器。

lmdeploy serve gradio http://localhost:23333 \

--server-name 0.0.0.0 \

--server-port 6006

根据教程,接下来设置最大kv cache缓存大小,输入下面的命令:

lmdeploy chat /root/models/internlm2_5-7b-chat --cache-max-entry-count 0.4

可以看到,显存的占用由原先的94.2%下降至了78.27%

![]()

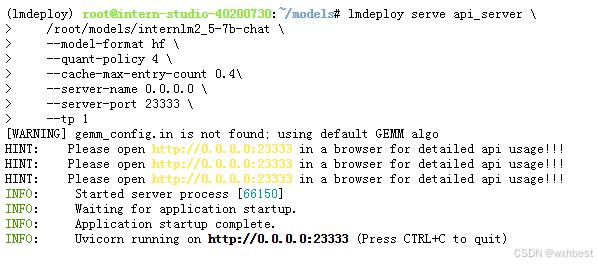

设置在线 kv cache int4/int8 量化

通过2.1 LMDeploy API部署InternLM2.5的实践为例,输入以下指令,启动API服务器

lmdeploy serve api_server \

/root/models/internlm2_5-7b-chat \

--model-format hf \

--quant-policy 4 \

--cache-max-entry-count 0.4\

--server-name 0.0.0.0 \

--server-port 23333 \

--tp 1

稍待片刻,显示如下即代表服务启动成功。

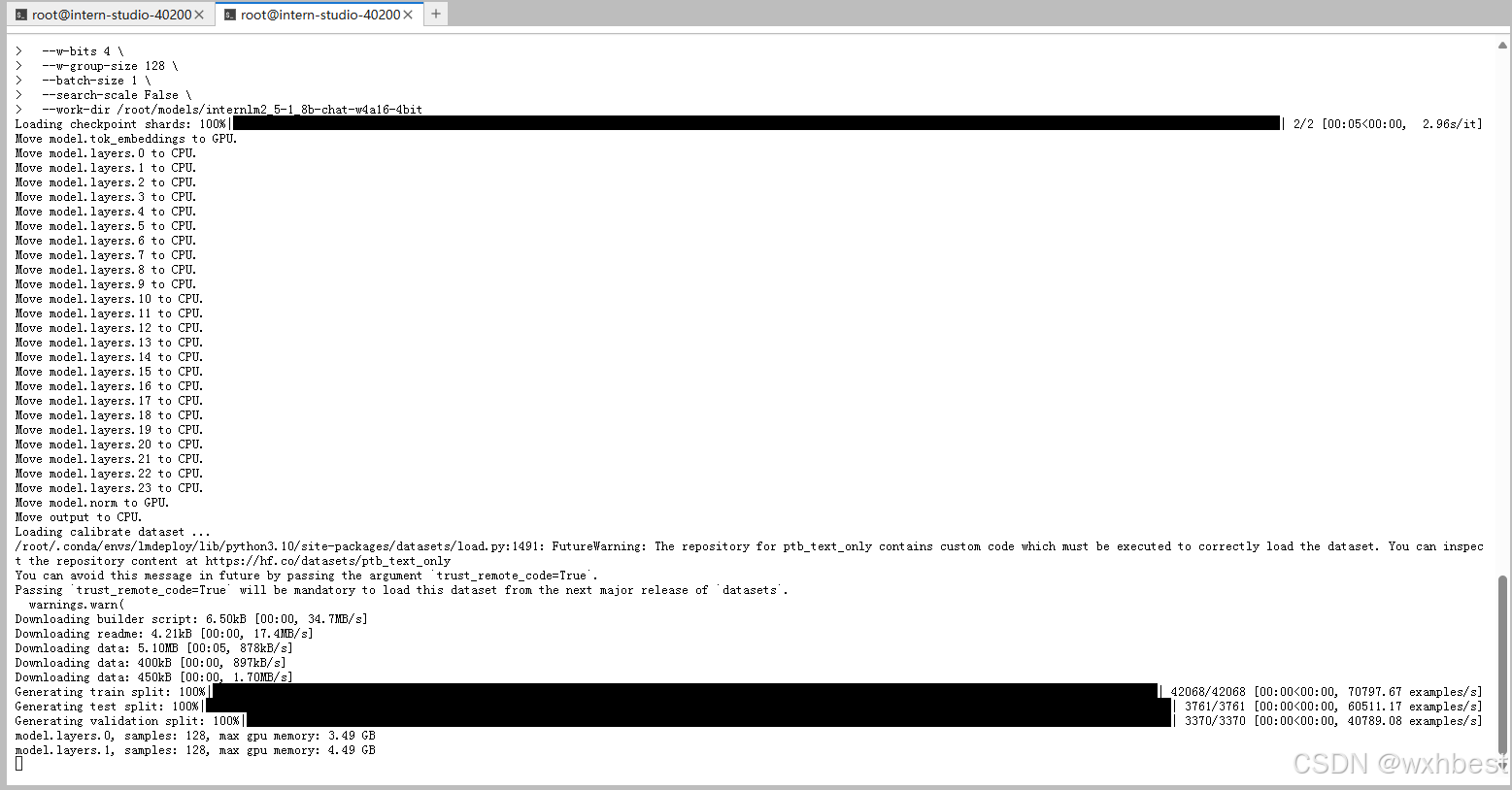

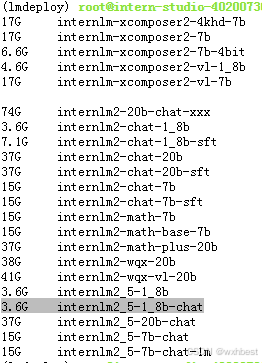

W4A16 模型量化和部署

输入以下指令,执行量化工作(因为2_5-7b太大了,耗时太长。所以我用2_5-1_8b来做复现)。

lmdeploy lite auto_awq \

/root/models/internlm2_5-1_8b-chat \

--calib-dataset 'ptb' \

--calib-samples 128 \

--calib-seqlen 2048 \

--w-bits 4 \

--w-group-size 128 \

--batch-size 1 \

--search-scale False \

--work-dir /root/models/internlm2_5-1_8b-chat-w4a16-4bit

等终端输出如下时,说明正在推理中,稍待片刻。

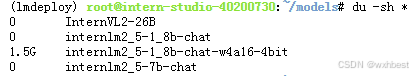

可以输入如下指令查看在当前目录中显示所有子目录的大小。

cd /root/models/

du -sh *

对比之后发现,大小小了很多。

显存占用情况对比呢?输入以下指令启动量化后的模型。

lmdeploy chat /root/models/internlm2_5-1_8b-chat-w4a16-4bit/ --model-format awq

原先的显存占用:

量化后的显存占用:

![]()

发现有了1.71%的下降。

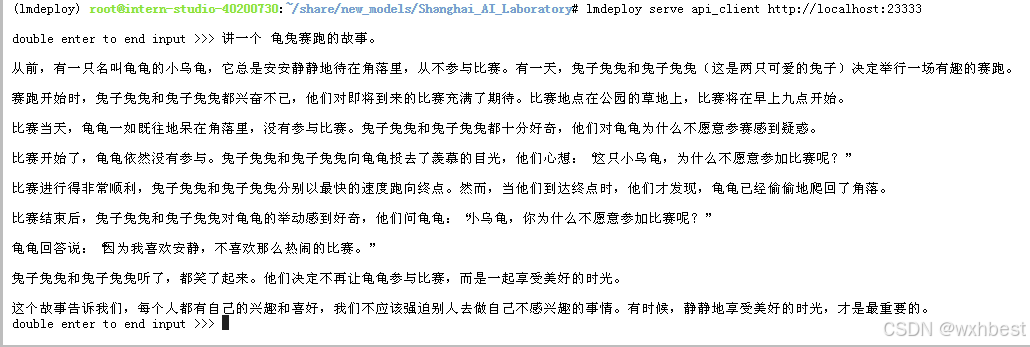

如果W4A16 量化+ KV cache+KV cache 量化也是可以的,执行下面的命令,完成课程任务。

lmdeploy serve api_server \

/root/models/internlm2_5-1_8b-chat-w4a16-4bit \

--model-format awq \

--quant-policy 4 \

--cache-max-entry-count 0.1\

--server-name 0.0.0.0 \

--server-port 23333 \

--tp 1

通过命令行执行;

lmdeploy serve api_client http://localhost:23333

接下来复现一下LMDeploy之FastAPI与Function call的API开发,因为刚我们的API没关,可以继续。

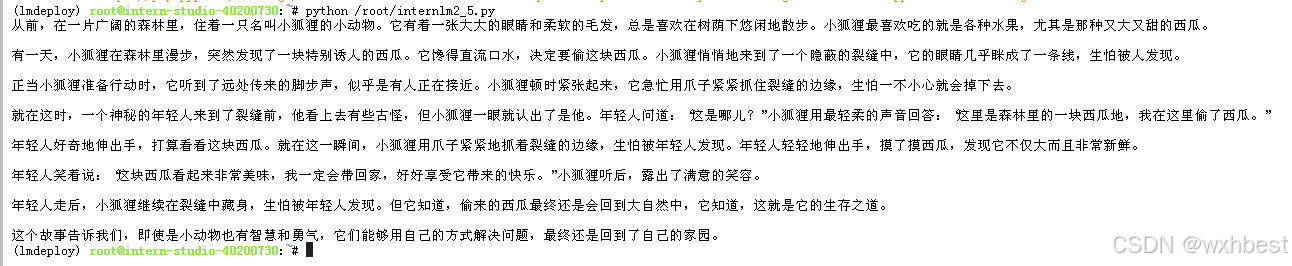

新建internlm2_5.py,输入下面代码。

touch /root/internlm2_5.py

# 导入openai模块中的OpenAI类,这个类用于与OpenAI API进行交互

from openai import OpenAI

# 创建一个OpenAI的客户端实例,需要传入API密钥和API的基础URL

client = OpenAI(

api_key='YOUR_API_KEY',

# 替换为你的OpenAI API密钥,由于我们使用的本地API,无需密钥,任意填写即可

base_url="http://0.0.0.0:23333/v1"

# 指定API的基础URL,这里使用了本地地址和端口

)

# 调用client.models.list()方法获取所有可用的模型,并选择第一个模型的ID

# models.list()返回一个模型列表,每个模型都有一个id属性

model_name = client.models.list().data[0].id

# 使用client.chat.completions.create()方法创建一个聊天补全请求

# 这个方法需要传入多个参数来指定请求的细节

response = client.chat.completions.create(

model=model_name,

# 指定要使用的模型ID

messages=[

# 定义消息列表,列表中的每个字典代表一个消息

{"role": "system", "content": "你是一个友好的小助手,负责解决问题."},

# 系统消息,定义助手的行为

{"role": "user", "content": "帮我讲述一个关于狐狸和西瓜的小故事"},

# 用户消息,询问时间管理的建议

],

temperature=0.8,

# 控制生成文本的随机性,值越高生成的文本越随机

top_p=0.8

# 控制生成文本的多样性,值越高生成的文本越多样

)

# 打印出API的响应结果

print(response.choices[0].message.content)

然后运行代码;

python /root/internlm2_5.py

这里有一个问题,就是默认的openai库版本太低,只有1.40.3,运行报错。我通过pip install --upgrade openai命令将其升级到了最新版本。

接下来进行Function call,即函数调用功能的学习复现。

首先启动API服务器

conda activate lmdeploy

lmdeploy serve api_server \

/root/models/internlm2_5-7b-chat \

--model-format hf \

--quant-policy 0 \

--server-name 0.0.0.0 \

--server-port 23333 \

--tp 1

创建internlm2_5_func.py。

touch /root/internlm2_5_func.py

可以看到执行结果。

![]()

1620

1620

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?