DQN

DQN(Deep Q-network),基于深度学习的Q-learning算法,其结合了 Value Function Approximation(价值函数近似)与神经网络技术,并采用了目标网络(Target Network)和经验回放(Experience Replay)等方法进行网络的训练。

- 传统的强化学习算法会使用表格的形式存储状态值函数V(s)或状态动作值函数 Q(s,a),但是这样的方法存在很大的局限性。

- 例如:现实中的强化学习任务所面临的状态空间往往是连续的,存在无穷多个状态,在这种情况下,就不能再使用表格对值函数进行存储。

- 值函数近似利用函数直接拟合状态值函数或状态动作值函数,减少了对存储空间的要求,有效地解决了这个问题。

链接: EasyRL

一、价值函数近似(Value Function Approximation)

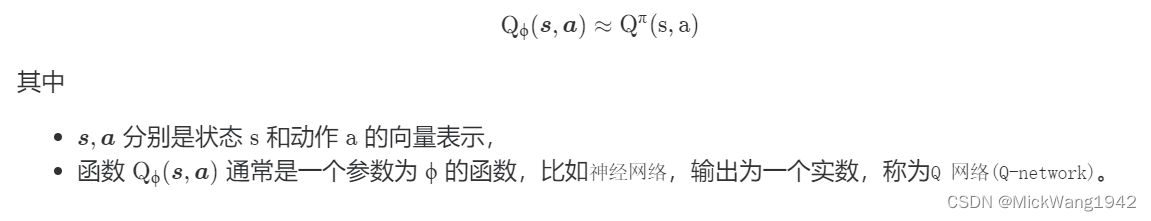

即:利用函数直接拟合状态值函数或状态动作值函数,这里的函数形式依赖于现实问题的复杂度。

为了便于接下来的模型表述,这里引入书中的三个元素:

- 评论家(critic),是我们的学习目标,比如:state value function(状态价值函数)、state-action value function(状态-动作价值函数)。

- 环境,具体的学习场景或学习过程,比如书中的 Atari 游戏。

- 演员(actor),就是agent,基于环境状态产生策略进而输出动作。

- 这边需要强调的一个点是说,评论家都是绑一个演员的,评论家没有办法去凭空去评价一个状态的好坏,它所评价的东西是在给定某一个状态的时候, 假设接下来互动的演员是 π,那我会得到多少奖励。

- 因为就算是给同样的状态,你接下来的 π 不一样,你得到的奖励也是不一样的。

即:评论家是基于演员与环境的交互过程(演员的策略V.S.环境的状态)进行评价的。

二、两种评估方法

下面分别讨论不同评论家的评估方法:

1. State Value Function Estimation(状态价值函数)

已知初始条件只有一个:状态(state)。

这类评论家又是如何去做评估的呢?有两种不同的做法:

- Monte-Carlo(MC)-based 的方法,Monte-Carlo(MC)-based基于(演员与环境的)完整(交互)过程的抽样。最大的问题:学习周期长;抽样数据方差大(环境状态本身的随机性和学习过程的随机性)。

- TD-based 的方法,Temporal-difference(时序差分),逐步的、逐个状态的或者逐个画面的学习过程,有点“各个击破”的意思。

TD-based 的学习过程是基于下面这个式子:

V π ( s t ) = V π ( s t + 1 ) + r t V^{\pi}(s_t) = V^{\pi}(s_{t+1}) + r_t Vπ(st)=Vπ(st

本文深入解析了DQN(Deep Q-Network)算法,介绍了价值函数近似、状态价值函数及状态-动作价值函数的评估方法,并详细阐述了DQN中目标网络和经验回放等关键技术。

本文深入解析了DQN(Deep Q-Network)算法,介绍了价值函数近似、状态价值函数及状态-动作价值函数的评估方法,并详细阐述了DQN中目标网络和经验回放等关键技术。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

103

103

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?