这个春节,科技界热闹非凡,DeepSeek的横空出世犹如一颗重磅炸弹,迅速引爆全球AI市场。

DeepSeek凭借其V3和新推出的R1两款模型,实现了与OpenAI 4o和o1比肩的性能,同时成本仅为十分之一,为AI技术的普及提供了经济高效的解决方案。DeepSeek的崛起,不仅标志着中国AI技术的突破,更预示着全球AI市场将迎来一场新革命。

将其部署在望获实时Linux与瑞芯微RK3588平台上,能够充分释放其在边缘计算和工业控制领域的巨大潜力,为智能化转型提供强有力的技术支撑。

以下是详细的部署步骤,帮助您快速实现这一国产技术组合的落地应用。

【望获实时Linux+NanoPC-T6】DeepSeek R1大模型部署-千元以内的国产解决方案

硬件准备:

-

RK3588开发板:京博航友善NanoPC-T6(预装望获实时Linux)

-

工作主机:ubuntu笔记本电脑

软件准备:

-

瑞芯微rkllm-toolkit工具

部署步骤

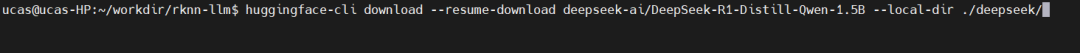

一、拉取模型

从Hugging Face拉取DeepSeek-R1的1.5B蒸馏模型到x86平台:

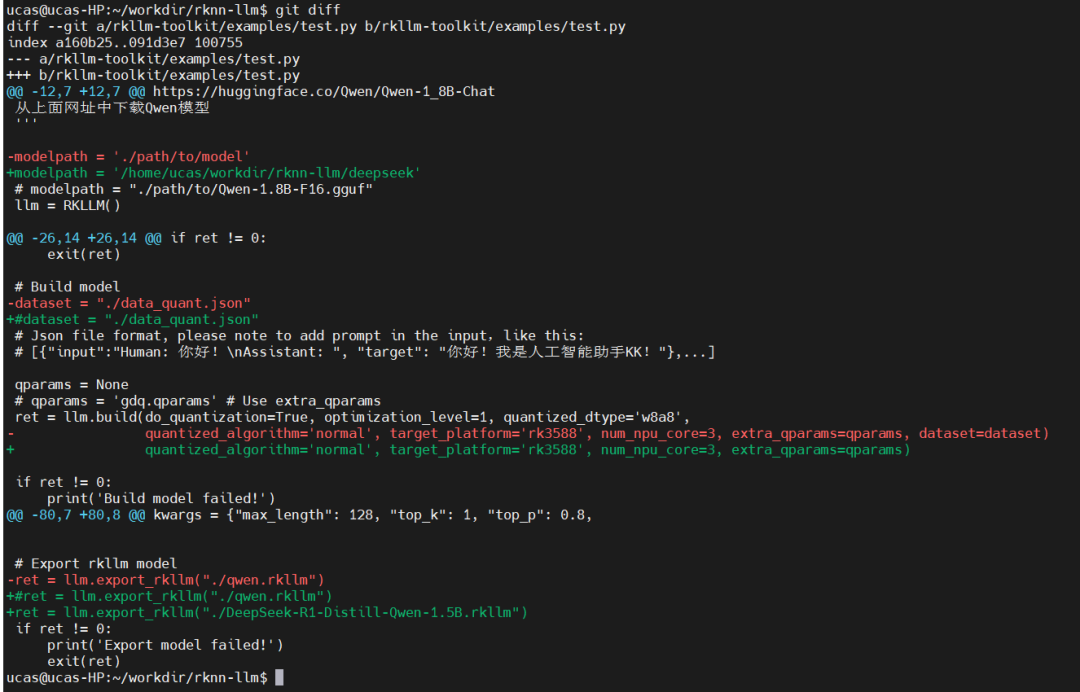

二、配置模型转换脚本

在rknn-llm/rkllm-toolkit/examples/test.py中,修改如下内容:

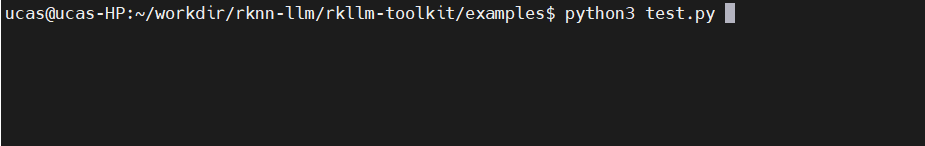

三、模型转换

执行模型转换脚本,等待转换完成:

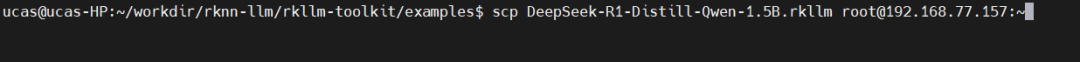

四、部署模型

使用scp命令将转换得到的DeepSeek-R1-Distill-Qwen-1.5B.rkllm文件拷贝到RK3588平台:

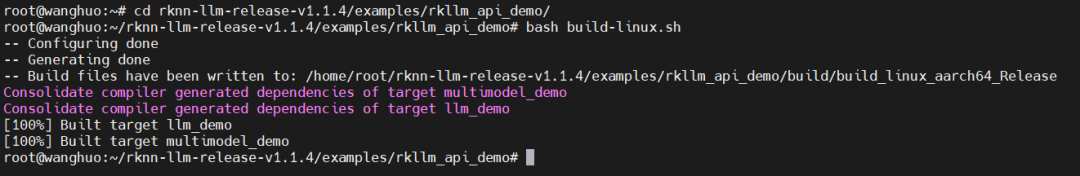

五、生成运行文件

在RK3588平台,进入rknn-llm/rkllm-runtime/examples/rkllm_api_demo目录,生成llm_demo运行文件:

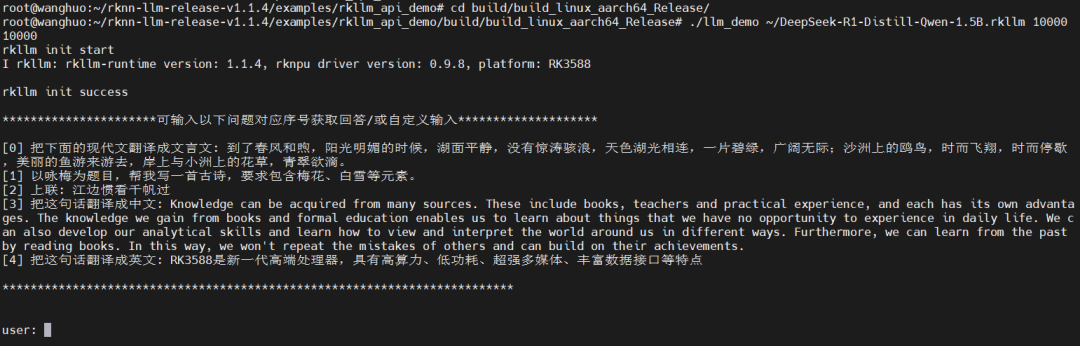

六、运行模型

运行llm_demo,并指定DeepSeek-R1-Distill-Qwen-1.5B.rkllm的路径。

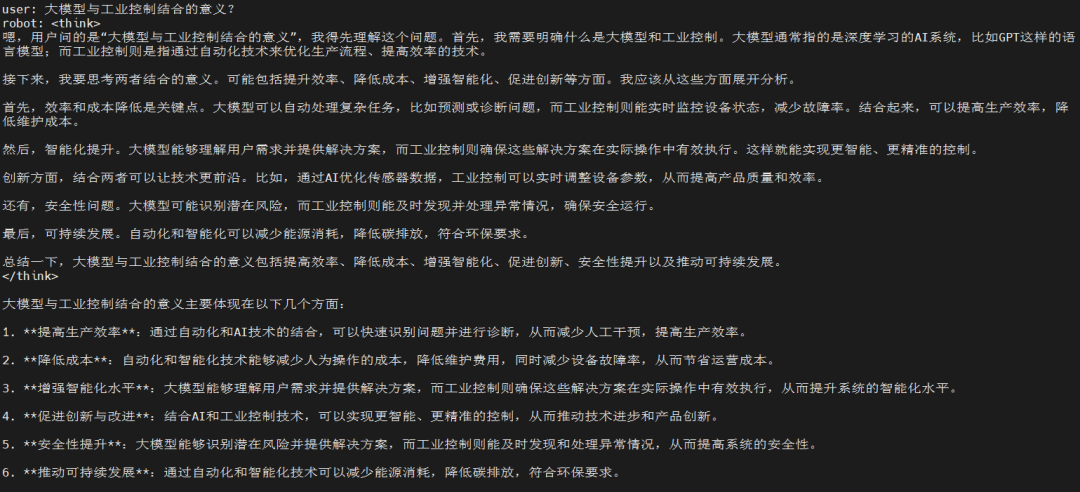

七、对话测试

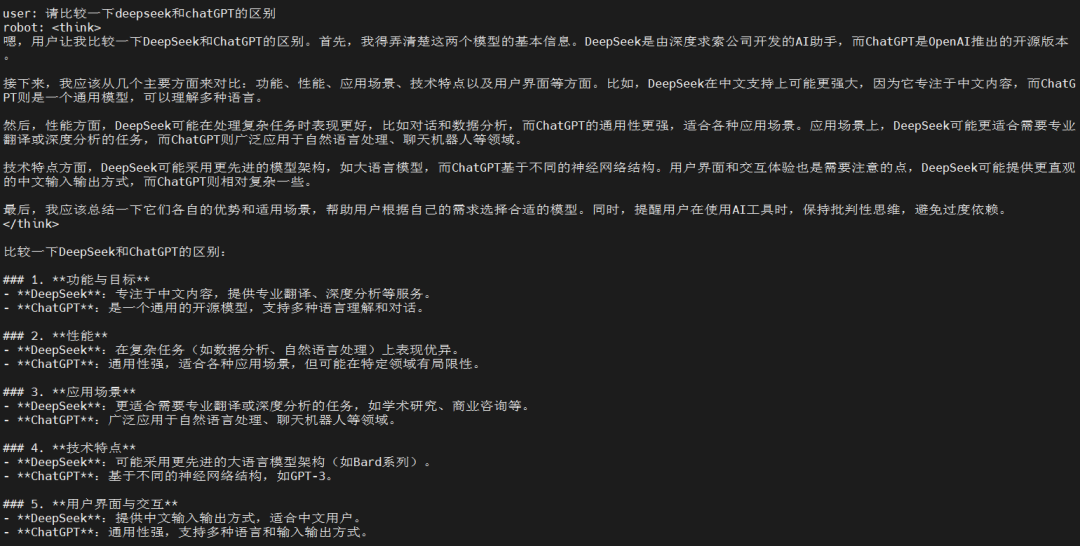

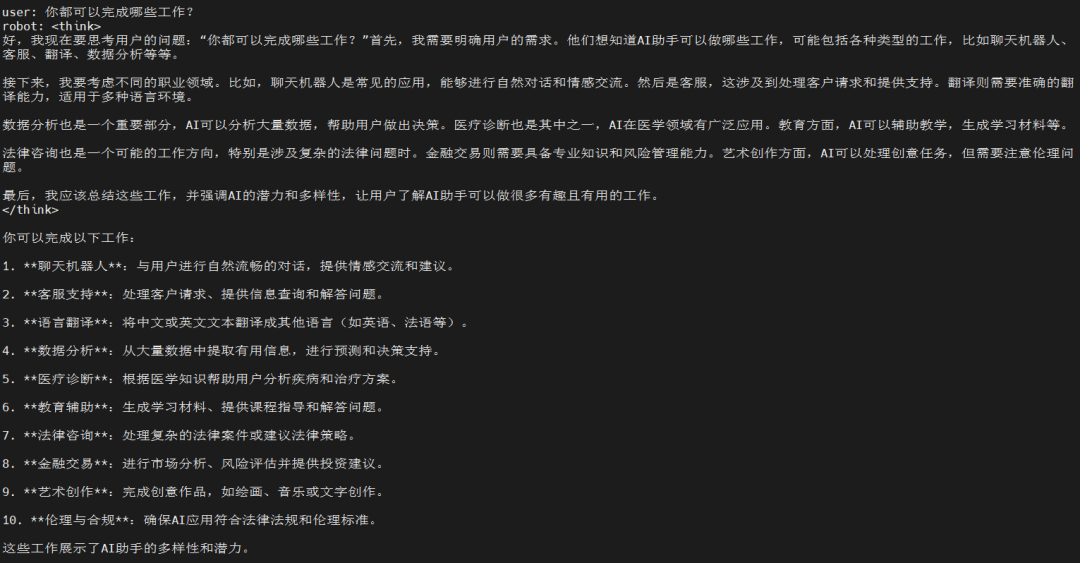

在user : 后输入对话内容,测试模型的运行效果。

通过将DeepSeek部署在望获实时Linux与RK3588的平台上,您可以轻松实现边缘智能的高效落地。这一技术组合提升了工业控制与边缘计算的智能化水平,为未来的工业应用开辟了新的可能性。如果您在部署过程中遇到任何问题,欢迎随时与我们联系!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?