一、 为什么需要知识图谱?

在大模型的检索增强生成(Retrieval-Augmented Generation, RAG)架构中,向量检索虽然能够高效匹配语义相似的文本,但仍然存在以下问题:

- 语义漂移:向量相似度检索可能会导致部分内容不准确,无法完全匹配用户的查询意图。

- 缺乏结构化理解:向量数据库存储的是高维向量,无法表达知识之间的逻辑和层次关系。

- 推理能力不足:RAG 依赖检索内容进行生成,但缺乏显式推理能力,无法直接基于已有知识推导出新结论。

- 数据更新难度大:传统 RAG 依赖大规模文档的索引和向量化,更新成本较高。

知识图谱能够有效解决这些问题,通过结构化的知识表达,使检索和生成更具逻辑性和精准性。

二、知识图谱是什么?

知识图谱(Knowledge Graph, KG)是一种用于表示和存储结构化知识的数据模型。其核心组成部分包括:

- 实体(Entity):现实世界中的对象,如电影、演员、导演等。

- 关系(Relation):实体之间的联系,如“出演”、“导演”、“获奖”等。

- 属性(Attribute):对实体的补充描述,如演员的年龄、国籍,电影的票房、评分等。

知识图谱的优势在于:

- 结构化知识表达:可清晰表达实体与关系,提高信息组织能力。

- 高效推理能力:基于图数据库可进行逻辑推理,实现更智能的检索和生成。

- 可扩展性强:知识图谱可以不断新增和更新数据,保持信息的时效性。

三、 知识图谱同 RAG 如何做到 1+1>2?

将知识图谱与 RAG 结合,可以大幅提升大模型的检索精度和生成质量。主要有以下优势:

1) 更精准的检索

- 通过知识图谱进行 关系推理,提升查询的准确性。

- 在 RAG 检索阶段,结合知识图谱的结构化数据,理解用户查询背后的语义,识别实体、关系等信息,从而更精准地把握用户需求。提升查询质量,进而增强结果的可读性和逻辑性。

2) 提升答案的可解释性

- RAG 直接检索向量数据,返回的内容缺乏解释性。如:向量检索返回的内容可能是多个相关段落的集合,但它们之间的逻辑关系、推理路径无法直观呈现。

- 结合知识图谱后,可以提供 推理路径,让答案更加可信。

3) 更有效的知识扩展及检索效率提升

- 传统 RAG 仅能检索已存文本,而知识图谱可以基于关系扩展更多相关内容,可以快速定位相关信息,提高检索效率。

- 例如,在查询“诺兰导演的科幻电影”时,知识图谱可以基于“导演-电影”关系补充更完整的电影列表。

4) 降低冗余,提高生成质量

- RAG 检索结果可能包含重复或无关内容,结合知识图谱中重要层次关系可以 过滤无关内容并优化排序。

- 结合知识图谱进行上下文关联,使 LLM 生成的文本更连贯、更准确、更可靠、更符合用户需求的文本内容。

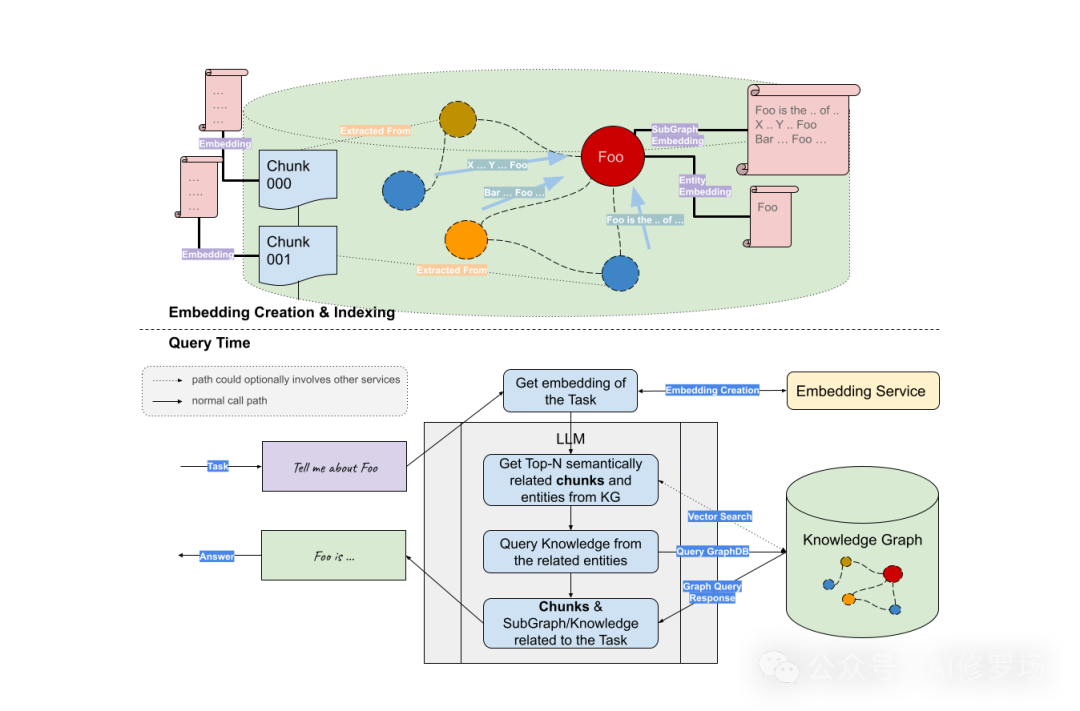

四、 知识图谱发挥作用的具体流程

在 RAG 系统中,知识图谱可以结合多个环节优化检索与生成,具体流程如下:

-

用户输入查询(Query)

-

向量检索(Vector Search):使用嵌入模型将查询转换为向量,查询向量数据库获取相关文本片段。

-

知识图谱匹配(Knowledge Graph Lookup):在知识图谱中查找相关实体和关系。

-

融合检索结果(Hybrid Retrieval):将向量检索结果和知识图谱查询结果合并,去重并排序。

-

构造提示词(Prompt Engineering):将优化后的知识输入大模型。

-

大模型生成(LLM Generation):模型基于结构化知识和检索内容生成答案。

-

答案输出(Response):最终呈现更精准、更具逻辑性的回答。

注:2、3是可以交叉执行的,如:结合用户查询,用text2cypher 或其他NLP将文本转换成图查询语言,从知识图谱获取信息,修正改写用户查询文本后,再去向量库查询,有时效果会更好。具体结合自身业务灵活运用。

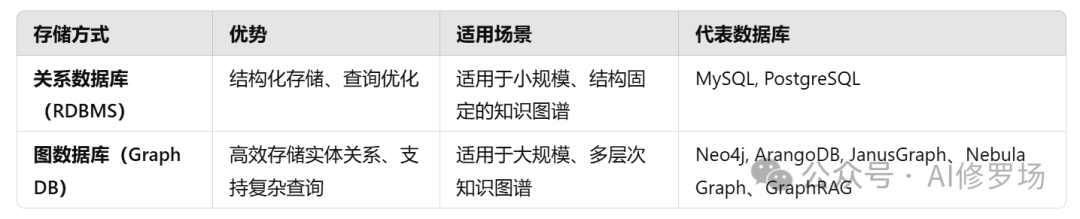

五、知识图谱如何存储?

知识图谱的存储方式主要有两种:关系数据库(RDBMS)和图数据库(Graph Database)。

在 RAG 系统中,通常采用 混合存储:

-

结构化数据存储在 关系数据库(如 MySQL);

-

复杂关系数据存储在 图数据库(如 Neo4j,Nebual Graph);

-

文本向量存储在 向量数据库(如 FAISS、Weaviate)。

目前,国内有些大型公司研发了自己的图数据库,主要满足内部业务,未开源。而开源的图数据库中,百度的 HugeGraph , vesoft 的 NebulaGraph、微软的GraphRAG、Google 的Dgraph、Aura的neo4j 等较为有名。个人推荐使用Nebula Graph。Nebula Graph凭借其开源、分布式架构、本土化支持和强大功能,成为处理大规模图数据的理想选择,尤其适合中国企业和开发者。

六、如何创建知识图谱?

创建知识图谱的流程包括:

- 数据收集:从文本、数据库、API 等来源获取结构化和非结构化数据。

- 实体识别与关系抽取:使用 NLP 技术识别实体,并构建实体之间的关系。

- 知识融合:整合多个来源的数据,去重并规范化实体名称。

- 存储与查询:将知识存入图数据库或关系数据库,并提供查询接口。

七、 查询中如何使用知识图谱数据?

知识图谱数据可以在查询中起到以下作用:

- 语义扩展:当用户输入查询时,系统可以利用知识图谱进行 同义词扩展、上下位概念匹配,提升检索的召回率。例如,查询“诺兰的电影”时,知识图谱可识别“诺兰”对应的全名“克里斯托弗·诺兰”并扩展其执导的所有电影。

- 关系推理:知识图谱能够基于实体间的关系推导新信息。例如,查询“奥斯卡最佳影片获奖导演有哪些?”时,系统可以在知识图谱中查找“奥斯卡最佳影片”对应的电影,并进一步获取这些电影的导演。

- 精细化排序:在 RAG 检索阶段,知识图谱可以 增强重排,通过实体关系、置信度等因素优化查询结果。例如,用户查询“科幻电影推荐”时,可以根据 IMDb 评分、观众评价等属性排序返回的电影。

- 增强 LLM 生成能力:知识图谱提供的结构化数据可作为 LLM 生成时的背景信息,减少幻觉问题,提高答案的准确性。

那么,如何系统的去学习大模型LLM?

作为一名从业五年的资深大模型算法工程师,我经常会收到一些评论和私信,我是小白,学习大模型该从哪里入手呢?我自学没有方向怎么办?这个地方我不会啊。如果你也有类似的经历,一定要继续看下去!这些问题啊,也不是三言两语啊就能讲明白的。

所以我综合了大模型的所有知识点,给大家带来一套全网最全最细的大模型零基础教程。在做这套教程之前呢,我就曾放空大脑,以一个大模型小白的角度去重新解析它,采用基础知识和实战项目相结合的教学方式,历时3个月,终于完成了这样的课程,让你真正体会到什么是每一秒都在疯狂输出知识点。

由于篇幅有限,⚡️ 朋友们如果有需要全套 《2025全新制作的大模型全套资料》,扫码获取~

👉大模型学习指南+路线汇总👈

我们这套大模型资料呢,会从基础篇、进阶篇和项目实战篇等三大方面来讲解。

👉①.基础篇👈

基础篇里面包括了Python快速入门、AI开发环境搭建及提示词工程,带你学习大模型核心原理、prompt使用技巧、Transformer架构和预训练、SFT、RLHF等一些基础概念,用最易懂的方式带你入门大模型。

👉②.进阶篇👈

接下来是进阶篇,你将掌握RAG、Agent、Langchain、大模型微调和私有化部署,学习如何构建外挂知识库并和自己的企业相结合,学习如何使用langchain框架提高开发效率和代码质量、学习如何选择合适的基座模型并进行数据集的收集预处理以及具体的模型微调等等。

👉③.实战篇👈

实战篇会手把手带着大家练习企业级的落地项目(已脱敏),比如RAG医疗问答系统、Agent智能电商客服系统、数字人项目实战、教育行业智能助教等等,从而帮助大家更好的应对大模型时代的挑战。

👉④.福利篇👈

最后呢,会给大家一个小福利,课程视频中的所有素材,有搭建AI开发环境资料包,还有学习计划表,几十上百G素材、电子书和课件等等,只要你能想到的素材,我这里几乎都有。我已经全部上传到优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

相信我,这套大模型系统教程将会是全网最齐全 最易懂的小白专用课!!

131

131

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?