pytorch版

数据操作

在PyTorch中,torch.Tensor是存储和变换数据的主要工具。如果你之前用过NumPy,你会发现Tensor和NumPy的多维数组非常类似。然而,Tensor提供GPU计算和自动求梯度等更多功能,这些使Tensor更加适合深度学习。

"tensor"这个单词一般可译作“张量”,张量可以看作是一个多维数组。标量可以看作是0维张量,向量可以看作1维张量,矩阵可以看作是二维张量。

1.1 创建Tensor

首先介绍Tensor最基本的操作,即Tensor的创建。

# 导入pytorch

import pytorch

# 创建一个5*3的未初始化的Tensor

x = torch.empty(5,3)

print(x)

# 创建一个5*3的随机初始化Tensor

x = torch.rand(5,3)

print(x)

# 创建一个5*3的long型全0的Tensor

x = torch.zeors(5,3,dtype = torch.long)

print(x)

# 我们可以通过shape或者size()来获取Tensor的形状

print(x.size())

print(x.shape)

# 输出结果为:torch.Size([5,3])

# 注意:返回的torch.Size其实就是一个tuple,支持所有tuple的操作

1.2 操作

算术操作

在pytorch中,同一种操作可能有很多种形式,下面以加法为例。

y = torch.rand(5,3)

print(x+y)

# 方法二

print(torch.add(x,y))

# 方法三

y.add_(x)

print(y)

索引

我们还可以使用类似Numpy的索引操作来访问Tensor的一部分,需要注意的是:

索引出来的结果与原数据共享内存,也即修改一个,另一个会跟着修改。

y = x[0,:]

y += 1

print(y)

print(x[0,:]) # 源tensor也被改了

改变形状

用 view() 来改变 Tensor 的形状

y = x.view(15)

z = x.view(-1,5)

print(x.size(),y.size(),z.size())

注意view()返回的新Tensor与源Tensor虽然可能有不同的size,但是是共享data的,也即更改其中的一个,另外一个也会跟着改变。(顾名思义,view仅仅是改变了对这个张量的观察角度,内部数据并未改变)

所以如果我们想返回一个真正新的副本(即不共享data内存)该怎么办呢?Pytorch还提供了一个reshape()可以改变形状,但是此函数并不能保证返回的是其拷贝,所以不推荐使用。推荐先用clone创造一个副本然后再使用view。

x_cp = x.clone().view(15)

x -= 1

print(x)

print(x_cp)

使用clone还有一个好处是会被记录在计算图中,即梯度回传到副本时也会传到源Tensor。

另外一个常用的函数就是 item(),它可以将一个标量Tensor转换成一个Python number:

x = torch.randn(1)

print(x)

print(x.item())

# 输出结果为:tensor([2.3466]),2.3466382026672363

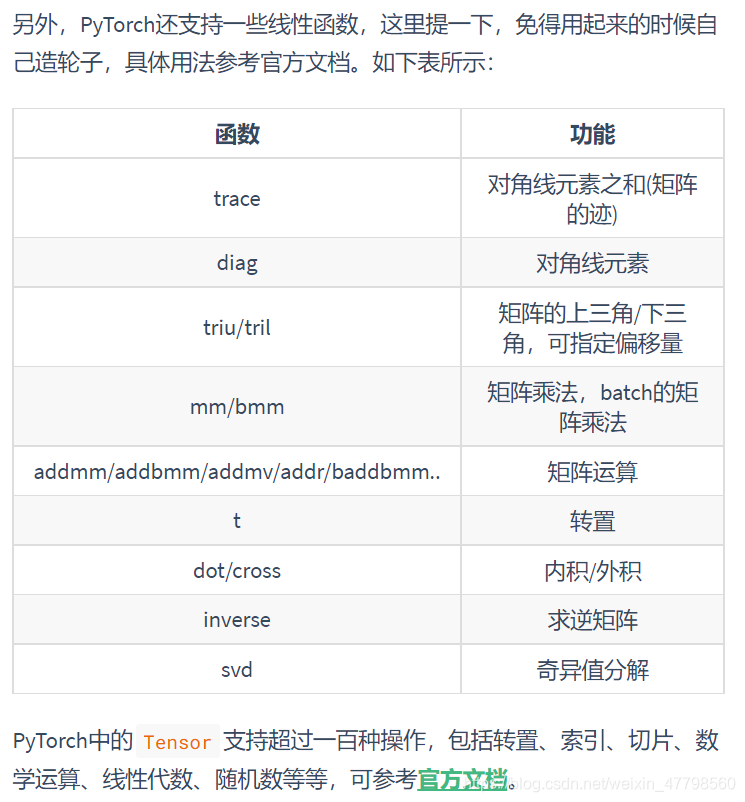

线性代数

1.3 广播机制

前面我们看到如何对两个形状相同的Tensor做按元素运算。当对两个形状不同的Tensor按元素运算时,可能会触发广播(broadcasting)机制:先适当复制元素使这两个Tensor形状相同后再按元素运算。

1.4 运算的内存开销

前面说了,索引操作是不会开辟新内存的,而像y = x + y这样的运算是会新开内存的,然后将y指向新内存。为了演示这一点,我们可以使用Python自带的id函数:如果两个实例的ID一致,那么它们所对应的内存地址相同;反之则不同。

x = torch.tensor([1,2])

y = torch.tensor([3,4])

id_before = id(y)

y = y + x

print(id(y) == id_before) # False

如果想指定结果到原来的y的内存,我们可以使用前面介绍的索引来进行替换操作。在下面的例子中,我们把x + y的结果通过[:]写进y对应的内存中。

x = torch.tensor([1,2])

y = torch.tensor([3,4])

id_before = id(y)

y[:] = y + x

print(id(y) == id_before) # True

我们还可以使用运算符全名函数中的out参数或者自加运算符+=(也即add_())达到上述效果,例如torch.add(x, y, out=y)和y += x(y.add_(x))。

x = torch.tensor([1, 2])

y = torch.tensor([3, 4])

id_before = id(y)

torch.add(x, y, out=y) # y += x, y.add_(x)

print(id(y) == id_before) # True

注:虽然view返回的Tensor与源Tensor是共享data的,但是依然是一个新的Tensor(因为Tensor除了包含data外还有一些其他属性),二者id(内存地址)并不一致。

1.5 Tensor和NumPy相互转换

我们很容易用numpy()和from_numpy()将Tensor和NumPy中的数组相互转换。但是需要注意的一点是: 这两个函数所产生的的Tensor和NumPy中的数组共享相同的内存(所以他们之间的转换很快),改变其中一个时另一个也会改变!!!

还有一个常用的将NumPy中的array转换成Tensor的方法就是torch.tensor(), 需要注意的是,此方法总是会进行数据拷贝(就会消耗更多的时间和空间),所以返回的Tensor和原来的数据不再共享内存。

使用numpy()将Tensor转为Numpy数组

a = torch.ones(5)

b = a.numpy()

print(a,b)

a += 1

print(a,b)

b += 1

print(a,b)

输出结果:

tensor([1., 1., 1., 1., 1.]) [1. 1. 1. 1. 1.]

tensor([2., 2., 2., 2., 2.]) [2. 2. 2. 2. 2.]

tensor([3., 3., 3., 3., 3.]) [3. 3. 3. 3. 3.]

使用from_numpy()将NumPy数组转换成Tensor

import numpy as np

a = np.ones(5)

b = torch.from_numpy(a)

print(a,b)

a += 1

print(a,b)

b += 1

print(a,b)

输出结果:

[1. 1. 1. 1. 1.] tensor([1., 1., 1., 1., 1.], dtype=torch.float64)

[2. 2. 2. 2. 2.] tensor([2., 2., 2., 2., 2.], dtype=torch.float64)

[3. 3. 3. 3. 3.] tensor([3., 3., 3., 3., 3.], dtype=torch.float64)

所有在CPU上的Tensor(除了CharTensor)都支持与NumPy数组相互转换。

此外上面提到还有一个常用的方法就是直接用torch.tensor()将NumPy数组转换成Tensor,需要注意的是该方法总是会进行数据拷贝,返回的Tensor和原来的数据不再共享内存。

c = torch.tensor(a)

a += 1

print(a,c)

输出结果:

[4. 4. 4. 4. 4.] tensor([3., 3., 3., 3., 3.], dtype=torch.float64)

1.6 Tensor on GPU

用方法 to() 可以将Tensor在CPU和GPU(需要硬件支持)之间相互移动。

# 以下代码只有在PyTorch GPU版本上才会执行

if torch.cuda.is_available():

device = torch.device("cuda") # GPU

y = torch.ones_like(x, device=device) # 直接创建一个在GPU上的Tensor

x = x.to(device) # 等价于 .to("cuda")

z = x + y

print(z)

print(z.to("cpu", torch.double)) # to()还可以同时更改数据类型

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?