概要

是不是很多亲骨和我一样想将本地化的deepseek与Pycharm软件连接起来,然后为所欲为呢?

整体架构流程

step1: deepseek本地化部署

step2: pycharm import安装相应的库并import

技术名词解释

- deepseek: deep fortune seeker

技术细节

step1:deepseek 本地化部署

利用发表文章时的技巧,能自引则拼命自引,请参考我这篇热点文章

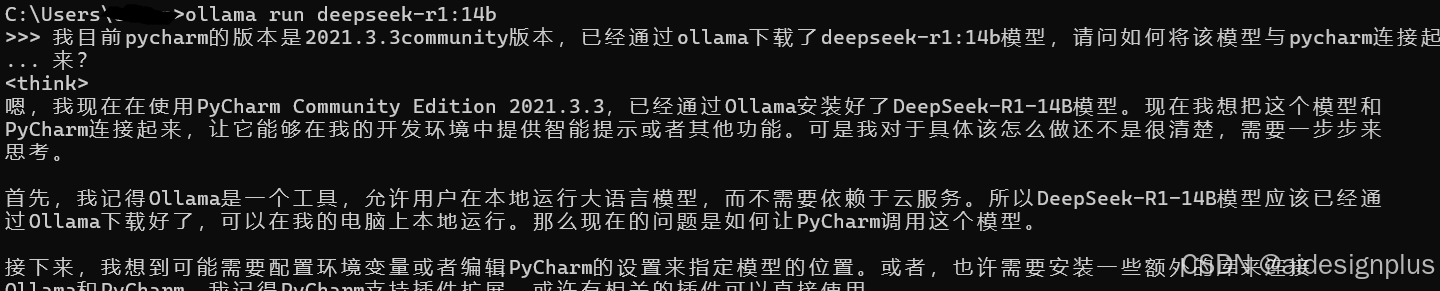

作为理科男这里给一个测试,第一步闭环:

step2:pycharm 与本地化deepseek 连接

记得我们的口号是用魔法打败魔法:

我将官方给出的解决方案放在这里,省略其思考过程:

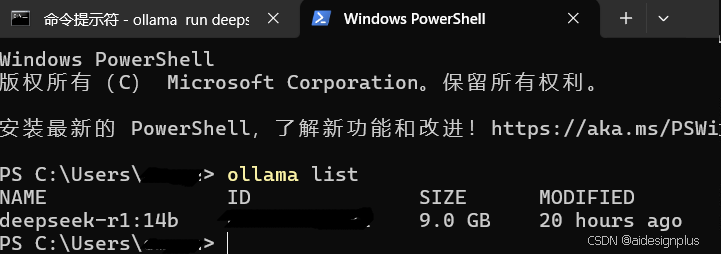

步骤 1: 确保Ollama和模型正常运行

- 启动Ollama服务器:确保您已经启动了Ollama服务,并且模型已加载。默认情况下,Ollama运行在

localhost:11434。 - 检查模型状态:可以通过命令

ollama list查看可用的模型,并确认DeepSeek-R1-14B是否正确加载。

步骤 2: 在PyCharm中安装必要的库

- 打开设置:

- 进入PyCharm,点击顶部菜单栏的 File -> Settings(或者 PyCharm -> Preferences 在Mac上)。

- 选择Python Interpreter:

- 在左侧找到并点击 Project: <your_project_name>,然后选择 Python Interpreter 标签。

- 安装库:

- 点击“+”按钮添加新的库。搜索并安装以下库:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

675

675

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?