支持向量机

一、优化目标

1.1 支持向量机

支持向量机(Support Vector Machine),简称SVM,在学习复杂的非线性方程时提供了一种更为清晰强大的方式。

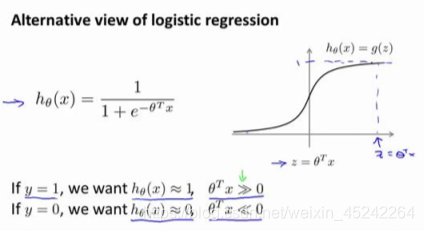

用z表示θTx

如果有一个y=1的样本,则希望h(x)≈ 1,θTx >> 0;

如果有一个y=0的样本,则希望h(x)≈ 0,θTx << 0;

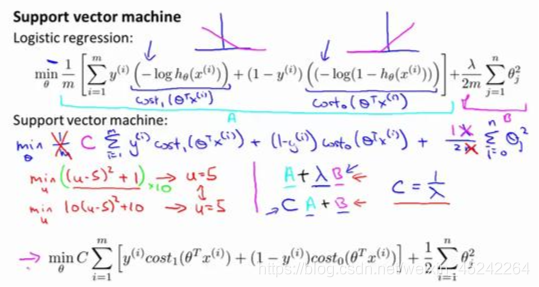

1.2 建立支持向量机

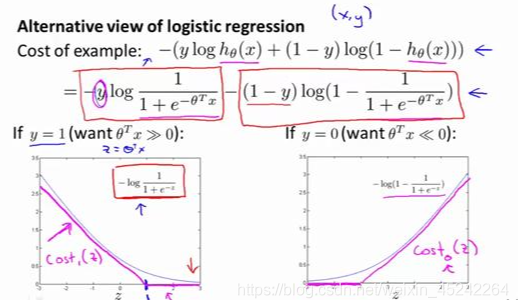

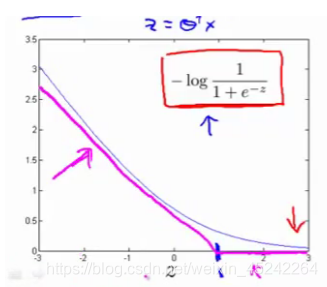

当y=1时,

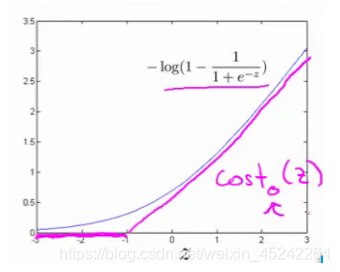

y=0时,

建立支持向量机

①无论是否有1/m这一项,最终得到的最优值θ都是一样的

②对于逻辑回归,在目标函数中,有两项:训练样本的代价和正则化项,需要用这一项来平衡。

A+λ×B,通过设置不同正则参数λ达到优化的目的,权衡对应的项,使得训练样本拟合的更好。如果给定的λ具有很大的值,意味着给予B更大的权重

对于支持向量机,C×A+B,如果C设定为非常小的值,那么会给B比A更大的权重

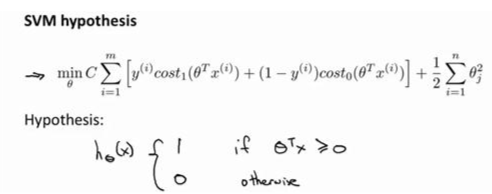

得到在支持向量机中我们的整个优化目标函数,最小化目标函数,得到SVM学习到的参数C

当θTx ≥ 0时,学习参数θ是支持向量机假设函数的形式

二、大边界的直观理解

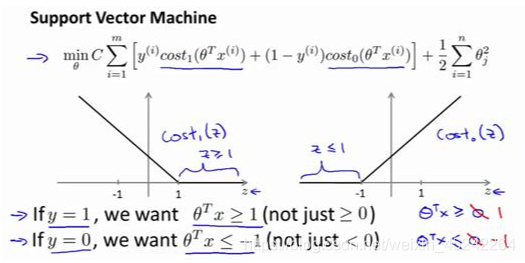

2.1 代价函数

左图表正样本,y = 1,关于z的代价函数cost1(z),当θTx ≥ 1 时,cost1(z) = 0

右图表负样本,y = 0,关于z的代价函数cost0(z),当θ<

本文详细介绍了支持向量机(SVM)的优化目标、大边界的直观理解、大边界分类以及核函数的运用。SVM通过最大化决策边界的间距实现大间距分类,其中参数C和σ对模型的复杂度有很大影响。此外,文章还讨论了如何选择地标、计算新特征以及使用支持向量机的步骤和适用场景。

本文详细介绍了支持向量机(SVM)的优化目标、大边界的直观理解、大边界分类以及核函数的运用。SVM通过最大化决策边界的间距实现大间距分类,其中参数C和σ对模型的复杂度有很大影响。此外,文章还讨论了如何选择地标、计算新特征以及使用支持向量机的步骤和适用场景。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1106

1106

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?