国产大模型迎来"顿悟时刻":DeepSeek-R1满血开源背后的技术突围

一、当6710亿参数遇上中国速度:一场算力的极限挑战

在深圳某科技园区的地下机房,八台A800显卡组成的计算阵列正以每秒数万亿次的速度吞吐数据。这些价值百万的硬件集群上,运行着全球首个完全开源的千亿级大模型——DeepSeek-R1。

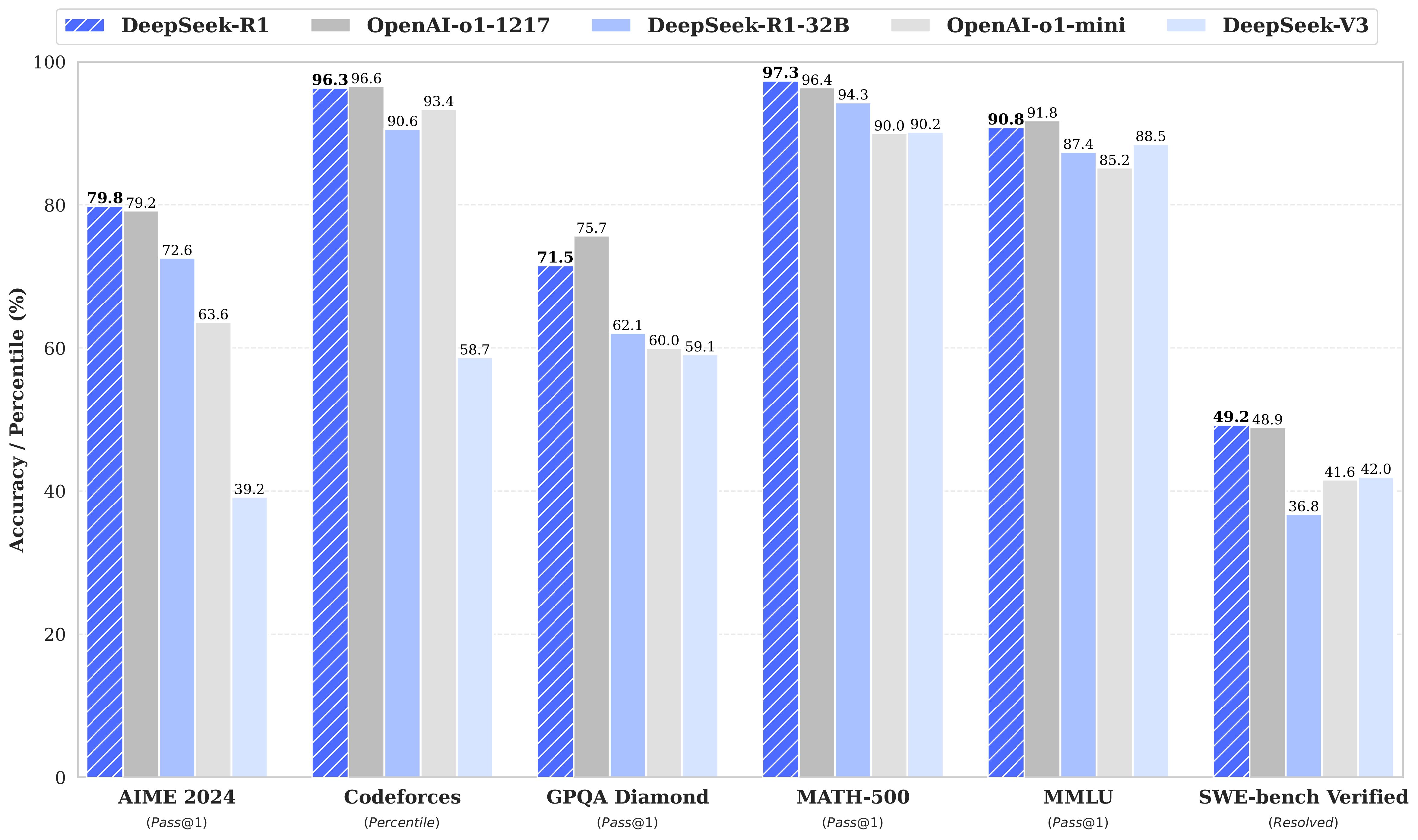

这个拥有6710亿参数的庞然大物,在数学推理、代码生成等领域的表现已超越GPT-4。但更令人震撼的是,清华大学联合趋境科技开源的KTransformers项目,让单张4090显卡就能运行这个"巨无霸"。这种技术突破背后,是中国科研团队对模型架构的极致优化:通过混合精度计算和动态调度算法,实现了比传统方案快28倍的推理速度。

二、从实验室到你的桌面:开源生态重构AI格局

过去要运行这样的千亿模型,需要企业投入千万级硬件成本。而如今借助ollama框架,开发者只需在终端输入三行命令:

curl -fsSL https://ollama.com/install.sh | sh

ollama

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?