摘要

本文提出的RU-Net和R2UNet考虑将UNet,残差网络和RCNN的优势结合在一起。

首先,使用残差模块来进行深层网络的训练。其次,循环残差层将特征相加有助于分割特征的提取。第三,通过改进UNet的结构使得不增加参数的情况下提升了网络分割的性能。

方法

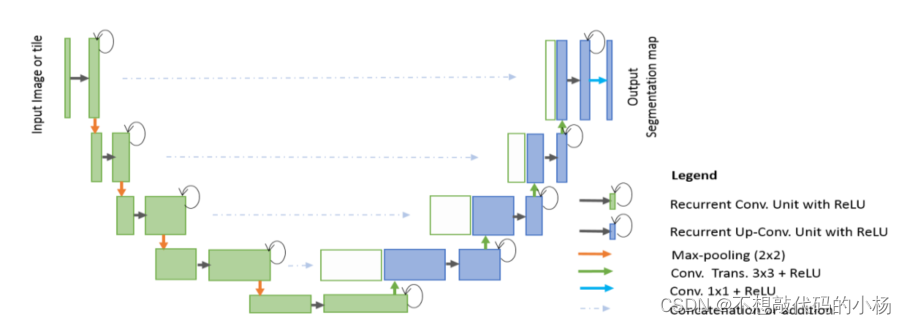

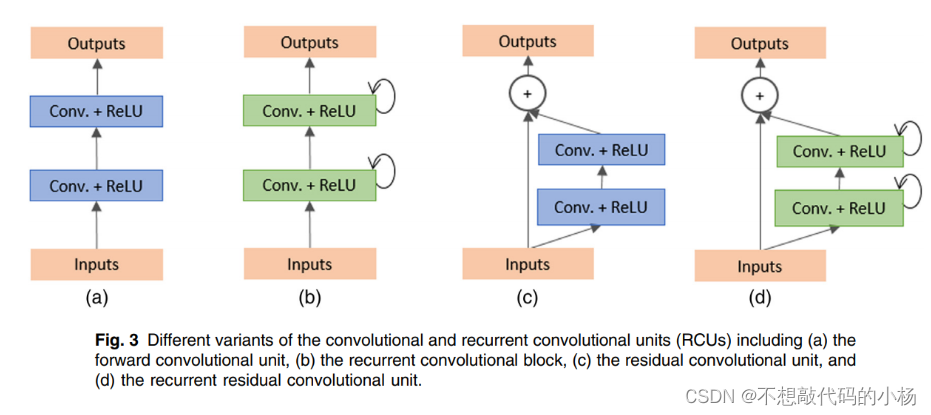

RU-Net&和R2UNet将上面提到的三种模型的优势结合在了一起,图三显示了RUNet的结构,其中循环卷积层通常对应于不同时间步的输出,而图4则显示了进一步加入了残差的结构。

上图第一眼似乎与UNet并没有太多区别,实际上是把某些模块替换成了循环卷积网络层,这种模块的输出可以表示为

所谓的残差就是将卷积输出和原图合并,而Recurrent即不单要接受Xt和Xt-1的合并输出。提出的RUNet和R2UNet是堆叠卷积单元的构建块,如上图中的(b)和(d)堆叠而成。

提出的模型与UNet的模型差异在三方面体现,

该体系结构由与U-Net相同的卷积编码和译码单元组成。然而,在编码和解码单元中,RCLs和带有剩余单元的RCLs代替了常规的前向卷积层。带有RCLs的剩余单元有助于开发更有效的更深入的模型。其次,两种模型的RCL单元都包含了有效的特征累积方法。基于cnn的医学图像分割方法显示了特征从网络的一个部分到另一个部分积累的有效性。

总结:可以考虑在UNet中加入循环神经网络更有助于分割提取特征

本文提出RU-Net和R2UNet,将UNet、残差网络和RCNN优势结合。通过使用残差模块训练深层网络、循环残差层提取分割特征、改进UNet结构提升性能。模型把部分模块替换为循环卷积网络层,与UNet有三方面差异,加入循环神经网络更利于分割特征提取。

本文提出RU-Net和R2UNet,将UNet、残差网络和RCNN优势结合。通过使用残差模块训练深层网络、循环残差层提取分割特征、改进UNet结构提升性能。模型把部分模块替换为循环卷积网络层,与UNet有三方面差异,加入循环神经网络更利于分割特征提取。

3440

3440

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?