话不多说,直接开整

本地安装deepseek

Ollama 是一个轻量级AI模型运行框架,支持多个开源模型,我们将用它来运行DeepSeek。

安装Ollama

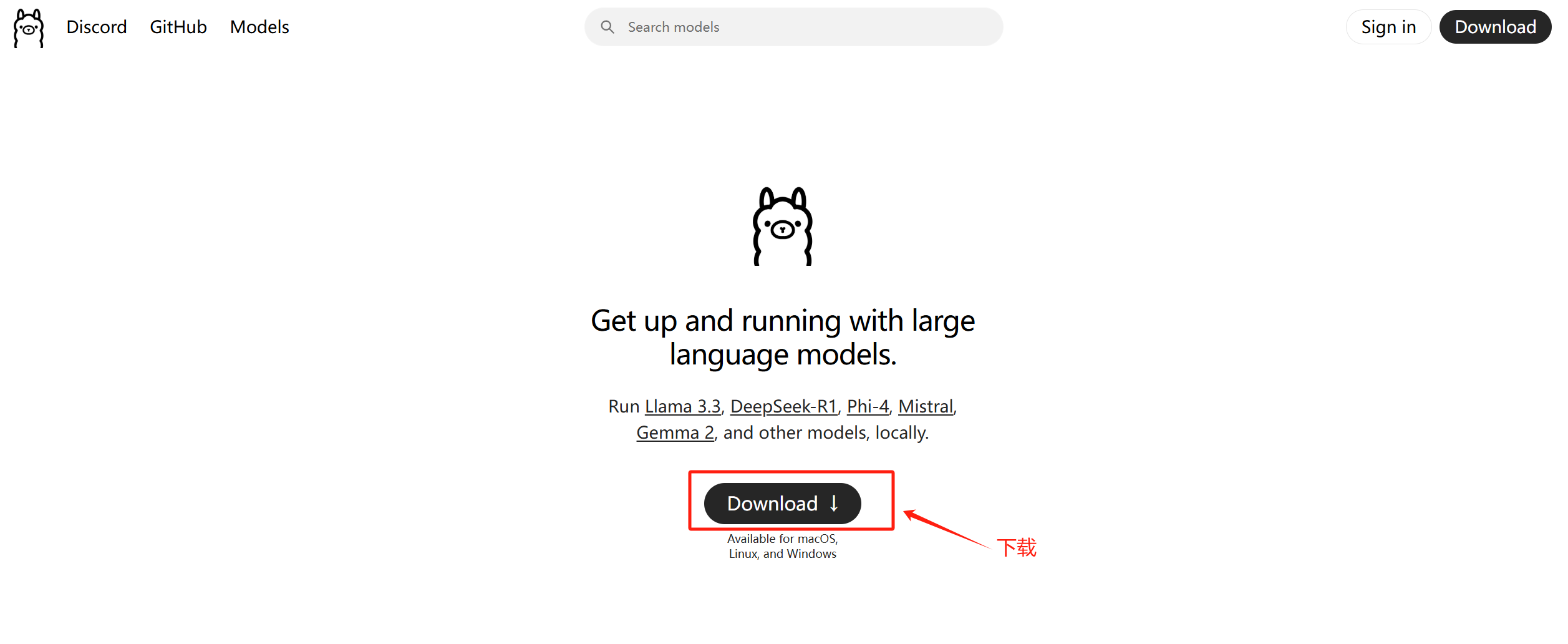

进入官网ollama.com

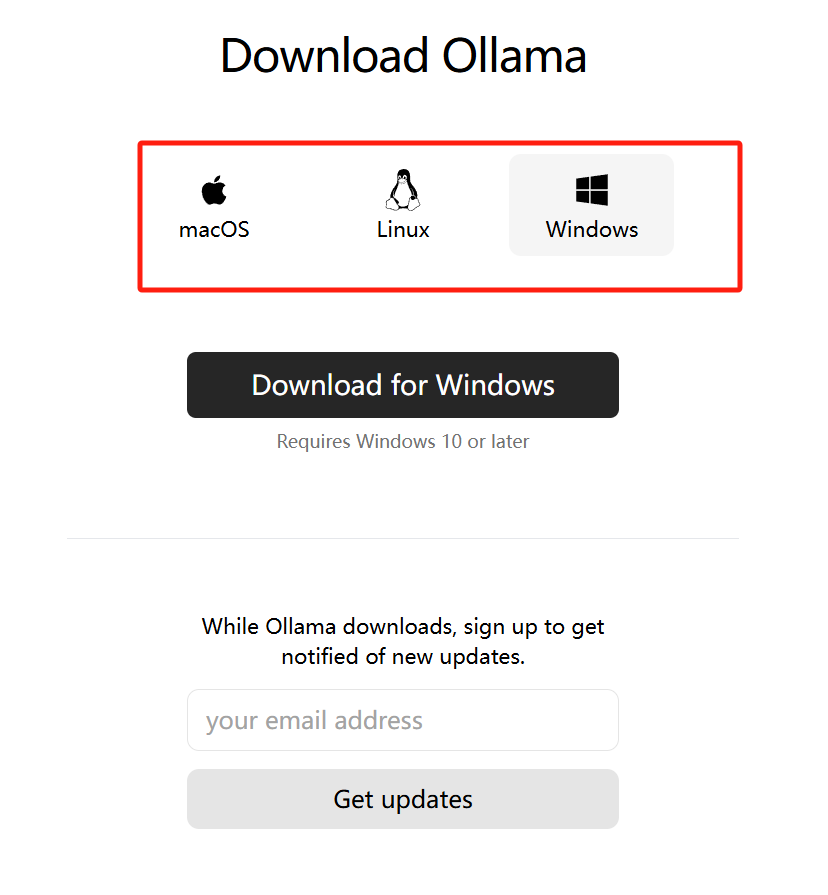

选择自己相应的系统

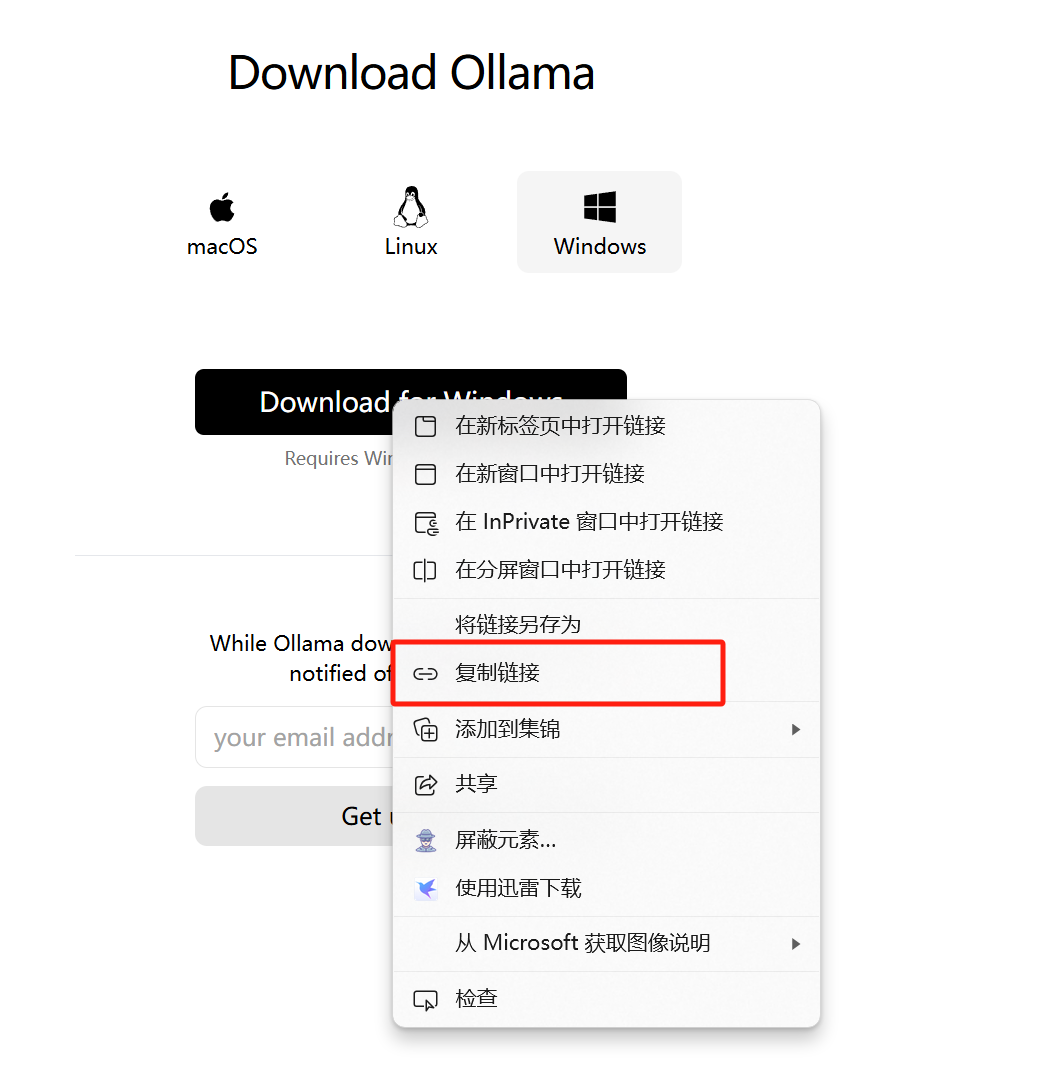

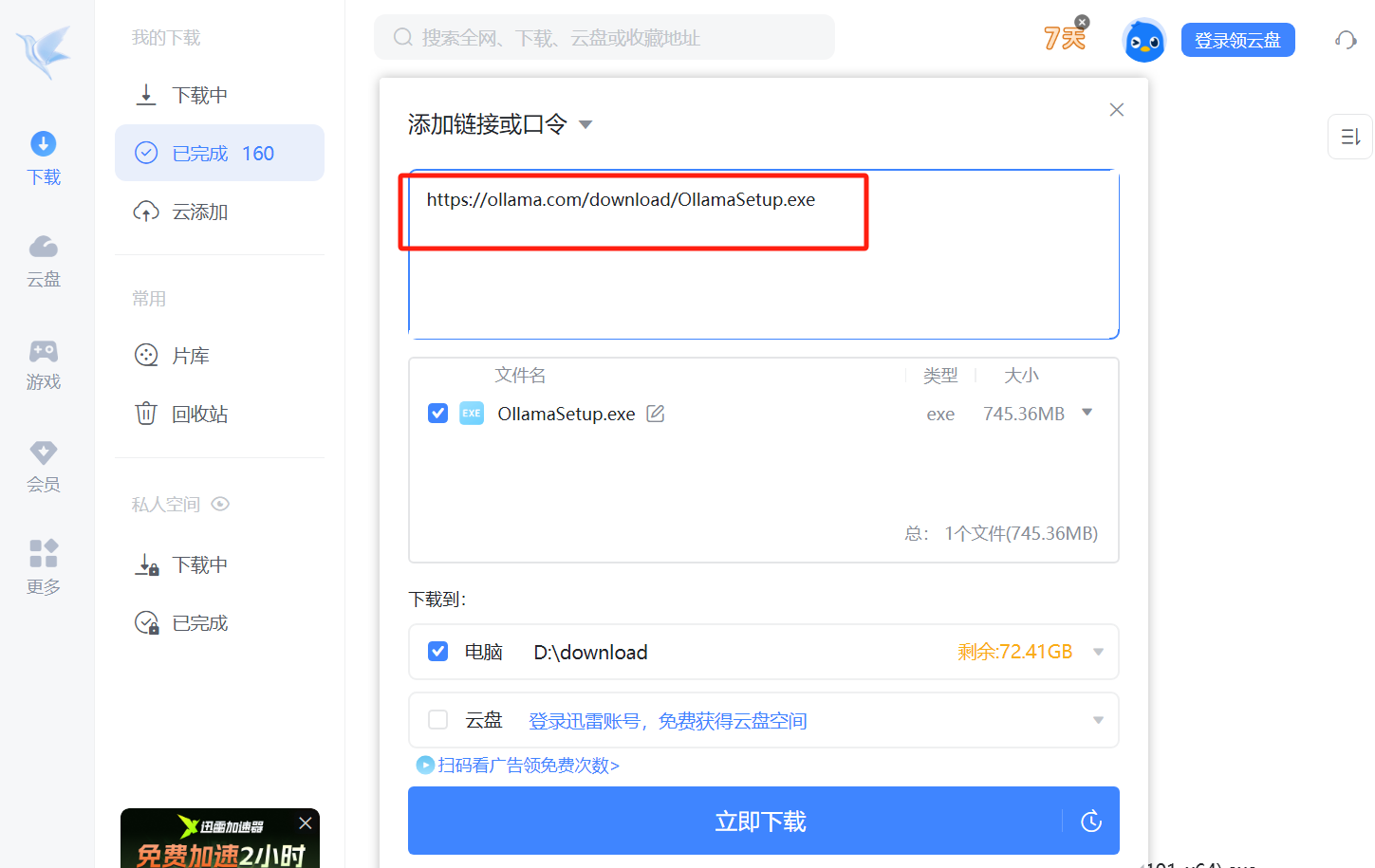

这里建议右键,复制链接使用迅雷或者其他下载器下载

下载完成后,安装,默认安装在c盘,会自动配置环境变量

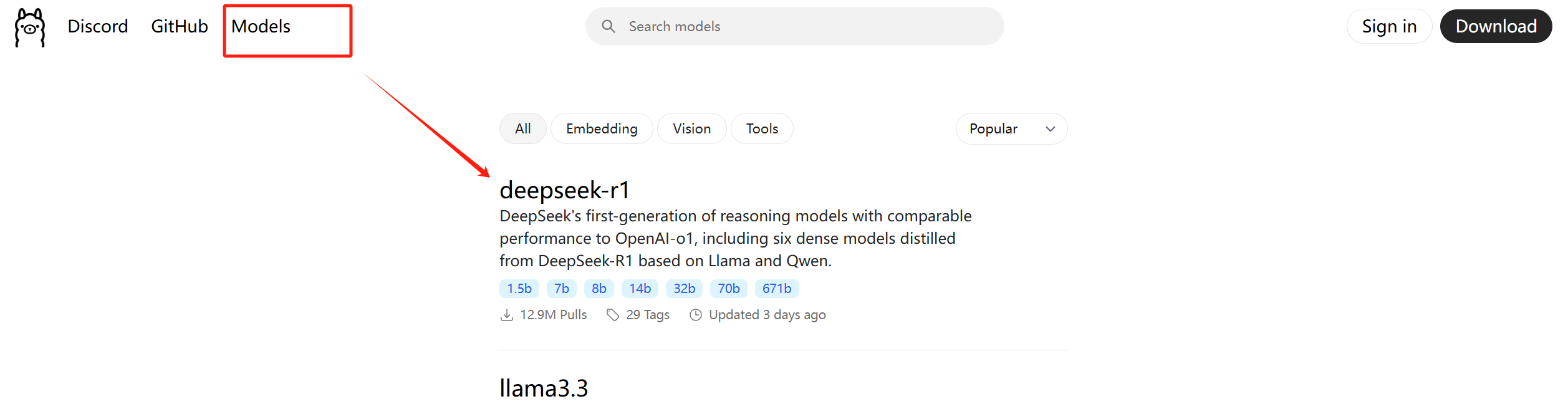

选择model,deepseek-r1

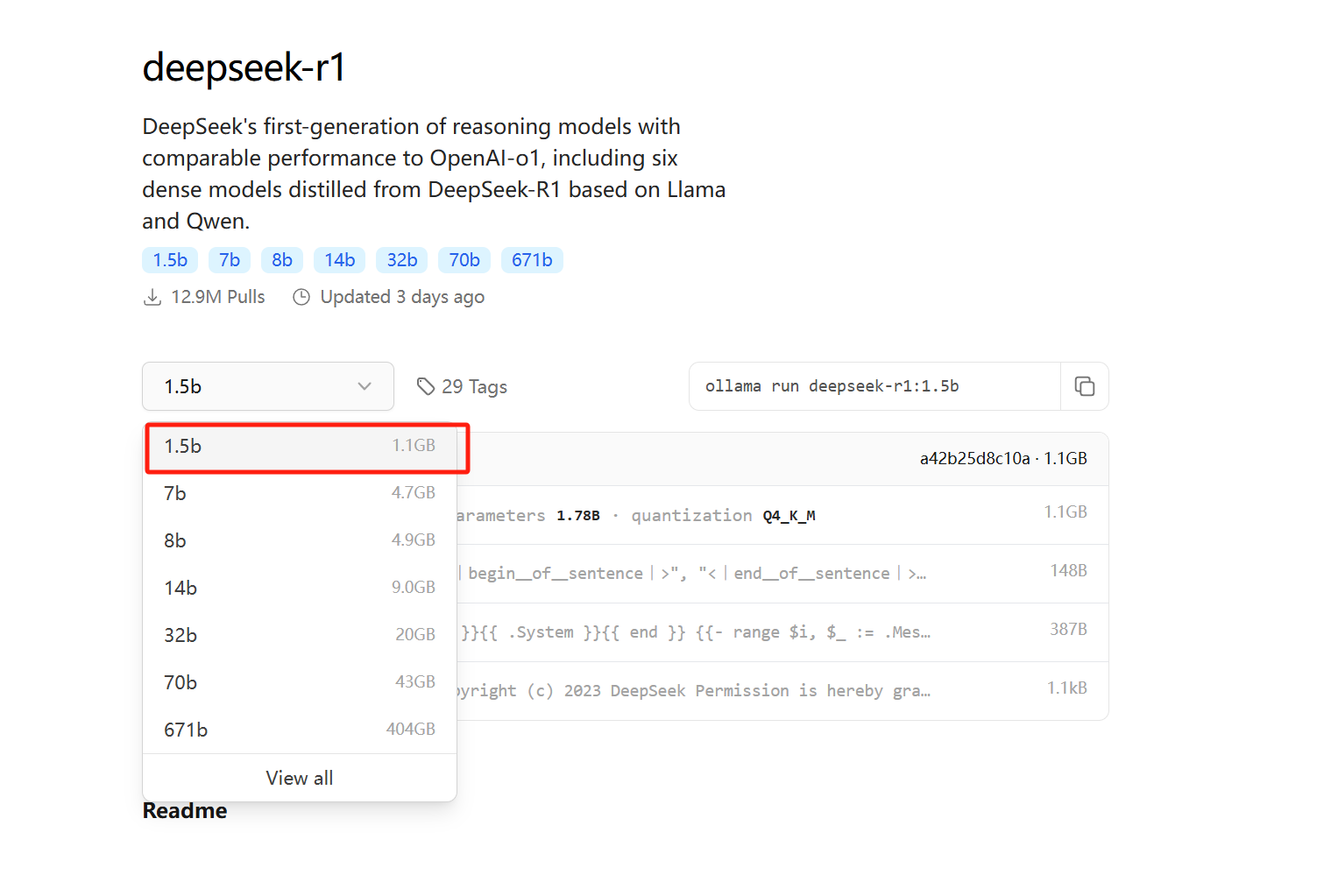

因为是本地部署,我选择配置要求相对低1.5b版本,参数越高,要求GPU要求更高

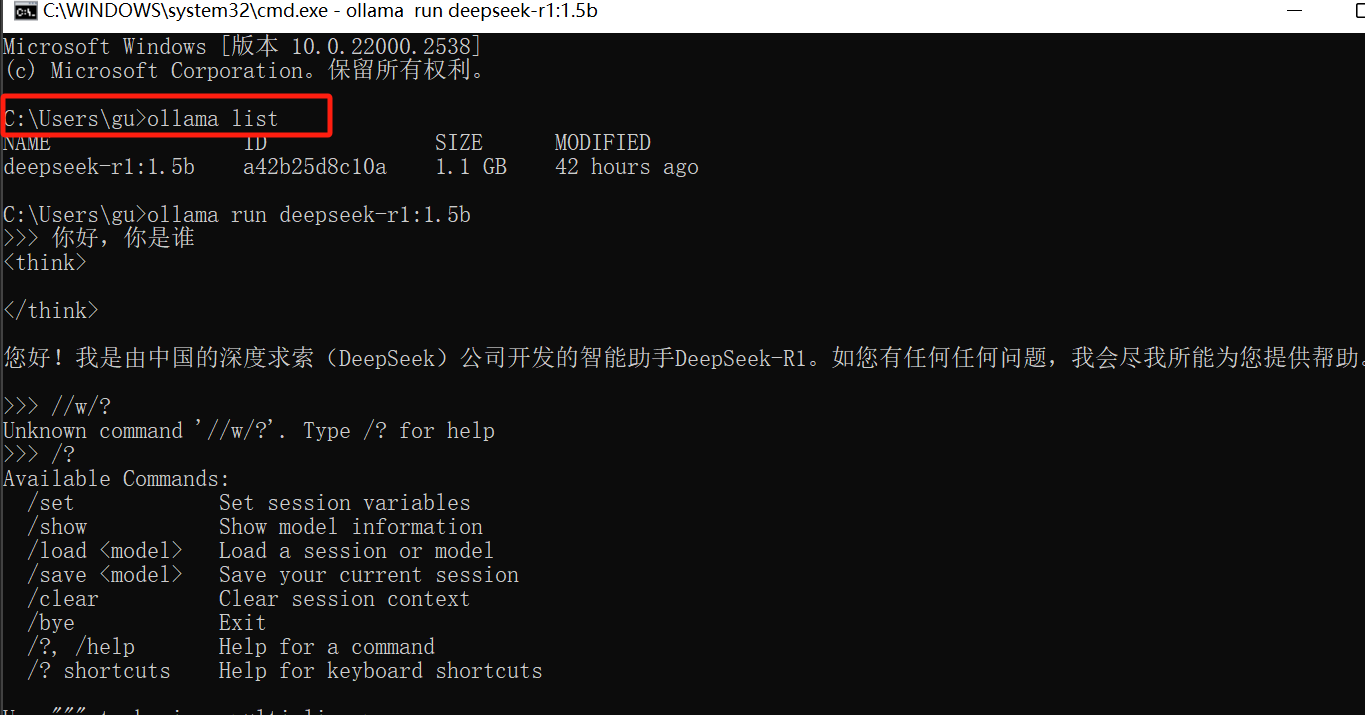

打开cmd,运行命令ollama run deepseek-r1:1.5b,等待安装完成,我这里已经安装过了,所以直接进入的对话

安装完成后也可以通过ollama run deepseek-r1:1.5b进入对话

使用命令ollama list查看本地已经安装了哪些模型

这样,就完成了本地部署deepseek

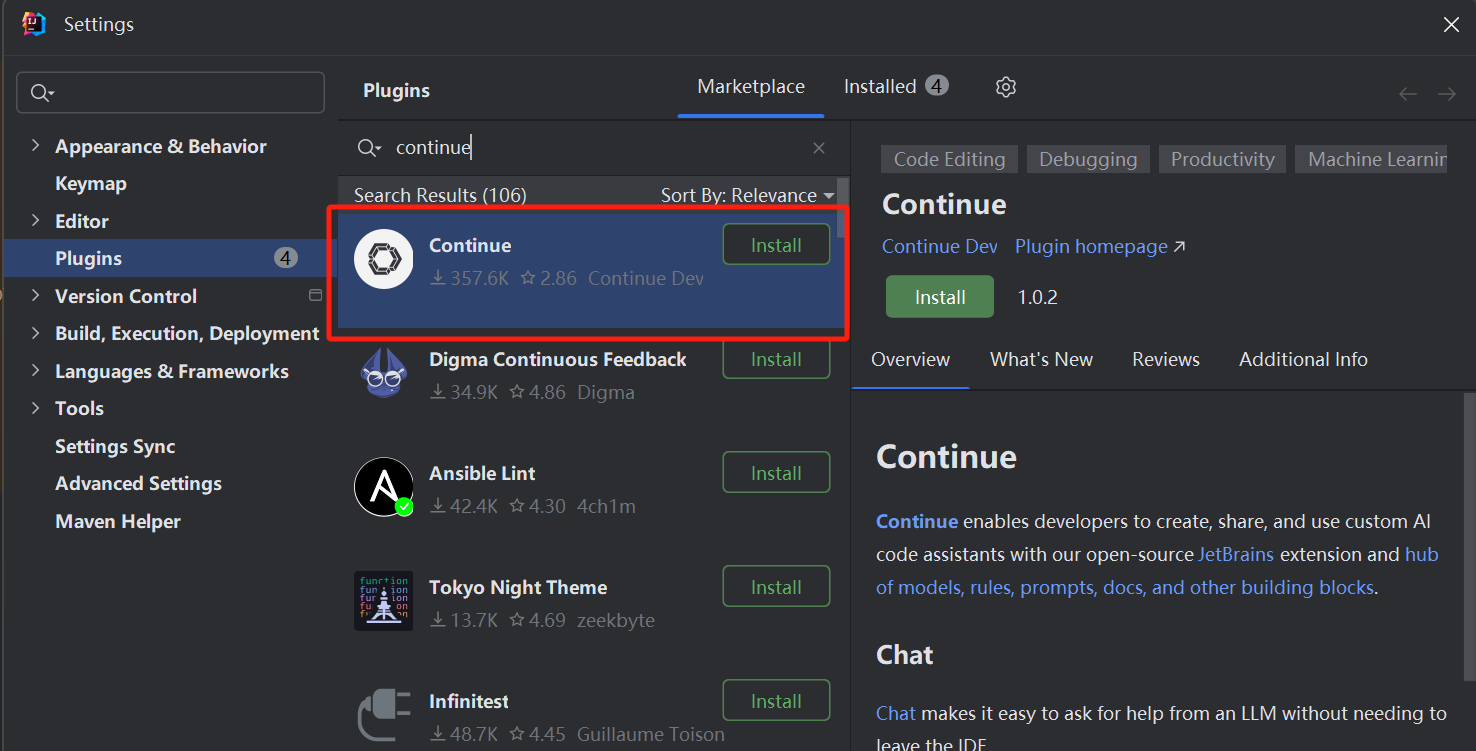

接入idea

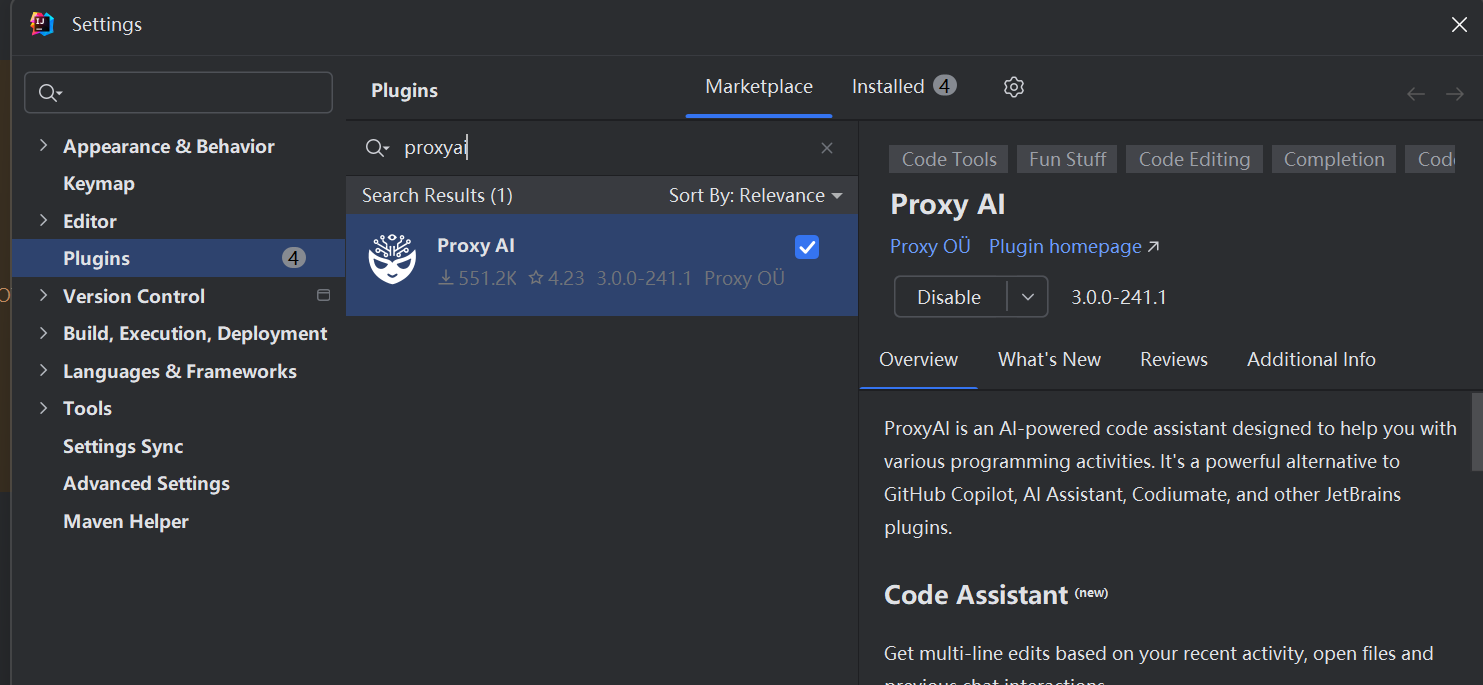

目前idea已经有插件

或是

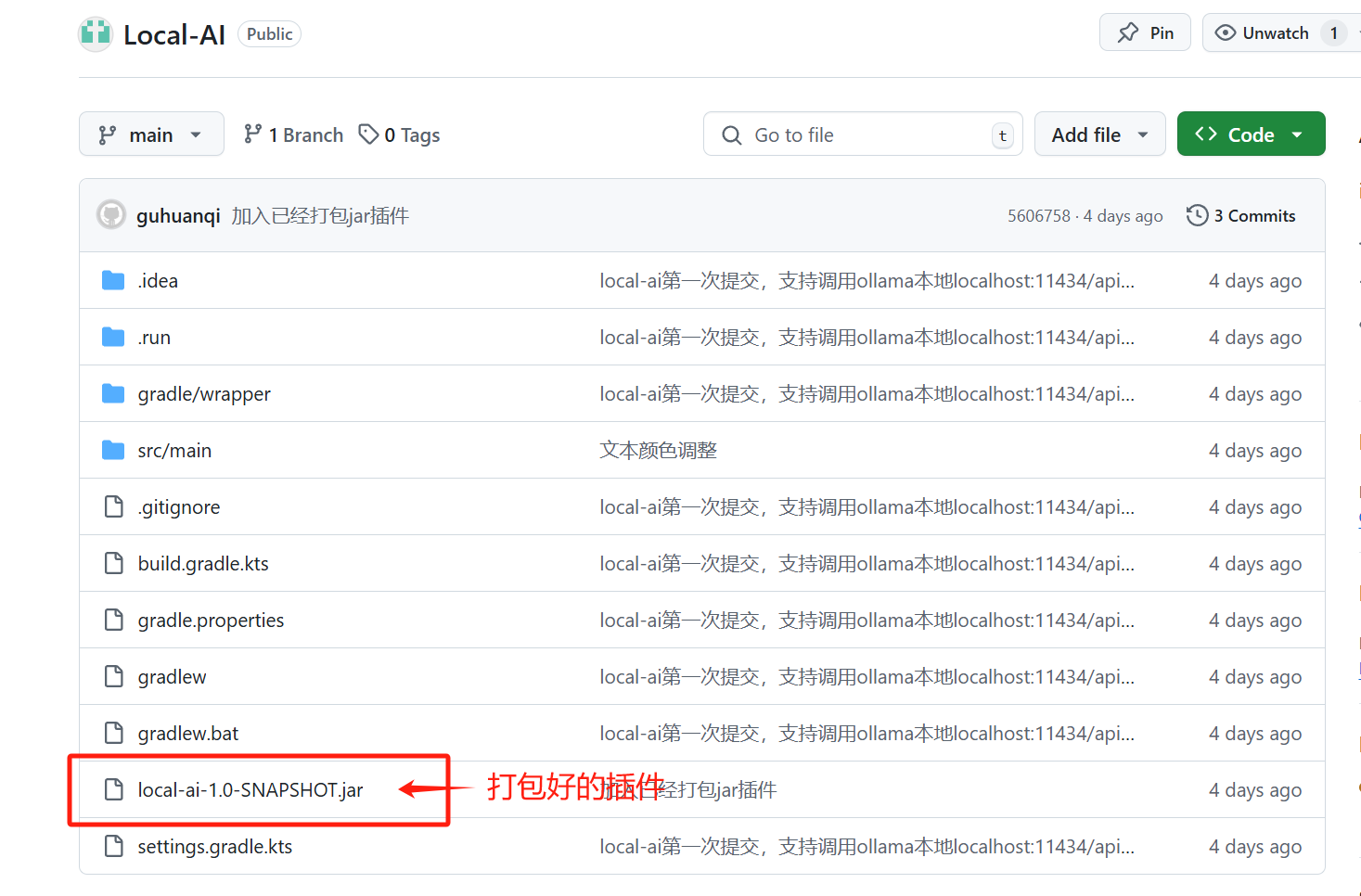

使用方法可以自行查询,当时不知道有现有工具,结果自己写了个插件,相对比较简易,暂时不支持修改配置,默认使用deepseek-r1:1.5b

已上传github

1307

1307

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?