上一次讲到VC bound适合各种err。以及有noise的情况下,VC Bound理论仍然是成立的。本节课介绍机器学习最常见的一种算法:Linear Regression.

一、回归问题

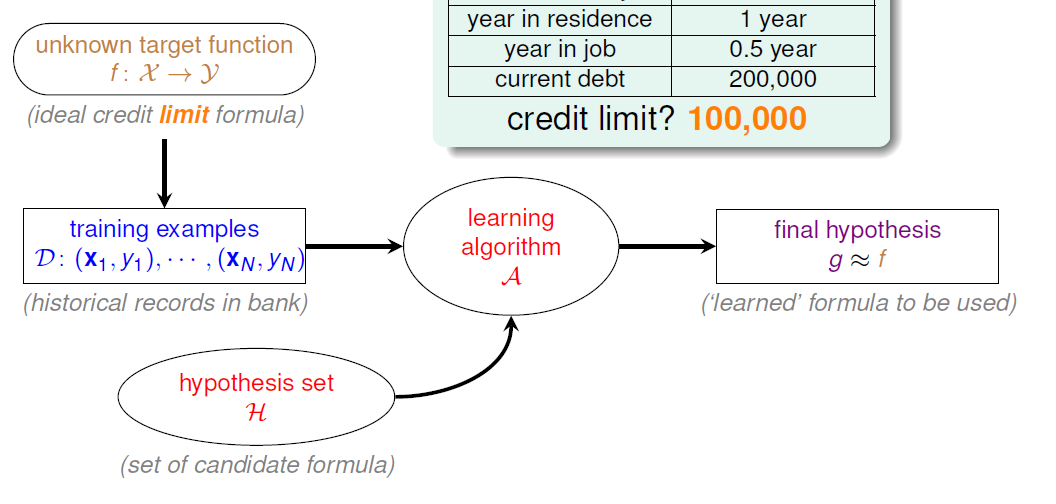

我们依旧从信用卡的问题来讲,现在的信用卡问题不再是给某人信用卡,而是该给这个多少额度。

学习流程图如下所示:

此刻的学习目标变为了输出实数的函数,即,上面的问题是线性回归(Linear Regression)问题。

我们利用资料来算一个加权的分数,决定给这个人多少额度:

顾客特征:

加权后的分数:

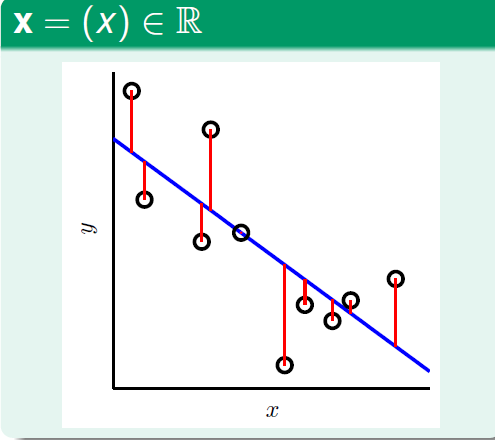

可视化来讲,在二维平面中,我们希望找到的这条蓝色直线,和资料‘o’越接近越好(红色竖线越短,直线与资料越接近)。

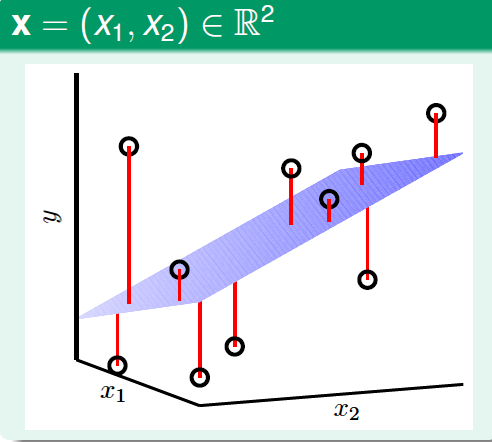

三维空间同理。回归分析要做的事情就是找到最好的直线/超平面来描述资料。红色竖线被叫做残差residuals。

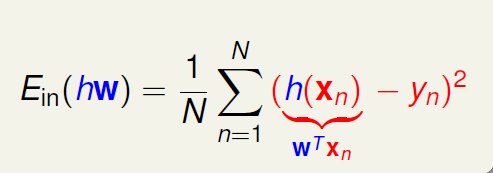

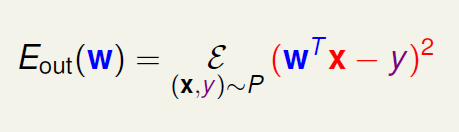

如何衡量这些残差呢,我们使用平方误差来衡量。

![]()

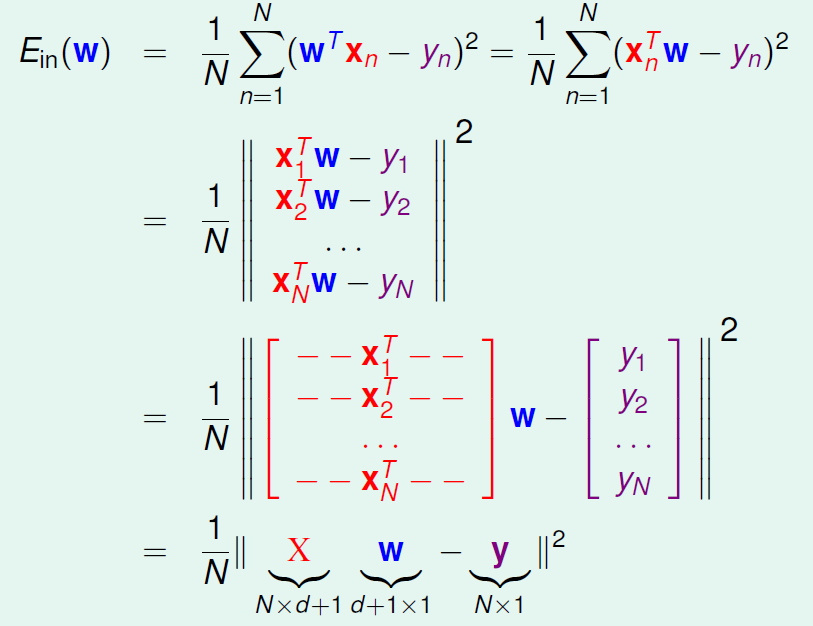

在已知样本上:

在未知样本上:

之前我们知道err不影响VCbound,所以现在主要考虑如何让极小化。

二、线性回归算法

我们把写成矩阵的形式。

然后我们作出

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

397

397

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?