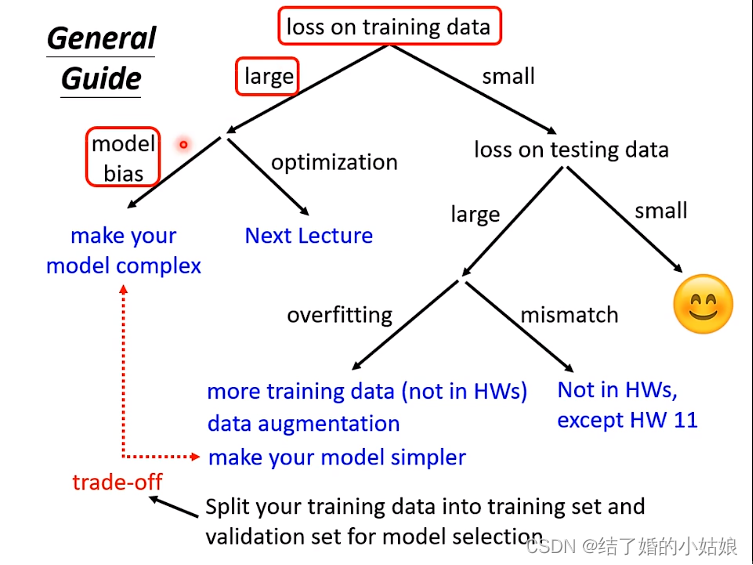

如果training data的loss大:

1.model bias大,模型中的function set太简单,model的弹性不好,需要重新设计model。

解决:增加更加的feature

DNN全连接层增加深度。

2.optimization不好

卡在local minima,gradient descent不能下降到更低的local minima

先train简单的model比如linear或者svm,或者浅的model,可以得到的loss,如果深的model比浅的model表现不好,则说明optimization不好

如果training的loss小,testing的loss大:

则有可能over fitting

全连接层比cnn(更关注局部)更有弹性,也因此cnn可以做图像识别

2052

2052

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?