Camera_Lidar_Fusion综述笔记

1.背景

单目视觉感知系统以其低成本实现了令人满意的性能,但却无法提供可靠的3D几何信息。双目相机可以提供3D几何信息,但是计算成本高,且无法在高遮挡和无纹理的环境中可靠的工作。此外,基于视觉的感知系统在光照条件复杂的情况下鲁棒性较低,这限制了其全天候能力。而激光雷达不受光照条件影响,且能提供高精度的3D几何信息。但其分辨率和刷新率低,一般的激光雷达刷新率是10-20Hz,且成本高昂。因此相机-雷达融合感知,就是为了提高性能与可靠性并降低成本。但这并非易事,首先,相机通过将真实世界投影到相机平面来记录信息,而点云则是将几何信息以原始坐标的形式存储。此外,就数据结构和类型而言,点云是不规则,无序和连续的,而图像是规则,有序和离散的。这导致了图像和点云处理算法方面的巨大差异,在下图中比较了点云和图像的特性。

2.趋势,挑战和未来研究方向

无人驾驶汽车中的感知模块负责获取和理解其周围的场景,其输出直接影响下游模块(例如规控制,决策和定位)。因此,感知的性能和可靠性是整个无人驾驶系统的关键。通过摄像头-激光雷达融合感知来加强其性能和可靠性,改善无人驾驶车辆在复杂场景下的感知(例如城市道路,极端天气情况等)。下表将罗列图像和点云融合的趋势:

| 2D到3D | 单任务到多任务 | 信号级别到多级融合 |

|---|---|---|

| 随着3D特征提取方法的发展,3D空间中定位,跟踪和分割对象是研究热点。 | 一些近期的研究结合了多个互补任务,例如对象检测,语义分割和深度完成,以实现更好的整体性能并降低计算成本。 | 早期的研究经常利用信号级融合,将3D几何图形转换到图像平面以利用现成的图像处理模型,而最近的模型则尝试在多级融合图像和点云(例如早期融合,晚期融合)并利用时间上下文。 |

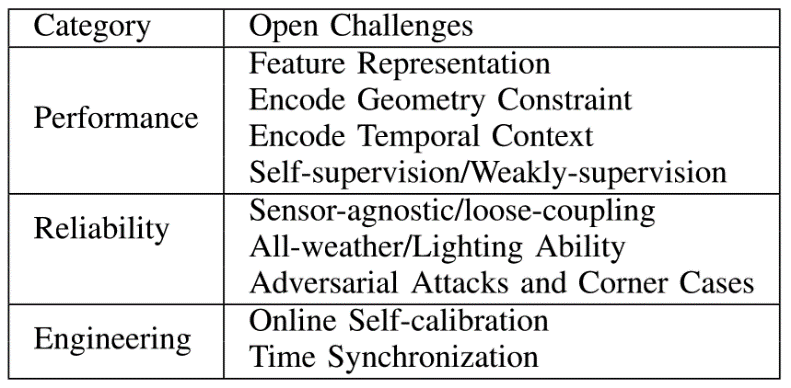

当前的挑战如下图:

A.与性能相关的开放研究问题

1)融合数据的特征表示

a) 在RGB图像上的附加深度信息通道(RGB-D)。此方法由于可以通过现成的图像处理模型进行处理,因此早期的信号级融合常使用这种表达形式。但是,其结果也限制于2D图像平面,这使其不适用于自动驾驶。

b) 在点云上的附加RGB通道。此方法可以通过将点投影到像平面进行像素点关联来实现。但是,高分辨率图像和低分辨率点云之间的分辨率不匹配会影响此方式的效率。

c) 将图像和点云特征/信号均转换为(intermediate data representation)其他的数据表示形式。当前的intermediate data repr

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2943

2943

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?