tensorflow(一)

Python 库中, op 构造器的返回值代表被构造出的 op 的输出, 这些返回值可以传递给其它 op 构造器作为输入.TensorFlow Python 库有一个默认图 (default graph), op 构造器可以为其增加节点. 这个默认图对 许多程序来说已经足够用了

import tensorflow as tf

# 创建一个常量 op, 产生一个 1x2 矩阵. 这个 op 被作为一个节点

# 加到默认图中.

#

# 构造器的返回值代表该常量 op 的返回值.

matrix1 = tf.constant([[3., 3.]])

# 创建另外一个常量 op, 产生一个 2x1 矩阵.

matrix2 = tf.constant([[2.],[2.]])

# 创建一个矩阵乘法 matmul op , 把 'matrix1' 和 'matrix2' 作为输入.

# 返回值 'product' 代表矩阵乘法的结果.

product = tf.matmul(matrix1, matrix2)

构造阶段完成后, 才能启动图. 启动图的第一步是创建一个Session 对象, 如果无任何创建参数, 会话构造器将启动默认图.

with tf.Session() as sess:

result = sess.run(product)

print(result)

交互式使用Session

文档中的 Python 示例使用一个会话Session 来 启动图, 并调用Session.run() 方法执行操作.为了便于使用诸如IPython 之类的 Python 交互环境, 可以使用InteractiveSession 代替Session 类, 使用Tensor.eval() 和Operation.run() 方法代替Session.run() . 这样可以避免使用一个变量来持有会话.

# 进入一个交互式 TensorFlow 会话.

import tensorflow as tf

sess = tf.InteractiveSession()

x = tf.Variable([1.0, 2.0])

a = tf.constant([3.0, 3.0])

# 使用初始化器 initializer op 的 run() 方法初始化 'x'

x.initializer.run()

# 增加一个减法 sub op, 从 'x' 减去 'a'. 运行减法 op, 输出结果

sub = tf.sub(x, a)

print sub.eval()

变量声明

import tensorflow as tf

a = 3

#创建一个变量

w = tf.Variable([[0.5,1.0]])

x = tf.Variable([[2.0],[1.0]])

y = tf.matmul(w,x)

#变量需要初始化在操作前

init_op = tf.global_variables_initializer()

with tf.Session() as sess:

sess.run(init_op)

print(y.eval())

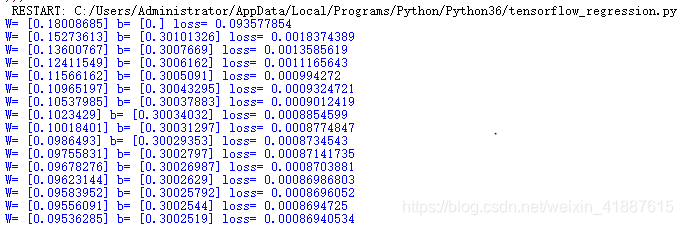

实现一个简单的回归学习

import tensorflow as tf

import numpy as np

import matplotlib.pyplot as plt

sess = tf.Session()

num_points = 1000

vectors_set = []

for i in range(num_points):

x1 = np.random.normal(0.0,0.55)

y1 = x1*0.1+0.3+np.random.normal(0.0,0.03)

vectors_set.append([x1,y1])

x_data = [v[0] for v in vectors_set]

y_data = [v[1] for v in vectors_set]

W = tf.Variable(tf.random_uniform([1],-1.0,1.0),name='W')

b = tf.Variable(tf.zeros([1]),name='b')

y = W*x_data+b

#计算y与y_data之间的均方差

loss = tf.reduce_mean(tf.square(y-y_data),name='loss')

#采用梯度下降法来优化参数

optimizer = tf.train.GradientDescentOptimizer(0.5)

train = optimizer.minimize(loss,name='train')

init = tf.global_variables_initializer()

sess.run(init)

print("W=",sess.run(W),"b=",sess.run(b),"loss=",sess.run(loss))

for step in range(50):

sess.run(train)

print("W=",sess.run(W),"b=",sess.run(b),"loss=",sess.run(loss))

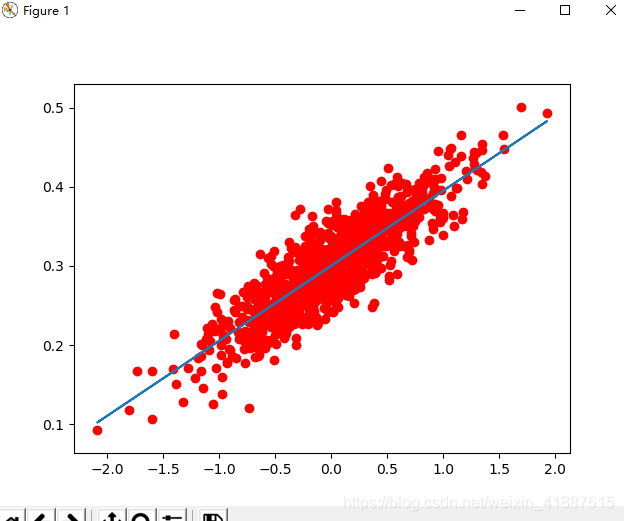

plt.scatter(x_data,y_data,c='r')

plt.plot(x_data,sess.run(W)*x_data+sess.run(b))

plt.show()

结果图:

本文介绍了TensorFlow的基础使用。在Python库中,op构造器可向默认图增加节点,构造阶段完成后启动图。介绍了交互式使用Session,可用InteractiveSession代替Session类。还提及变量声明,并要实现一个简单的回归学习。

本文介绍了TensorFlow的基础使用。在Python库中,op构造器可向默认图增加节点,构造阶段完成后启动图。介绍了交互式使用Session,可用InteractiveSession代替Session类。还提及变量声明,并要实现一个简单的回归学习。

2388

2388

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?