转载自:https://blog.youkuaiyun.com/Coco825211943/article/details/82195036

https://blog.youkuaiyun.com/zziahgf/article/details/80196376

nn.L1Loss

nn.MSELoss(均方损失函数)

nn.BCELoss(Binary Cross Entropy二分类交叉熵)

nn.CrossEntropyLoss(多分类交叉熵)

nn.KLDivLoss(这个是重点)

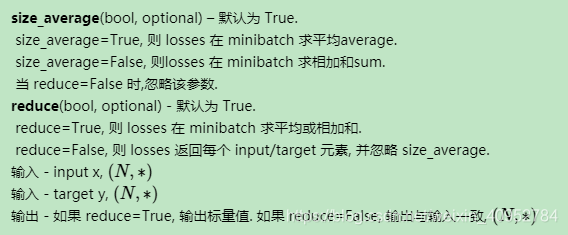

class torch.nn.KLDivLoss(size_average=True, reduce=True)作用:

相对熵, 也叫 KL 散度, Kullback-Leibler divergence Loss.

KL 散度用于估计连续分布的距离.

当对连续输出分布进行直接回归时, KL 散度比较有用.

输入 input 应该是在进行了一次 forward 来计算每个类别class 的 log-probabilities 概率.

输入 input 不一定是 2D Tensor, 因为其计算是逐元素进行的.

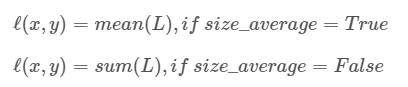

![]()

N - batchsize.

如果 reduce=True,

参数:

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?