卷积神经网络接触很久了,但是总感觉有一种很朦胧的感觉,今天重新理解一下CNN和CNN中卷积的概念。

如何通俗的理解卷积,关于卷积首先要理解,他只是一个为了方便计算学习而定义的概念,是一种抽象的符号,就像是加减乘除一样。原文文章从连续卷积,离散卷积定义开始,以动图的形式将卷积形象化,其中掷骰子和蒸馒头对于离散和连续卷积解释的很清楚。请参照引用文章。

说到图像卷积这一点,终于弄明白卷积和平滑滤波的关系与区别了,当然我认为CNN实质上还是一种滤波,也就是局部像素的加权和。一直以来我都有一个误区,认为这个滤波就是卷积核与原始图像对应位置相乘求和,这与数字图像种滤波的操作没有什么异同,为什么叫图像卷积呢?

文章这个二维卷积过程给出,实际上卷积过程中需要满足下标和是固定的,也就是公式中的 n n n是定的。所以如果理解为卷积核与图像对应位置加权和,那么就像原文中所说的,把 g g g矩阵,也就是卷积核旋转了180°。那么CNN中的卷积核翻转了嘛,这个问题其实没什么意思,因为上述卷积过程 g g g矩阵是已知的,而我们CNN中的卷积核是参数,需要求解的,可以认为是最能够提取特征点的卷积核参数,那是不是也可以认为是翻转过的呢。从这个角度来说,CNN卷积核学习滤波器参数好像更合理。关于CNN中卷积核与卷积的关系,知乎几个答案都有都道理也比较清晰。

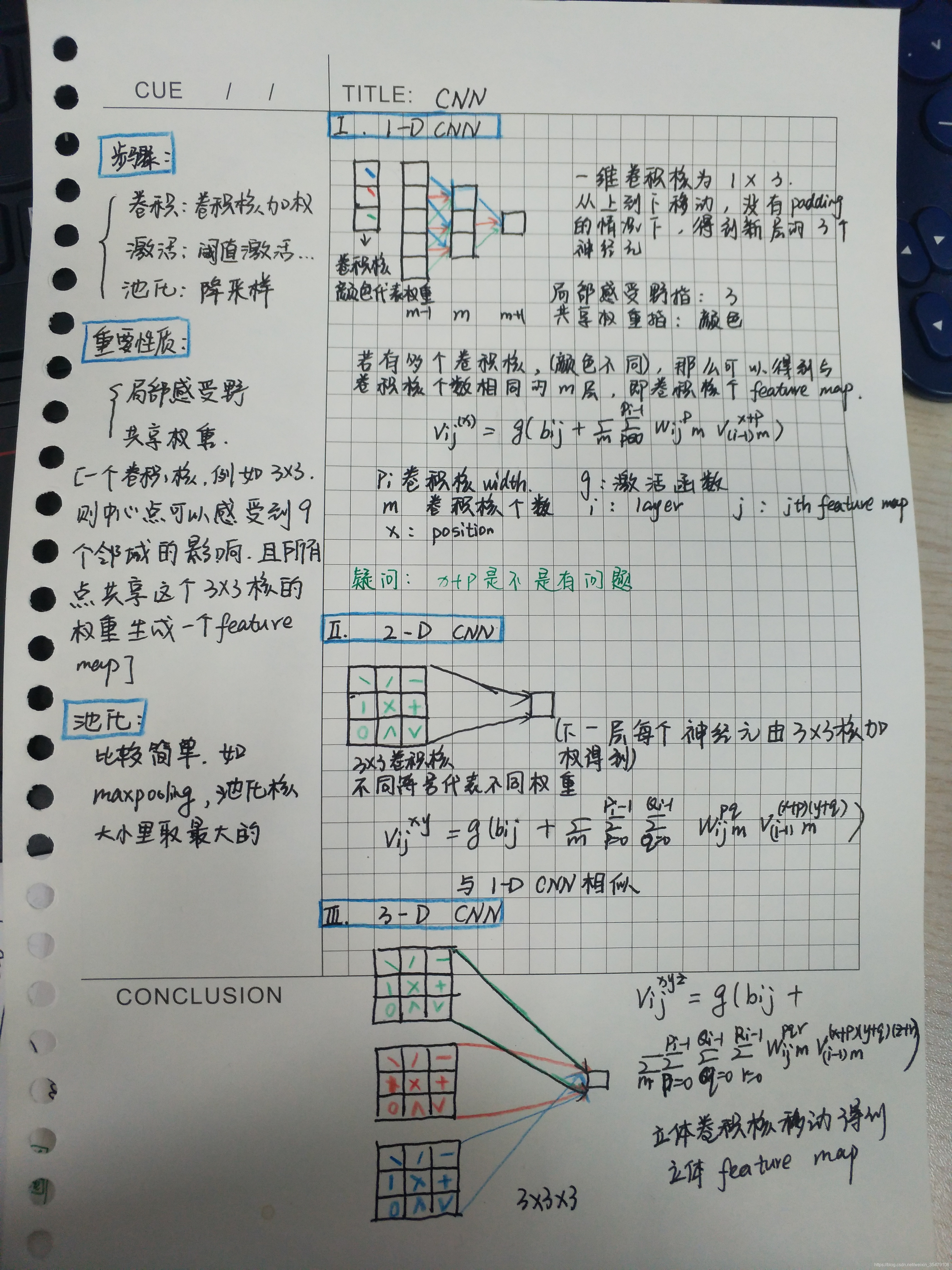

本文深入探讨了卷积神经网络(CNN)中的卷积概念,解释了卷积与滤波的关系,以及CNN卷积核如何作为参数进行学习,以实现对图像特征的有效提取。

本文深入探讨了卷积神经网络(CNN)中的卷积概念,解释了卷积与滤波的关系,以及CNN卷积核如何作为参数进行学习,以实现对图像特征的有效提取。

14万+

14万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?