在二分类问题中,通常假设正负类别相对均衡,然而实际应用中类别不平衡的问题,如100, 1000, 10000倍的数据偏斜是非常常见的,比如疾病检测中未患病的人数远超患病的人数,产品质量检测中合格产品数量远超不合格产品等。在检测信用卡欺诈问题中,同样正例的数目稀少,而且正例的数量会随着时间和地点的改变而不断变化,分类器要想在不断变化的正负样本中达到好的检测效果是非常困难的。

由于类别不平衡问题的特性使然,一般常使用于评估分类器性能的准确率和错误率可能就不再适用了。因为在类别不平衡问题中我们主要关心数目少的那一类能否被正确分类,而如果分类器将所有样例都划分为数目多的那一类,就能轻松达到很高的准确率,但实际上该分类器并没有任何效果。

所以在这种时候学习的前提往往是采用不同的评估指标。学习机器学习的过程中总不免碰到各种评估指标,刚开始很容易被五花八门的术语绕晕了,所以类别不平衡问题的第一篇先对这些指标进行梳理。毕竟评估指标不明确的话,后面模型的效果好坏也就无从谈起。

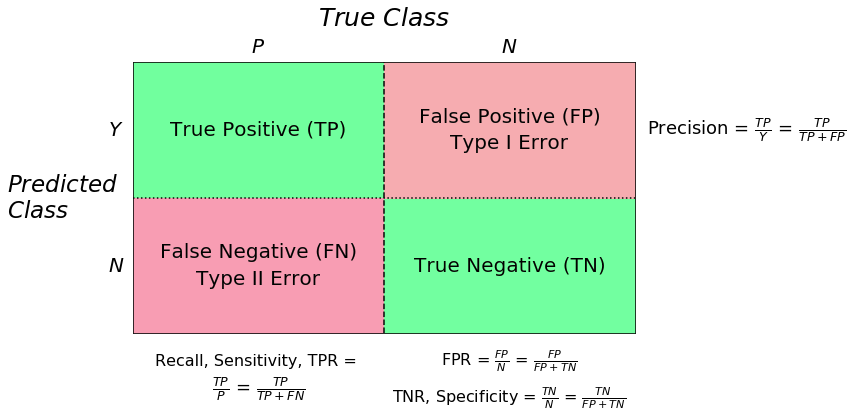

在二分类问题中,一般将数目少的类别视为正例,数目多的类别视为负例,下面先用matplotlib画张混淆矩阵图来直观地感受一下:

plt.figure(figsize=(10,6))

plt.text(0.5,2.25,'True Positive (TP)',size=20,horizontalalignment="center",verticalalignment="center")

plt.text(1.5,2.4,'False Positive (FP)',size=20,horizontalalignment="center",verticalalignment="center")

plt.text(0.5,0.9,'False Negative (FN)',size=20,horizontalalignment="center",verticalalignment="center")

plt.text(1.5,0.75,'True Negative (TN)',size=20,horizontalalignment="center",verticalalignment="center")

plt.text(1,3.4,'$True\ Class$',size=25,horizontalalignment="center")

plt.text(-0.5,1.5,'$Predicted$\n$Class$',size=23,verticalalignment="center")

plt.text(0.5,3.1,'$P$',size=20,horizontalalignment="center")

plt.text(1.5,3.1,'$N$',size=20,horizontalalignment="center")

plt.text(-0.1,2.25,'$Y$',size=20,va="center")

plt.text(-0.1,0.75,'$N$',size=20,va="center")

plt.text(2.4,2.25,r'Precision = $\frac{TP}{Y}$ = $\frac{TP}{TP+FP}$ ',size=18,ha="center",va="center")

plt.text(0.5,-0.3,'Recall, Sensitivity, TPR = ',size=16,ha="center",va="center")

plt.text(0.5,-0.6,'$\\frac{TP}{P}$ = $\\frac{TP}{TP+FN}$',size=18,ha="center",va="center")

plt.text(1.5,-0.3,'FPR = $\\frac{FP}{N}$ = $\\frac{FP}{FP+TN}$',size=16,ha="center",va="center")

plt.text(1.5,-0.7,'TNR, Specificity = $\\frac{TN}{N}$ = $\\frac{TN}{FP+TN}$',size=16,ha="center",va="center")

plt.text(1.5,2.1,'Type I Error',size=20,horizontalalignment="center",verticalalignment="center")

plt.text(0.5,0.6,'Type II Error',size=20,horizontalalignment="center",verticalalignment="center")

plt.xticks([])

plt.yticks([])

plt.plot([1,1],[0,3],'k--')

plt.plot([0,3],[1.5,1.5],'k:')

plt.axis([0,2,0,3])

plt.fill_between([0,1],[1.5,1.5],[3,3],color='#98FB98')

plt.fill_between([0,1],[0,0],[1.5,1.5],color='#EEA9B8')

plt.fill_between([1,2],[0,0],[1.5,1.5],color='#9AFF9A')

plt.fill_between([1,2],[1.5,1.5],[3,3],color='#EEB4B4')

True Positive (真正例,TP):实际为正例,预测为正例。

False Negative (假负例,FN):实际为正例,预测为负例。

True Negative (真负例,TN):实际为负例,预测为负例。

False Positive (假正例,FP):实际为负例,预测为正例。

Precision (查准率) = \(\frac{TP}{TP+FP}\) ,Precision衡量的是所有被预测为正例的样本中有多少是真正例。但Precision并没有表现有多少正例是被错判为了负例(即FN),举个极端的例子,分类器只将一个样本判为正例,其他所有都判为负例,这种情况下Precision为100%,但其实遗漏了很多正例,所以Precision常和下面的Recall (TPR) 相结合。

True Positive Rate (TPR,真正例率) = \(\frac {TP}{TP+FN}\) ,又称__Recall__(查全率),Sensitivity(灵敏性)。Recall (TPR)衡量的是所有的正例中有多少是被正确分类了,也可以看作是为了避免假负例(FN)的发生,因为TPR高意味着FN低。Recall的问题和Precision正相反,没有表现出有多少负例被错判为正例(即FP),若将所有样本全划为正例,则Recall为100%,但这样也没多大用。

False Negative Rate (FNR,假负例率) = \(\frac{FN}{TP+FN}\) = \(1 - TPR\),由混淆矩阵可以看出该指标的着眼点在于正例,意为有多少正例被错判成了负例。

True Negative Rate (TNR,真负例率) = \(\frac{TN}{TN+FP}\) ,又称Specificity(特异性)。Specificity衡量的是所有的负例中有多少是被正确分类了,由于类别不平衡问题中通常关注正例能否正确被识别,Specificity高则FP低,意味着很少将负例错判为正例,即该分类器对正例的判别具有“特异性”,在预测为正例的样本中很少有负例混入。

False Positive Rate (FPR,假正例率) = \(\frac{FP}{TN+FP}\) = \(1 - TNR\), 由混淆矩阵可以看出该指标的着眼点在于负例,意为有多少负例被错判成了正例。在ROC曲线中分别以TPR和FPR作为纵、横轴作图,显示出一种正例与负例之间的“博弈”,在下篇文章中详解。

F1 score = \[\frac{2}{\frac{1}{recall}+\frac{1}{precision}} = \frac{2 × precision × recall}{precision + recall}\],是一个综合指标,为Precision和Recall的调和平均 (harmonic mean),数值上一般接近于二者中的较小值,因此如果F1 score比较高的话,意味着Precision和Recall都较高。

FP和FN还有个还有个与之相关的概念,那就是统计假设检验中的第一类错误 (Type I error)和第二类错误 (Type II error) 。由于我们比较关心正例,所以将负例视为零假设,正例视为备选假设,则第一类错误为错误地拒绝零假设 (负例),选择备选假设,则为FP;第二类错误为错误地接受零假设,则为FN。

在类别不平衡问题中,传统的准确率评估指标可能误导模型效果。本文介绍真正例率、假正例率等指标,帮助理解如何正确评估分类器性能。

在类别不平衡问题中,传统的准确率评估指标可能误导模型效果。本文介绍真正例率、假正例率等指标,帮助理解如何正确评估分类器性能。

1696

1696

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?