文章目录

Transformer模型的预训练与微调技术

总结

介绍了自然语言处理技术的发展历程,特别是Transformer模型的崛起,并详细介绍了Transformer模型的核心概念、算法原理和应用场景。

摘要

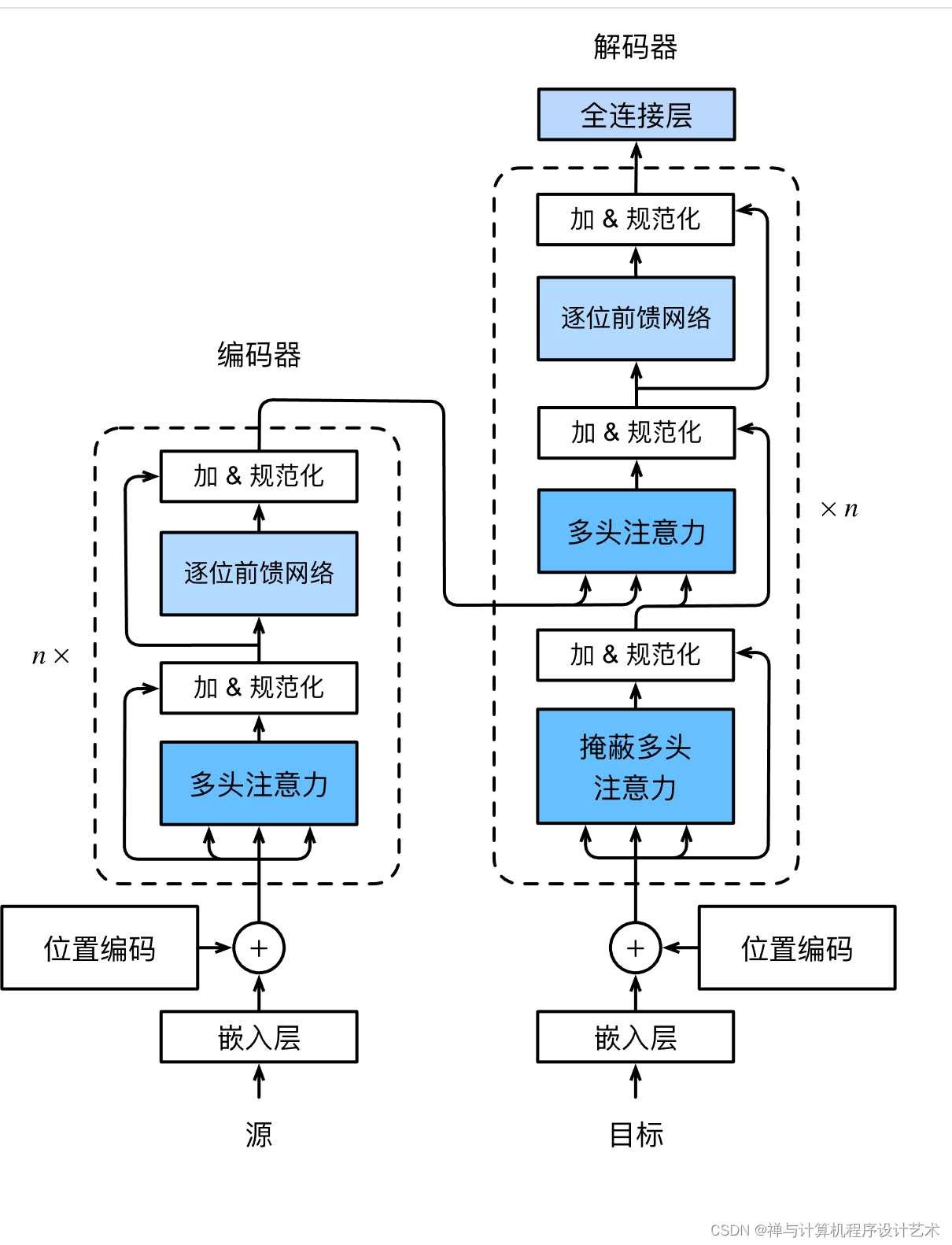

自然语言处理技术是人工智能领域的重要研究方向,其目标是使计算机能够理解和处理人类语言。近年来,随着深度学习技术的兴起,NLP领域取得了显著的进展。Transformer模型是一种基于自注意力机制的深度学习模型,它采用编码器-解码器架构,并通过多头注意力机制来捕捉输入序列中不同位置之间的依赖关系。Transformer模型的出现,标志着NLP领域进入了一个新的时代,它在各种NLP任务上取得了显著的性能提升,并具有可并行化、易于训练等优点,成为了当前NLP领域的主流模型。

要点

- 自然语言处理技术的发展历程

- Tran

本文深入探讨Transformer模型,从背景、核心概念到算法原理,揭示其在NLP领域的广泛应用。Transformer通过自注意力机制和编码器-解码器架构,解决了RNN的计算瓶颈,成为NLP主流模型。文章还介绍了预训练与微调技术,展示其在机器翻译、文本摘要等任务上的优势。

本文深入探讨Transformer模型,从背景、核心概念到算法原理,揭示其在NLP领域的广泛应用。Transformer通过自注意力机制和编码器-解码器架构,解决了RNN的计算瓶颈,成为NLP主流模型。文章还介绍了预训练与微调技术,展示其在机器翻译、文本摘要等任务上的优势。

订阅专栏 解锁全文

订阅专栏 解锁全文

1121

1121

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?