本文主要记录第一次尝试使用本地部署开源大模型。

目录

环境准备

硬件:MAC电脑、M1芯片 、内存16G

部署框架:Ollama

软件:docker

用户界面:web-ui

大模型:阿里的千问Qwen 0.5、1.5、2.0

安装Ollama

进入Ollama官网

点击下载macOS版本,然后下载后解压,解压后得到Ollama.app文件,将其复制到应用程序目录中,如下图,即可完成安装

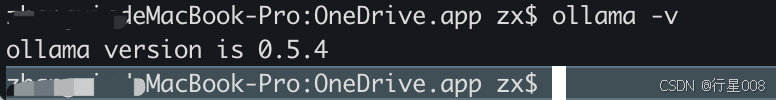

点击Ollama运行,通过shell命令查看是否安装成功,在控制台执行如下命令:

ollama -v执行结果如下:

表示成功!

具体Ollama的使用请查看文档:Ollama常用命令

推荐:控制台命令工具iTerm。

安装open-webUI

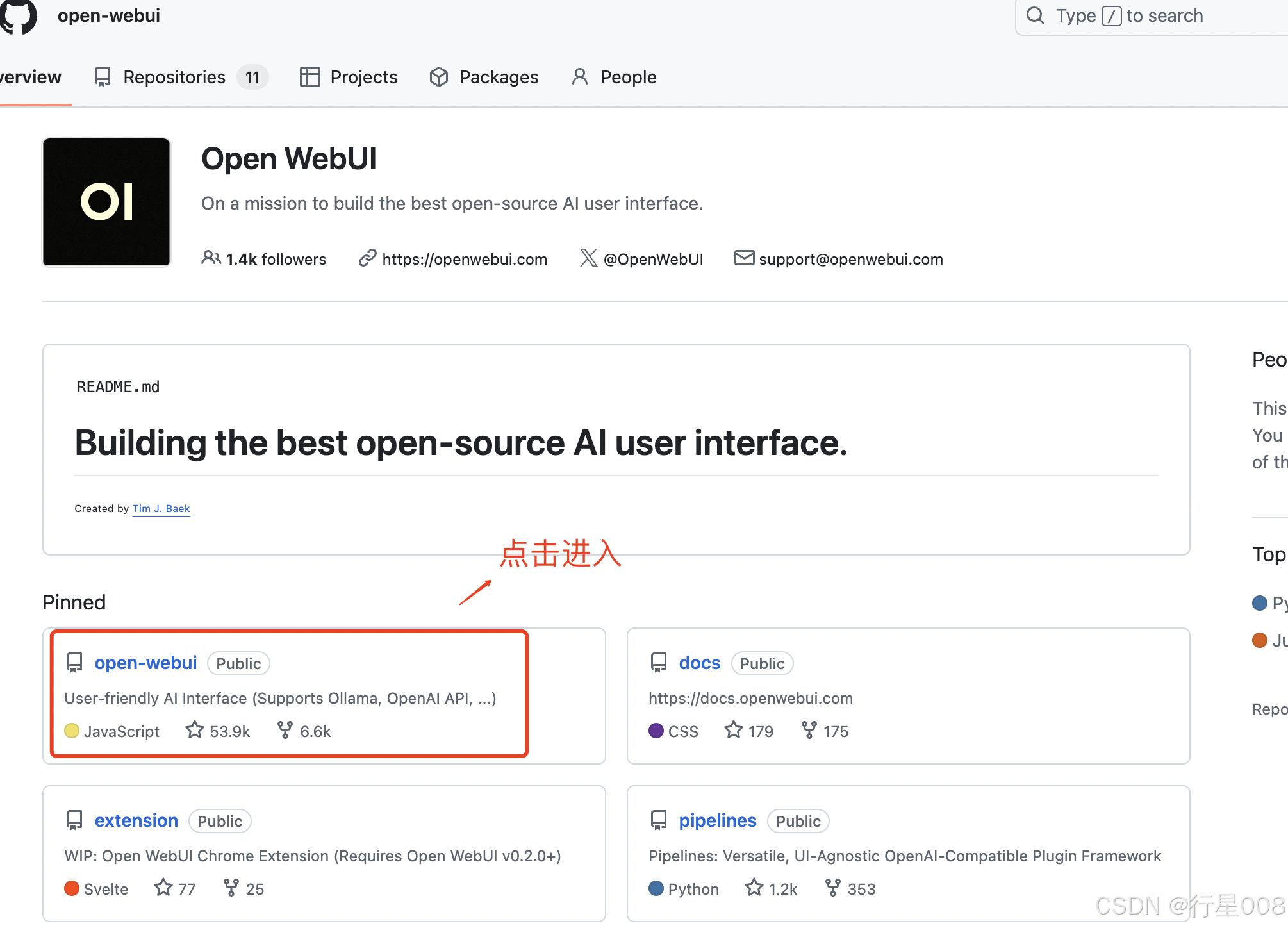

进入到GitHub中open-webUI的源码首页:https://github.com/open-webui

点击如下图进入到open-webui项目

Docker方式安装open-webUI

第一步:安装docker

进入docker官网:Docker,点击下图进行下载安装包

然后下载后进行安装,然后点击docker图标启动,成功启动后电脑上面会有如下图标:

表示安装成功,且成功运行。

第二步:安装open-webUI

进入open-webUI项目后,找到docker安装方式的命令如下:

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main在shell控制台运行命令,结果如下:

在docker中查看镜像运行情况如下:

表示成功安装并运行。

Anaconda方式安装open-webUI

第一步:安装Anaconda

安装Anaconda请参考如下文档:

第二步:安装open-webUI

依次执行如下命令

#创建open-webUI虚拟环境

conda create -n open-webui python=3.11.0

#激活open-webUI虚拟环境

conda activate open-webui

#在open-webUI虚拟环境中安装open-webui依赖

pip install open-webui

执行结果如下:

第三步:启动open-webUI

通过执行如下命令:

#在open-webUI虚拟环境中执行open-webUI启动命令

open-webui serve执行结果如下:

出现上图内容即可通过http://localhost:8080进行访问。

模型安装和使用

Ollama模型安装

环境安装完成后,可以安装通过Ollama安装模型,点击Ollama页面中的Models进入Ollama管理模型界面,或直接点击地址进入:Ollama

在Ollama大模型管理界面输入“qwen”关键字搜索“Qwen2”大模型,如下图:

进入模型,执行运行模型的命令,如下图:

此处我们运行1.5b版本,执行如下命令:

ollama run qwen2:1.5b运行结果如下:

如上图已经安装完成,且已经运行成功。

Ollama模型使用

通过shell脚本命令

输入问题进行沟通如下:

通过open-webUI使用

Docker中安装后访问open-webUI

在docker中成功运行open-webui镜像后,在浏览器中输入:http://localhost:3000/

进入webui首页,如下图:

进行对话:

Anaconda中安装后访问open-webUI

在浏览器中输入:http://localhost:8080/

进入webui首页,如下图:

第一次访问时需要输入用户名、邮箱、密码后进入

admin 、admin@test.com、admin1234

进入open-webUI首页如下

至此,成功将开源大模型部署到Mac M1本地。

扩展内容

1、open-webUI管理Ollama的模型方式

2667

2667

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?