挑战

尽管将联邦学习与LoRA结合可以通过矩阵分解减少可训练参数的数量,但通信成本仍然随着分解的秩线性增加。当复杂任务需要更高秩的LoRA模块时,这尤其会带来挑战,尤其是在资源受限的移动设备上。此外,分布式设备之间计算和通信能力的异质性使得统一的秩变得低效:固定的秩r对于某些设备来说可能过大,而对于更强大的设备来说又过小,导致资源未充分利用。因此,一种既能减少通信开销又能适应异构设备能力的解决方案对于LLM的协作微调非常必要。尽管一些现有的方法试图提供解决方案(Cho et al., 2024; Bai et al., 2024; Wang et al., 2024),但它们要么缺乏理论依据,要么增加了额外的计算开销,留下了一个高效且理论支持的解决方案的巨大空白。如第2.2节所述,一个全面的方法仍然难以实现,它既要保留LoRA的优势,又要解决在资源受限的设备上进行异构微调的挑战,并提供理论保证。

1.1 研究贡献

鉴于这些限制,本研究旨在开发一种用于设备上LLM协作微调的方法,该方法(i)保留LoRA的灵活性,(ii)提供理论收敛保证,并且(iii)解决由分布式设备的系统异质性和资源约束所带来的挑战。如图1所示,我们的关键思想是在微调过程中引入基于素描的LoRA更新,这允许设备在每一轮中选择性地更新LoRA模块的子矩阵的行和列,通过系统减少计算和通信消耗。此外,我们的方法通过调整素描矩阵的稀疏水平,即每个设备在每次迭代中更新的子矩阵的大小,来定制微调过程,如图1所示。正如我们将看到的,引入的素描机制对整体优化格局的影响需要仔细考虑,这为理论分析带来了额外的挑战,而我们对此进行了研究。

总体而言,我们的贡献如下:

1.我们提出了联邦素描LoRA(FSLoRA),它利用素描机制,使设备能够选择性地更新由服务器维护的全局LoRA模块的子矩阵。通过调整素描比例(决定设备上子矩阵的秩),FSLoRA有效地适应了设备特定的通信和计算约束。

2.我们在非均匀子矩阵更新场景下(即异构LoRA配置)对FSLoRA进行了严格的收敛性分析,揭示了素描比例如何影响收敛速度。特别是,我们展示了增加素描比例理论上可以改善收敛速度,但会增加通信和计算成本,突出了在选择素描比例时的微妙权衡。

3.我们在多个数据集和LLM模型上进行了广泛的实验,并在不同的参数设置下进行了测试,证明了FSLoRA在测试精度、训练时间和资源利用方面相比各种基线的优越性能,验证了素描机制的有效性。

1.2 相关工作

基于LoRA的参数高效微调

LoRA最初由Hu等人(2021)提出,作为一种参数高效的全模型微调替代方案,通过低秩矩阵近似实现。随后,Kalajdzievski(2023)提出了秩稳定的LoRA(rsLoRA),通过修改缩放因子来增强LoRA在高秩场景下的性能。Shuttleworth等人(2024)证明,随着LoRA模块秩的增加,rsLoRA能够接近全模型微调的性能。Malinovsky等人(2024)研究了LoRA模块的交替更新,并提供了理论分析。Han等人(2024)引入了一个与LoRA模块并行的稀疏矩阵,以提高LoRA的拟合能力。Lialin等人(2023)和Xia等人(2024)提出了ReLoRA和LoRA链,通过定期将学习到的LoRA模块合并到全模型中,实现高秩微调。然而,上述工作都假设微调所需的训练数据可在中央服务器上使用,属于集中式场景。

通过联邦LoRA实现协作微调

借助LoRA的高效性,联邦LoRA作为一种在分布式设备上协作微调LLM的有前景的方法,最近引起了广泛关注(Chen等人,2023)。Sun等人(2024)研究了在引入差分隐私的情况下联邦LoRA的性能。为了减少通信开销,Kuo等人(2024)提出了将通信压缩与联邦LoRA相结合的方法。与此同时,Bai等人(2024)、Cho等人(2024)、Byun和Lee(2024)、Wang等人(2024)和Koo等人(2024)探讨了分布式设备资源异质性带来的挑战,并引入了异构LoRA作为解决方案。然而,Cho等人(2024)、Koo等人(2024)和Byun和Lee(2024)提出的方法缺乏理论依据。FlexLoRA(Bai等人,2024)由于依赖奇异值分解(SVD)而增加了额外的计算开销。此外,Bai等人(2024)和Wang等人(2024)提出的堆叠LoRA方法要求设备将LoRA模块整合到基础模型中,从而牺牲了LoRA固有的灵活性,无法支持不同任务的多个适配器。总体而言,目前仍然缺乏一种能够有效应对异构设备协作微调挑战的系统性且具有理论依据的解决方案。

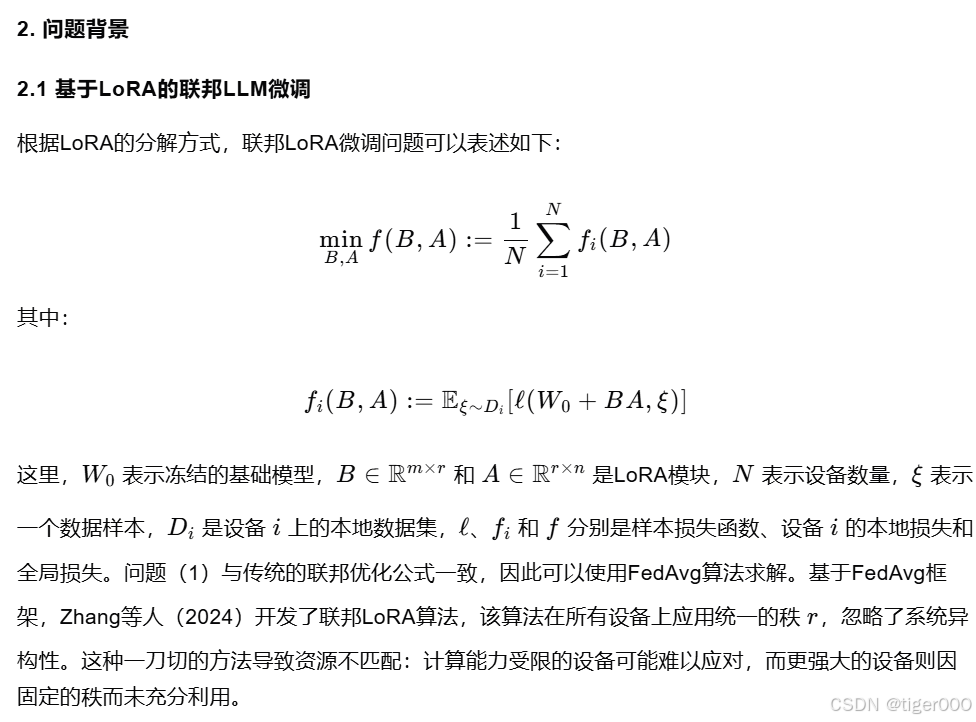

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?