Conv1d 和 Conv2d 分别是卷积神经网络(CNN)中的两种卷积层操作,它们在处理不同维度的数据上有联系和区别,本文是一篇学习笔记。

本文主要包括以下内容:

1.联系

-

卷积操作原理:无论是

Conv1d还是Conv2d,它们的基本原理都是一样的,都是通过卷积核(或滤波器)与输入数据进行卷积运算,以提取特征。 -

神经网络中的使用:

Conv1d通常用于处理序列数据,如文本数据或音频数据,因为它在一个维度上进行卷积操作。而Conv2d通常用于处理图像数据,因为它在两个维度上进行卷积操作。 -

参数配置:它们都可以配置卷积核的大小、步幅、填充等参数,以控制卷积操作的行为。

2.区别

-

维度:最明显的区别是维度。

Conv1d是一维卷积,主要用于处理一维序列数据,如文本或音频。而Conv2d是二维卷积,主要用于处理二维数据,如图像。 -

卷积核的形状:在

Conv1d中,卷积核是一维的,通常表示为 (kernel_size,)。而在Conv2d中,卷积核是二维的,通常表示为 (height, width)。 -

输入数据的维度:

Conv1d的输入数据是一维的,形状通常为 (batch_size, channels, sequence_length),其中sequence_length表示序列的长度。而Conv2d的输入数据是二维的,形状通常为 (batch_size, channels, height, width),其中height和width表示图像的高度和宽度。 -

应用领域:由于不同的数据类型和维度要求,它们在不同的应用领域中得到广泛使用。

Conv1d用于文本分类、语音识别等,而Conv2d用于图像分类、目标检测等。

总之,Conv1d 和 Conv2d 是卷积神经网络中的两种常见卷积操作,它们在维度、卷积核的形状和应用领域等方面存在区别。选择合适的卷积层取决于输入数据的类型和任务要求。

3.Conv1d卷积

一维卷积在深度学习中有几种常见的变体,包括:

-

Valid 卷积(有效卷积,Valid Convolution): 这是一种常见的卷积操作,它不对输入进行填充,因此输出的大小会随着卷积核的大小和步幅的设置而减小。这意味着在有效卷积中,输出序列的长度会小于输入序列的长度。

-

Same 卷积(相同卷积,Same Convolution): Same 卷积旨在保持输出的大小与输入的大小相同。为了实现这一点,填充会添加到输入的两侧,以使输出大小保持不变。在一维卷积中,通常将填充大小设置为卷积核大小的一半。

-

Full 卷积(全卷积,Full Convolution): 全卷积操作的目标是生成一个输出大小大于输入大小的输出。这通常需要添加大量的填充以实现,以使输出的大小大于输入的大小。

这些卷积操作可以根据任务需求进行选择。Valid 卷积通常用于减小特征图的大小,以减少模型参数和计算成本。Same 卷积通常用于保持输出和输入的大小一致,有助于保留更多的信息。Full 卷积可能不太常见,但在某些特定情况下可能会有用。

选择哪种卷积操作取决于你的任务和模型设计的需要。

4.Conv2d卷积

在二维卷积中,通常不像一维卷积那样明确定义为有效卷积、相同卷积和全卷积。相反,二维卷积的种类更多,可以根据不同的需求和应用进行调整和组合。以下是一些常见的二维卷积类型和变体:

-

标准的二维卷积(2D Convolution):这是最常见的卷积操作,用于图像处理和计算机视觉等任务。

-

分离卷积(Separable Convolution):将标准的二维卷积分解成两个独立的卷积操作,分别在水平和垂直方向执行,以减少计算量。

-

转置卷积(Transpose Convolution或Deconvolution):用于上采样、反卷积和生成分割结果等任务,可以扩大特征图的尺寸。

-

空洞卷积(Dilated Convolution):通过在卷积核内部引入空洞(也称为膨胀率)来增加感受野,常用于语义分割等任务。

-

深度可分离卷积(Depthwise Separable Convolution):将卷积操作分成深度卷积和逐点卷积两个步骤,以减少参数数量和计算量。

-

膨胀卷积(Atrous Convolution):与空洞卷积类似,可以通过调整膨胀率来控制感受野的大小。

这些是二维卷积的一些常见类型和变体,根据任务需求和模型架构的不同,可以选择适当的卷积操作。二维卷积在图像处理和计算机视觉领域有广泛的应用,它们能够有效地捕捉和提取图像中的特征。

5.图解Conv1d卷积

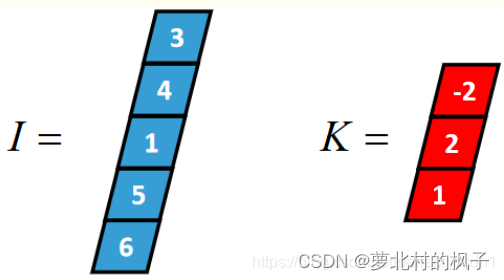

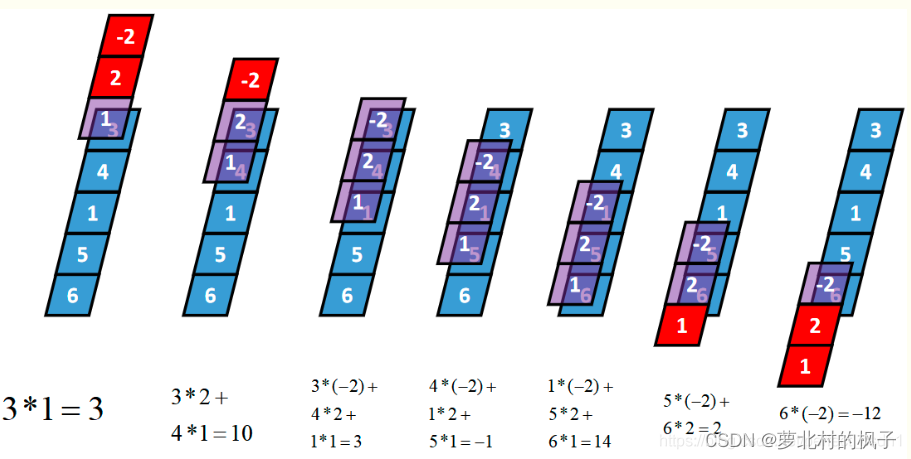

以一个长度为5的一维张量I和长度为3的一维张量k(卷积核)为例,介绍其过程。

(1)Full 卷积(全卷积,Full Convolution)

Full卷积的计算过程是:K沿着I顺序移动,每移动到一个固定位置,对应位置的值相乘再求和,计算过程如下:

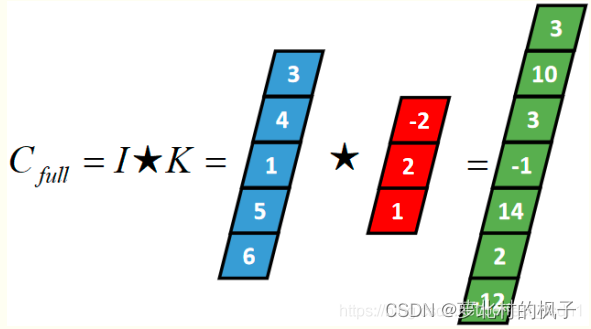

将得到的值依次存入一维张量Cfull,该张量就是I和卷积核K的full卷积结果,其中K卷积核或者滤波器或者卷积掩码,卷积符号用符号表示,记Cfull=IK

(2)Same 卷积(相同卷积,Same Convolution)

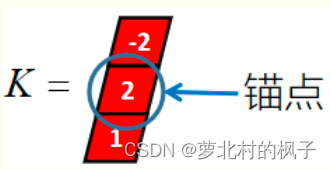

卷积核K都有一个锚点,然后将锚点顺序移动到张量I的每一个位置处,对应位置相乘再求和,计算过程如下:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

447

447

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?