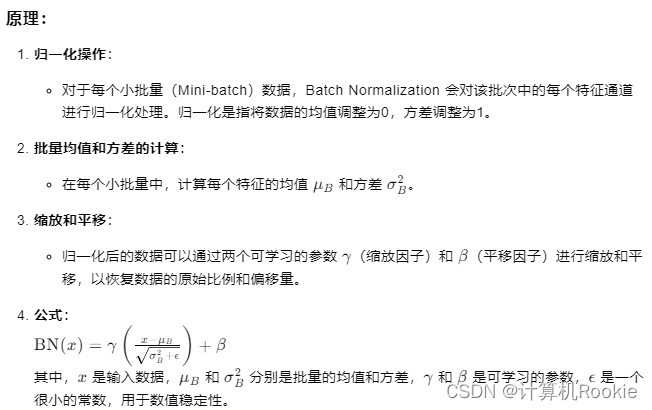

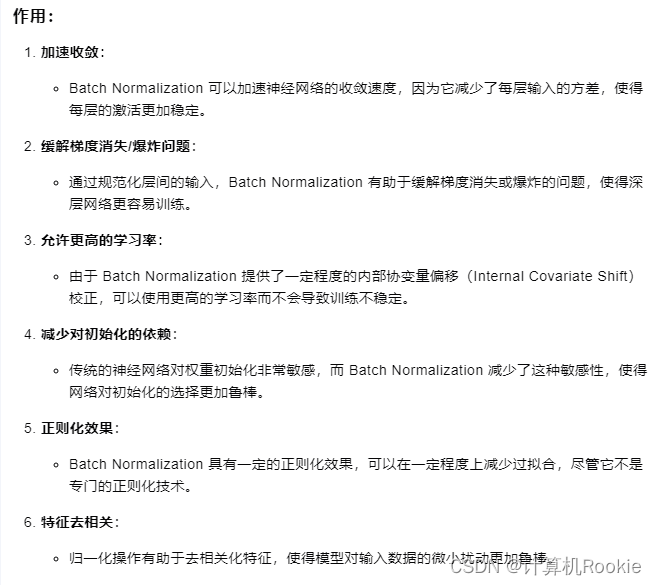

1. 请解释一下Batch Normalization的原理及其在训练深度神经网络中的作用。

Batch Normalization(批归一化)是一种在训练深度神经网络时常用的技术,旨在提高训练速度、稳定性和性能。

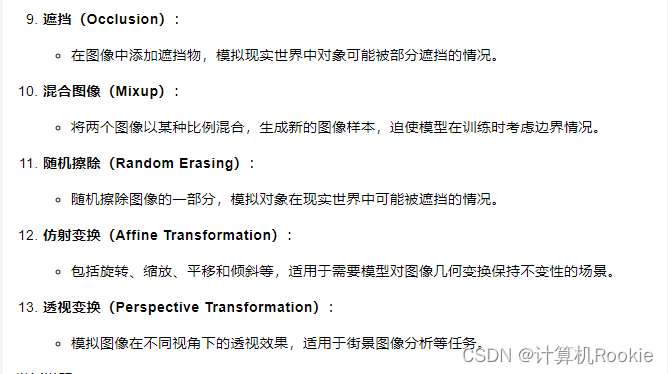

2. 在图像预处理过程中,如何选择合适的图像增强技术来提升模型的泛化能力?请举例说明。

在图像预处理和增强过程中,选择合适的技术对于提升模型的泛化能力至关重要。图像增强可以增加数据集的多样性,减少过拟合,并帮助模型学习到更加鲁棒的特征。

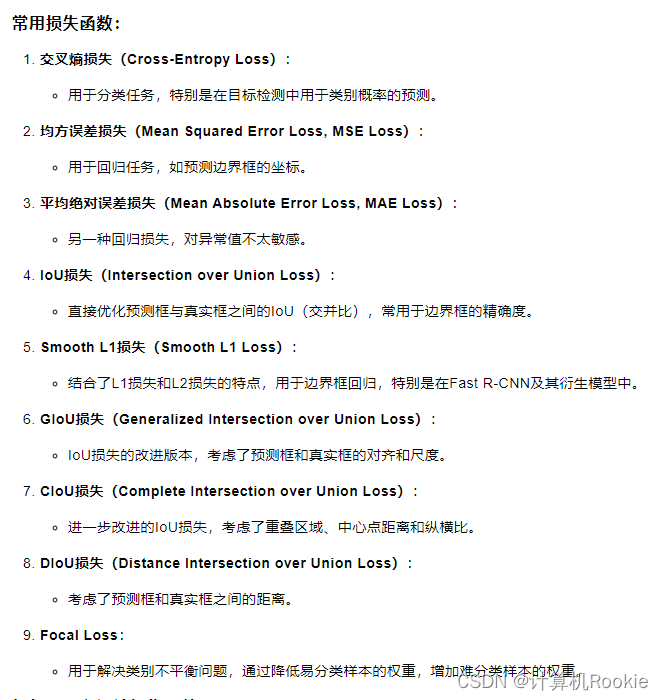

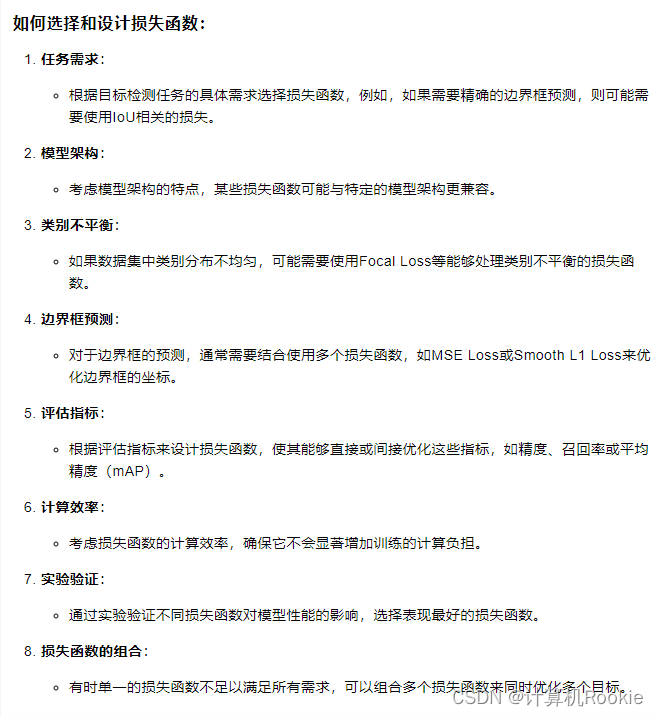

3. 在目标检测任务中,常用的损失函数有哪些?你如何选择和设计一个合适的损失函数?

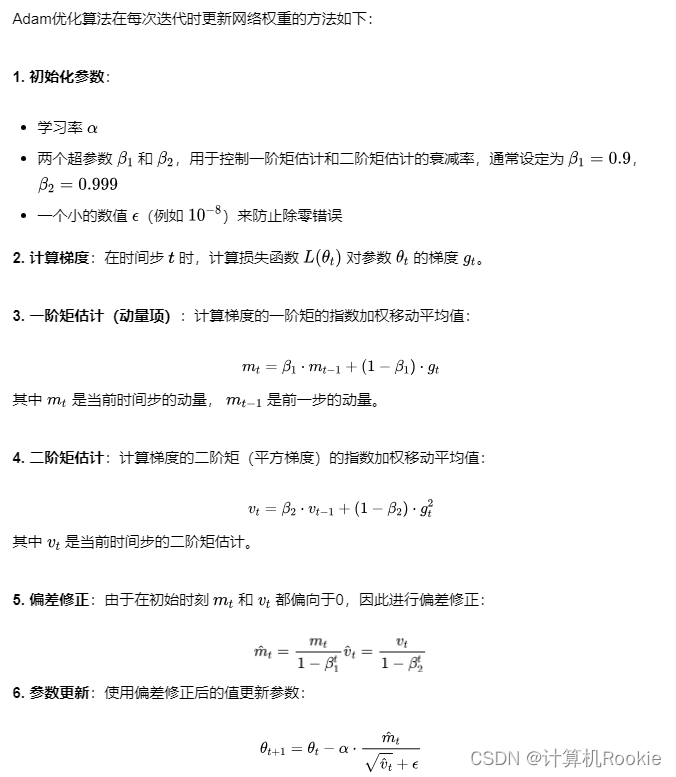

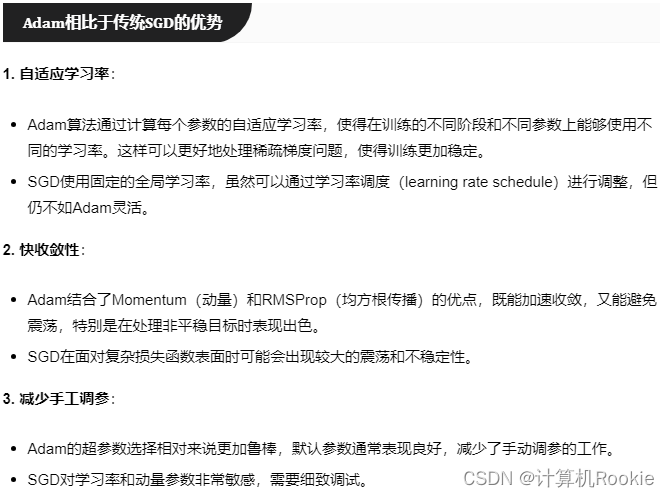

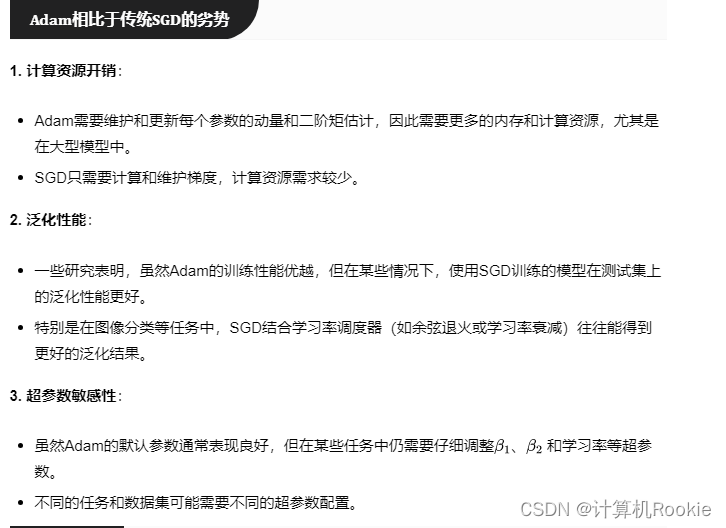

4. 解释Adam优化算法的原理,以及它相比于传统的SGD(随机梯度下降)有哪些优势和劣势。

Adam优化算法(Adaptive Moment Estimation)是一种基于一阶和二阶矩估计的自适应学习率优化算法,广泛用于训练深度神经网络。Adam结合了Momentum和RMSProp的优点,提供了一种稳定且高效的优化方法。

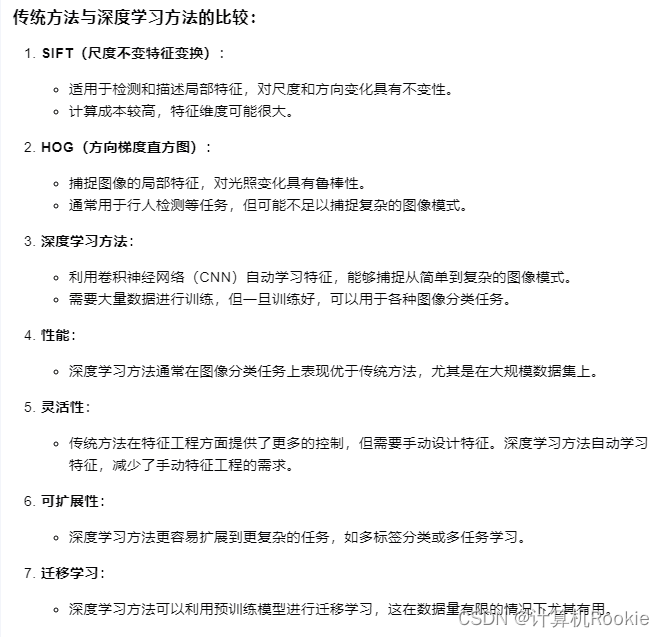

5. 你如何在一个图像分类任务中选择合适的特征提取方法?请比较传统方法(如SIFT、HOG)和深度学习方法。

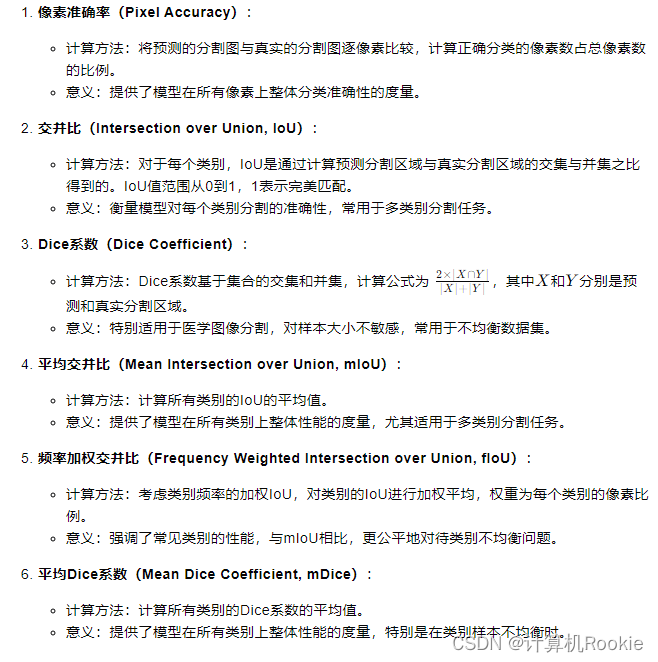

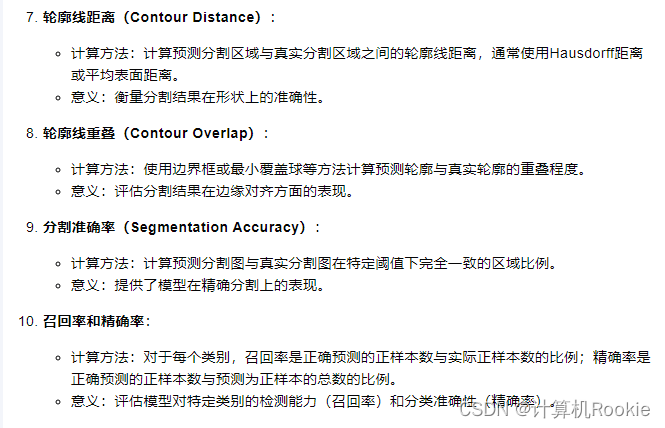

6. 在图像分割任务中,你会使用哪些指标来评估模型的性能?请解释这些指标的计算方法和意义。

在图像分割任务中,评估模型性能的指标用于衡量模型预测的分割图与真实标注之间的一致性。

7. 你如何在数据增强过程中防止过拟合?请举例说明具体的策略和方法。

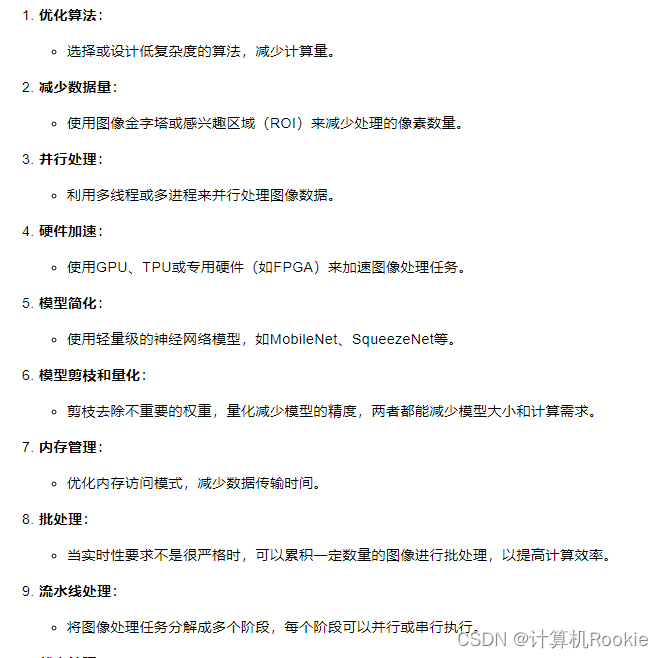

8. 在实现一个实时图像处理系统时,你会采取哪些措施来保证系统的低延迟和高效能?

9. 请解释FPN(Feature Pyramid Networks)的工作原理及其在多尺度目标检测中的应用。

FPN(特征金字塔网络)是一种在深度学习中用于图像识别和目标检测任务的网络结构,主要用于解决多尺度目标检测问题,即在图像中同时检测不同尺寸的物体。

深度学习技术精要

深度学习技术精要

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?