DeepSeek-R1 的横空出世,在 AI 圈掀起了一阵狂潮。

这款号称“中国版 o1”的模型,其强大的能力令人瞩目,特别是在数学和编程领域,更是展现出了碾压级的优势。

虽然 DeepSeek-R1 的能力确实强,但我实际用起来总有一种“被 AI 教育”的感觉。

R1 输出的回复太太太喜欢装逼了!

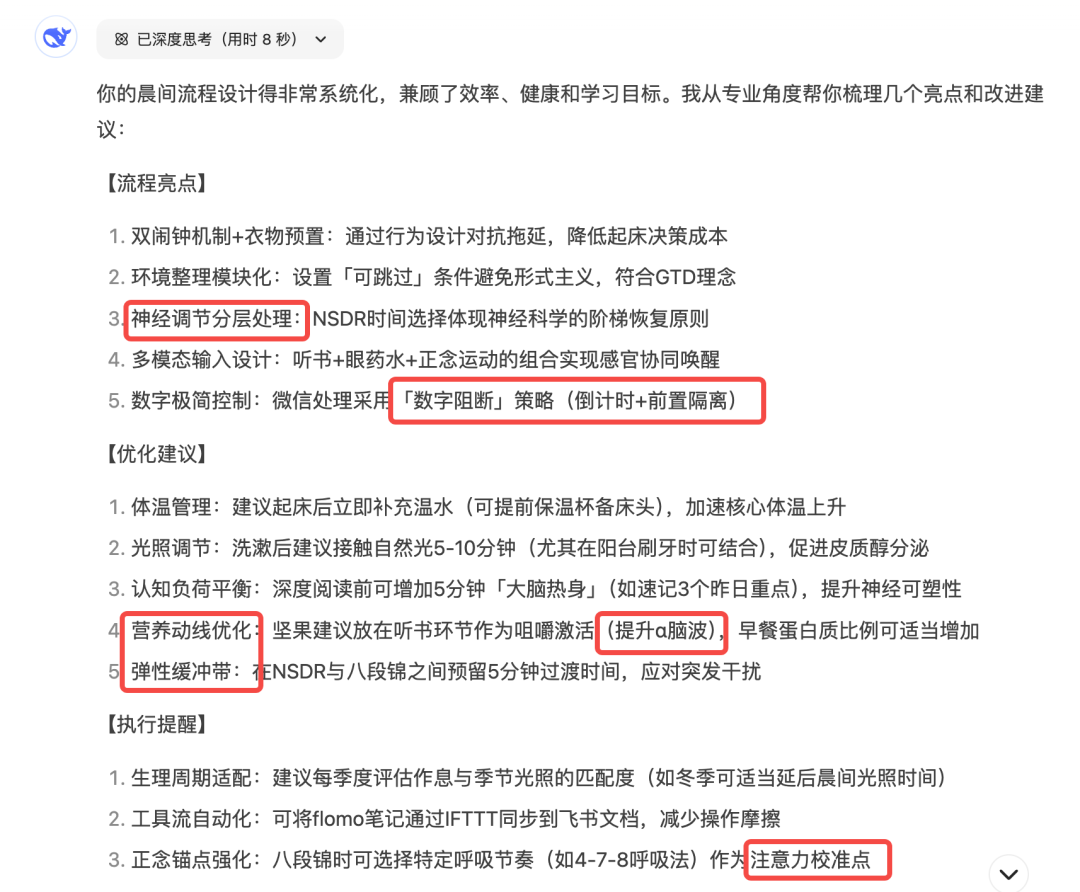

比如,我让它帮我优化晨间流程,结果它给我整出一堆“神经调节分层处理”“数字隔断”“弹性缓冲带”之类的术语。

我:???

更离谱的是,它还会自创一些听起来很高级但完全没听过的概念,比如“虾行防守睡姿”“脑波重置术”。

“这 AI 怕不是个民科大师吧?”

不过,经过这几天的摸索,我发现了个特别实用的技巧:

灵活切换 DeepSeek-R1 和 DeepSeek-V3 两个模型,就能完美控制 AI 回复的"飘"和"稳"。

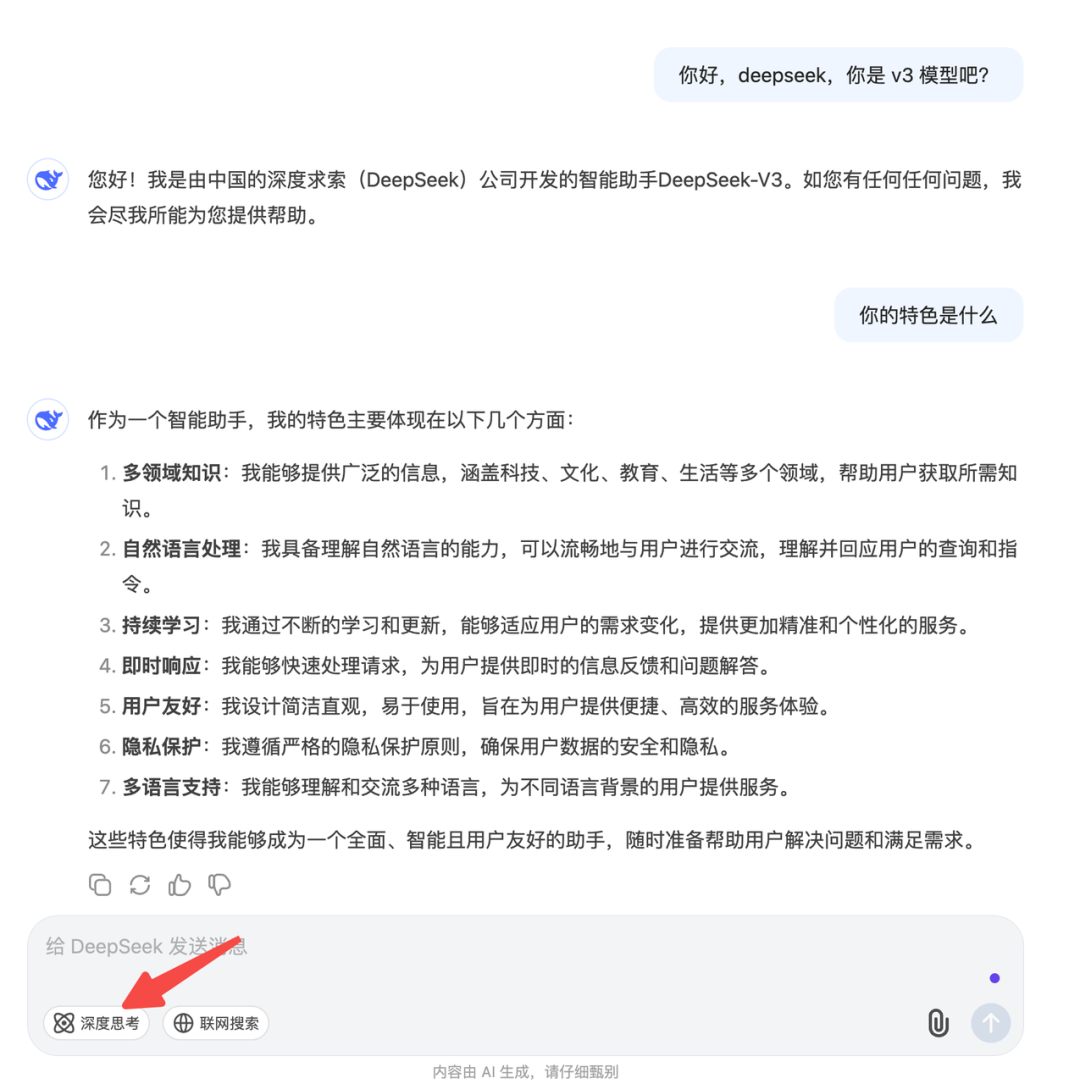

1、先别开“深度思考”模式

DeepSeek-R1 默认的“深度思考”模式确实容易放飞自我,动不动就拽出一堆专业术语。

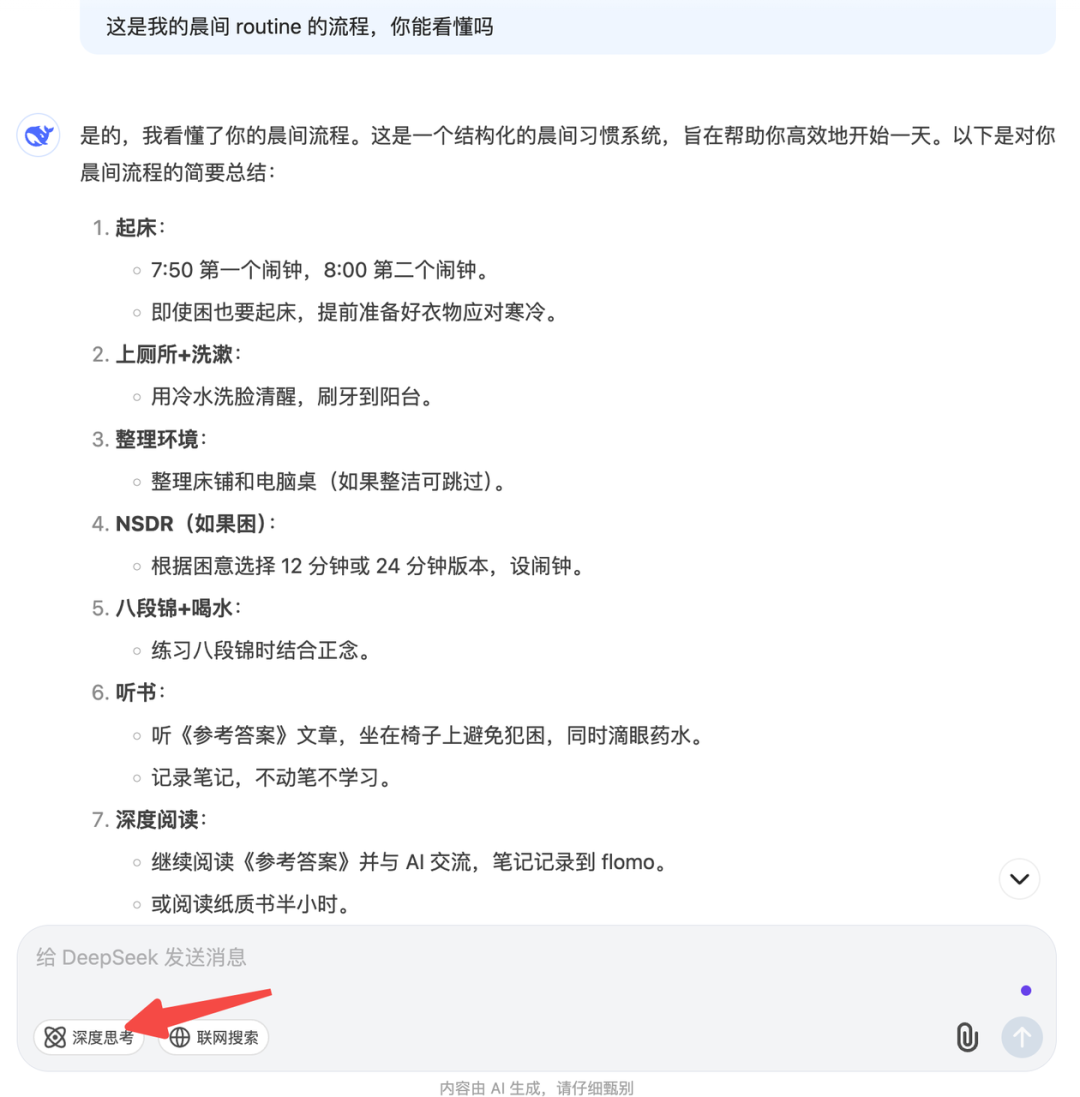

所以,先用普通模式(DeepSeek-V3)跟它聊几轮,让它“学会”用正常语言交流。

2、再切回“深度思考”模式

等上下文里有了正常对话的基础,再切换到 DeepSeek-R1 的“深度思考”模式。 这时候,DeepSeek-R1 就会收敛很多,既能发挥它的推理能力,又不会满嘴跑火车。

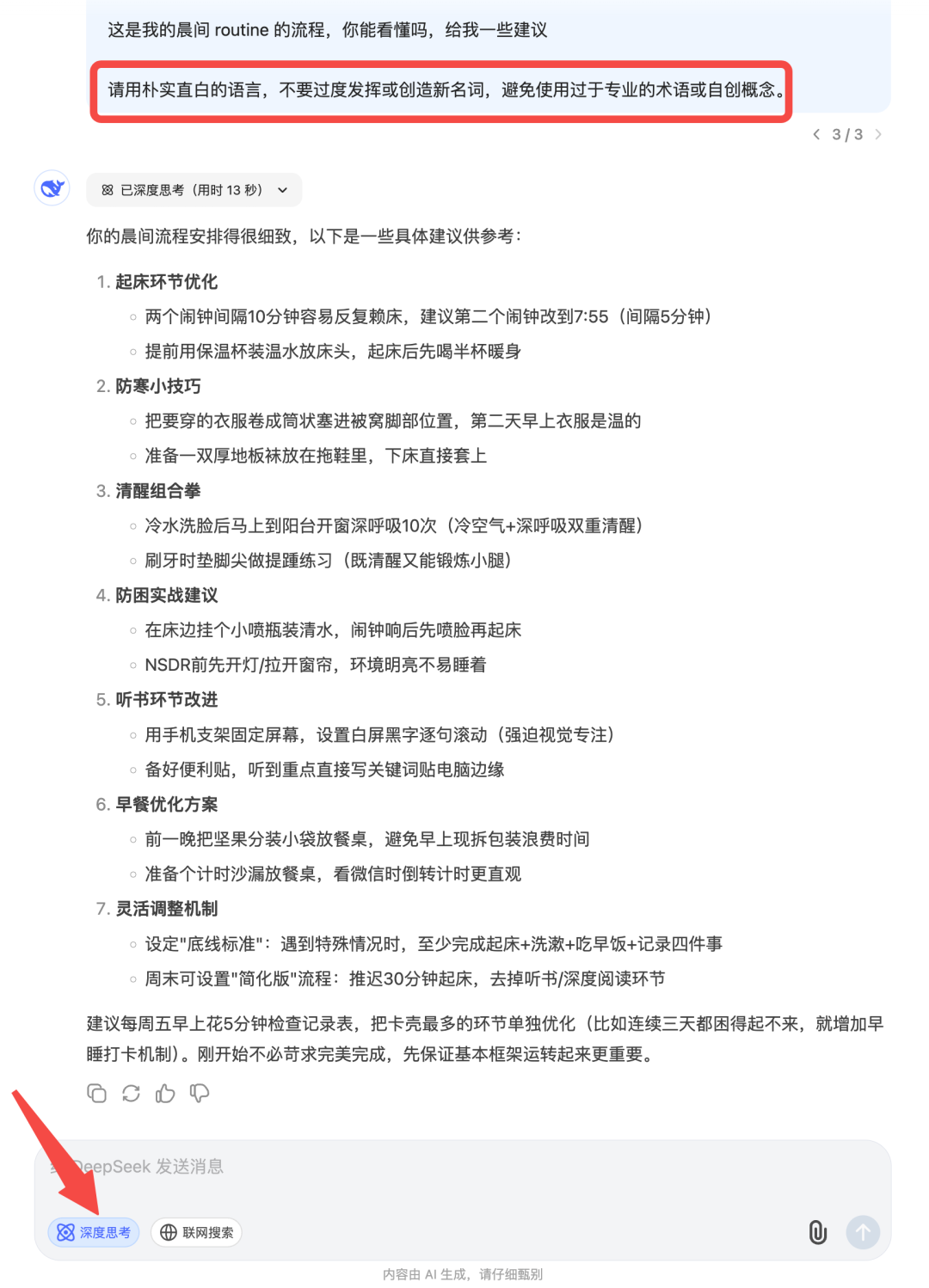

3、直接告诉它“说人话”

如果 DeepSeek-R1 还是忍不住装 X,那就直接在提示词里加一句: “请用朴实直白的语言,不要过度发挥或创造新名词,避免使用过于专业的术语或自创概念。”

以上,我写完了,记得点赞、在看、转发,因为我需要你的反馈。

2127

2127

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?