Qwen3基础知识

此次Qwen3开源8个模型(MOE架构:Qwen3-235B-A22B、Qwen3-30B-A3B,Dense架构:Qwen3 0.6B/1.7B/4B/8B/14B/32B),新版本的Qwen3特性包括:

- 支持混合思维模式,即推理/非推理一体模型:

- 多语言支持:支持119种语言和方言

- Agent能力提升:加强了编码和Agent表现,并加强了MCP的支持

- 快速体验方式:千问web chat官网

其中,除Qwen3-235B-A22B和Qwen3-32B之外,另外6个模型是蒸馏模型。

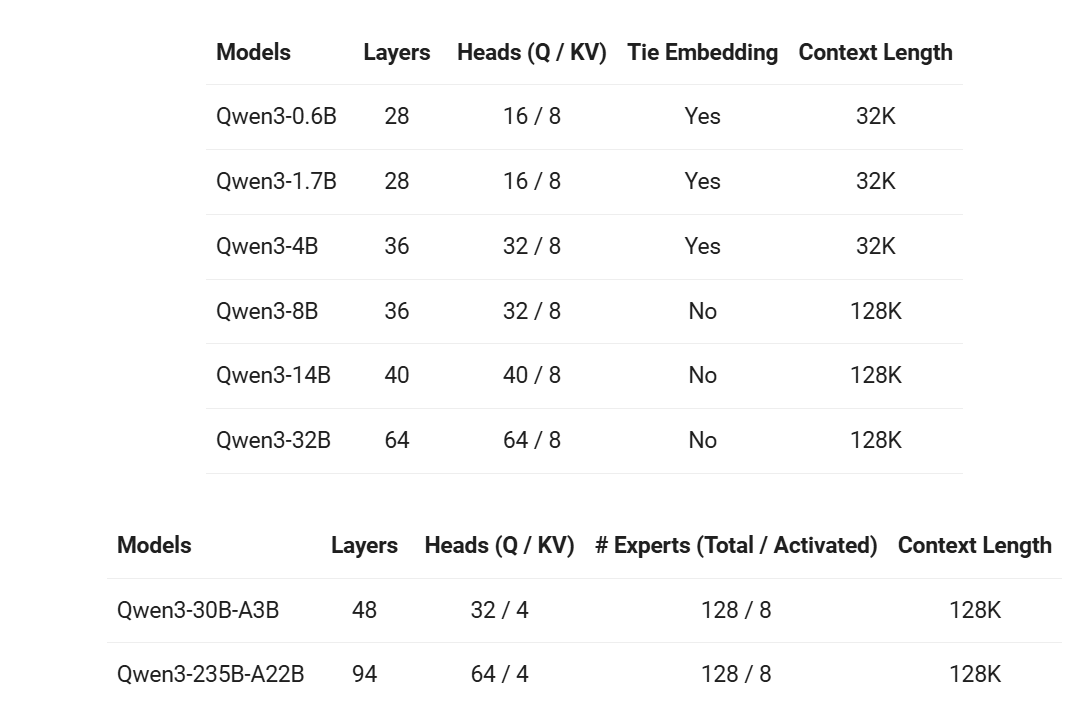

各模型版本的参数:

部署环境

- 单机4090 x 4部署BF16格式的Qwen3-32B模型

- 10并发下,最长上下文可支持96k(128k显存不够,就只测96k)

- vLLM docker版本:vllm/vllm-openai:v0.8.5(>=0.8.5)

- 需安装好Docker和Nvidia container toolkit,可参考Ubuntu Nvidia Docker单机多卡环境配置

Docker部署

模型下载:

- 国内推荐魔塔社区

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2万+

2万+