目录

神经网络基础:感知器、激活函数(ReLU、Sigmoid、Tanh)详解

2.1.1 ReLU(Rectified Linear Unit)

在人工智能领域,神经网络的基础概念是每个机器学习从业者都必须掌握的核心内容。神经网络的核心组成部分包括感知器(Perceptron)和激活函数(Activation Functions)。这些组件决定了模型的非线性表示能力,直接影响到神经网络的学习能力和表现。

在这篇博客中,我们将深入探讨神经网络中的感知器及其作用,分析常见的激活函数(如ReLU、Sigmoid、Tanh)的特点,并通过具体代码演示帮助大家理解它们在神经网络中的应用。

一、感知器(Perceptron):神经网络的基础构建块

感知器是神经网络中最基础的单元,它模拟了生物神经元的工作方式。在感知器中,输入信号通过加权求和后,通过激活函数得到输出信号。

1.1 感知器结构

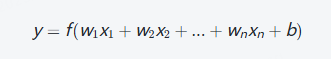

感知器的数学模型如下:

是输入特征

是每个特征的权重

是偏置项

是激活函数,用来引入非线性因素

是感知器的输出

1.2 感知器代码示例

我们来实现一个简单的感知器模型,假设输入是二维数据,权重和偏置固定,激活函数使用Sigmoid函数:

import numpy as np

# 激活函数:Sigmoid

def sigmoid(x):

return 1 / (1 + np.exp(-x))

# 感知器模型

def perceptron(X, weights, bias):

# 计算加权和

linear_output = np.dot(X, weights) + bias

# 激活函数

output = sigmoid(linear_output)

return output

# 测试感知器

X = np.array([0, 1]) # 输入样本

weights = np.array([0.5, -0.5]) # 权重

bias = 0.1 # 偏置

output = perceptron(X, weights, bias)

print(f"感知器输出: {output}")

输出:

感知器输出: 0.549834

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

137

137

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?