在尝试Cherry Studio之前网上对比了腾讯的IMA,IMA容量有限制(现已括到30G),所以选择了前者。据说IMA效果也不错的,后边有时间了试试。

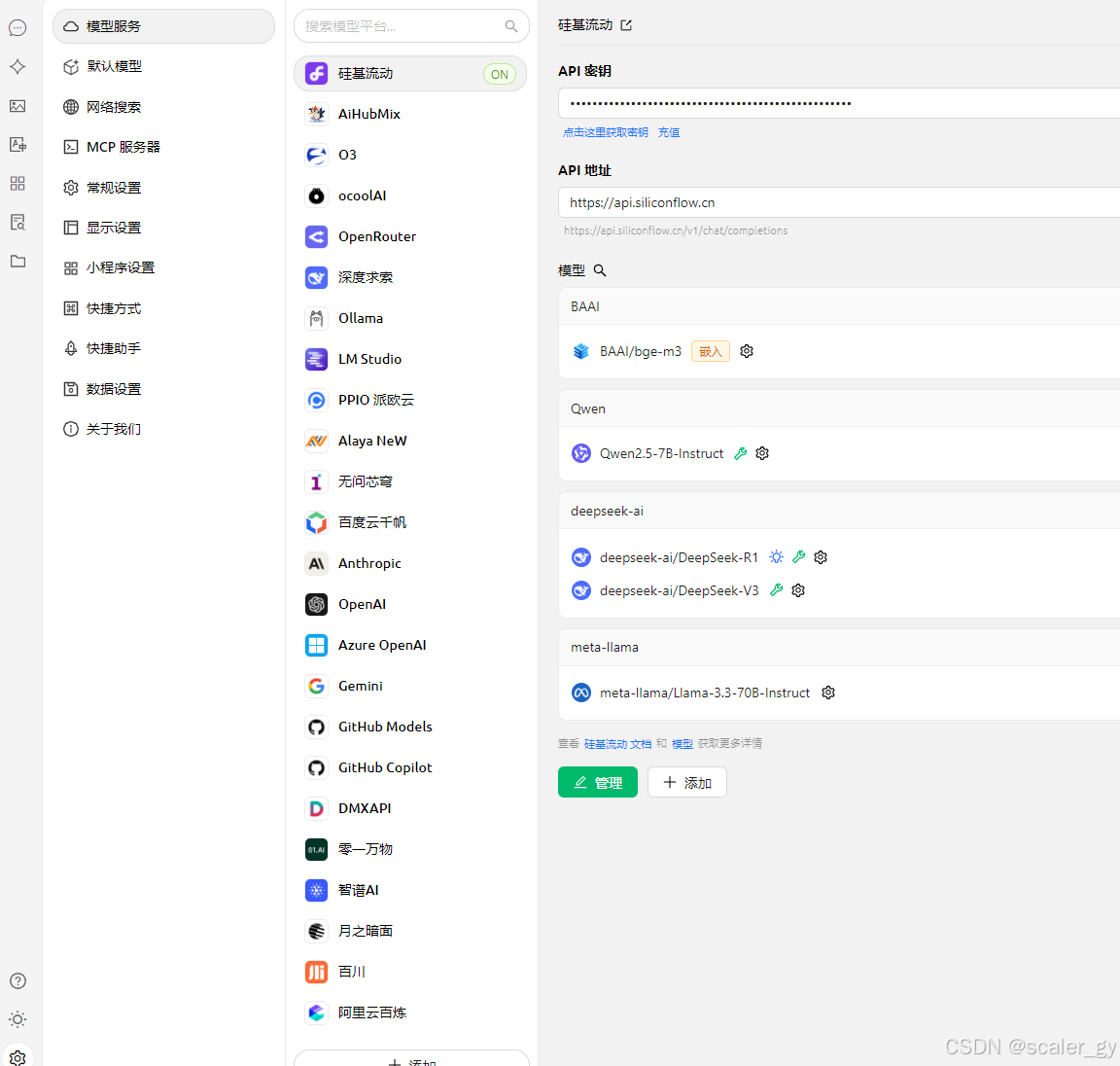

安装过程简单便捷(官网:https://cherry-ai.com/download),安装完后可以方便对接各种在线模型,知识库生成用了硅基流的BAAI/bge-m3。上传本地文件,支持多个类型知识,包括文件、目录、网址、网址、笔记等等。知识库处理很快。推理模型选择了硅基流的DeepSeek-R1。试了下效果,蛮赞的,可以方便使用到本地知识库。可能是网络原因,答案输出过程有点慢。安装起来一个多小时搞定。

对了,要提前申请硅基流的API密钥。如果还没注册的,可以点我这个邀请码注册,双方都可以得到2千万免费token。https://cloud.siliconflow.cn/i/S3xtv6x9

1929

1929

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?