1.介绍

博客hyshhh:重构pointpillar(PCDet)中神经网络部分的代码逻辑中我对pointpillar网络进行了重构,其中因为源代码中定义多层11卷集时用了多层循环网络,外层循环定义33卷集网络,内层循环定义1*1卷集模块。在可观性和实用性有所欠缺。

因此提出了一种可变层卷集,加了一个层数参数以调节1*1层,代码见附录

2.使用方法

在定义模块时定义卷集层

在网络定义函数引入实例化

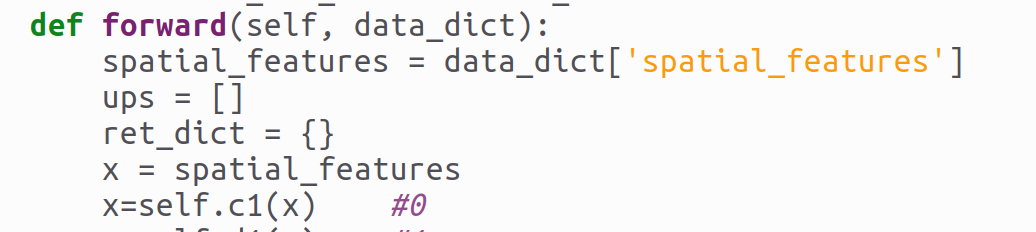

在前向传播中使用

3.附录

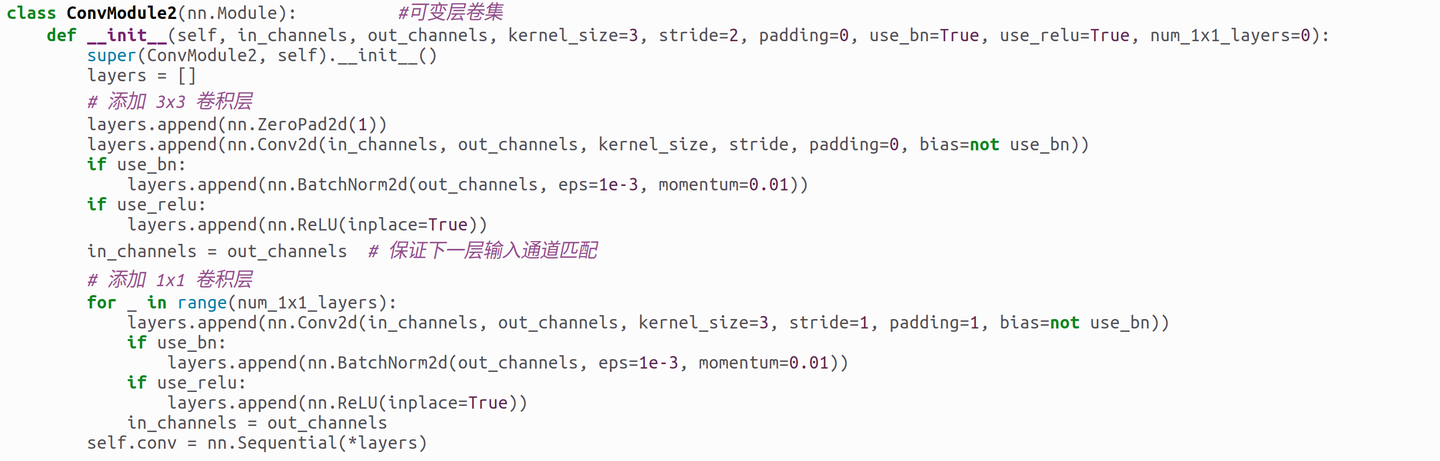

class ConvModule2(nn.Module): #可变层卷集

def __init__(self, in_channels, out_channels, kernel_size=3, stride=2, padding=0, use_bn=True, use_relu=True, num_1x1_layers=0):

super(ConvModule2, self).__init__()

layers = []

# 添加 3x3 卷积层

layers.append(nn.ZeroPad2d(1))

layers.append(nn.Conv2d(in_channels, out_channels, kernel_size, stride, padding=0, bias=not use_bn))

if use_bn:

layers.append(nn.BatchNorm2d(out_channels, eps=1e-3, momentum=0.01))

if use_relu:

layers.append(nn.ReLU(inplace=True))

in_channels = out_channels # 保证下一层输入通道匹配

# 添加 1x1 卷积层

for _ in range(num_1x1_layers):

layers.append(nn.Conv2d(in_channels, out_channels, kernel_size=3, stride=1, padding=1, bias=not use_bn))

if use_bn:

layers.append(nn.BatchNorm2d(out_channels, eps=1e-3, momentum=0.01))

if use_relu:

layers.append(nn.ReLU(inplace=True))

in_channels = out_channels

self.conv = nn.Sequential(*layers)

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?