一、Xtuner微调LLM背景介绍

1、微调模式

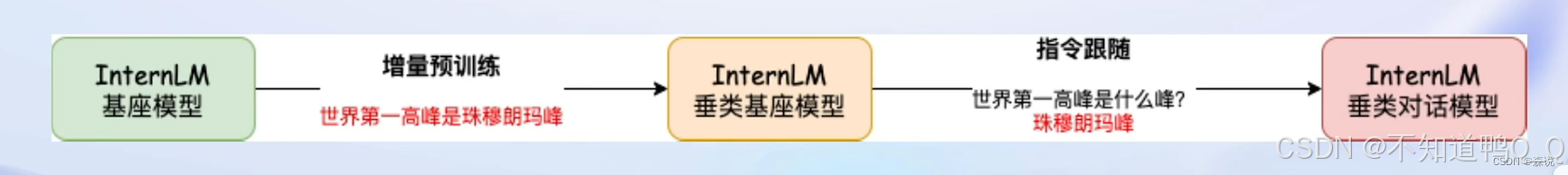

(1)增量训练微调:让基座模型学到一些新知识

(训练数据:文章、书籍、代码)

(2)指令跟随微调:让模型学会对话模板,根据人类指令进行对话

(训练数据:问答数据,高质量对话)

2、微调方法-LoRA、QLoRA

LoRA微调最后训练出来的是一个adapter模型,需要与原来的模型进行整合。QLoRA是LoRA方法的改进,首先将基座模型量化为4-bit

一、Xtuner微调LLM背景介绍

1、微调模式

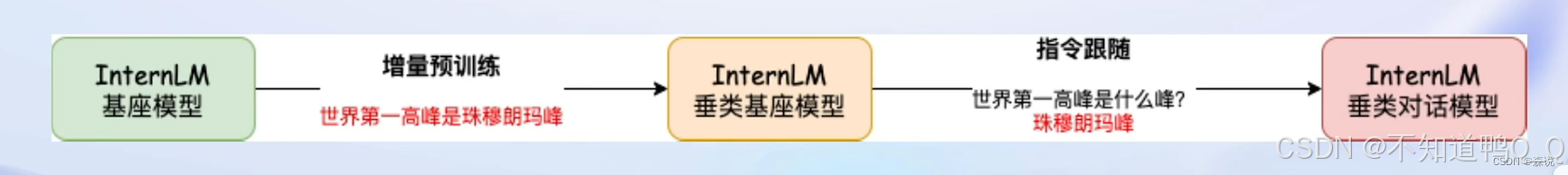

(1)增量训练微调:让基座模型学到一些新知识

(训练数据:文章、书籍、代码)

(2)指令跟随微调:让模型学会对话模板,根据人类指令进行对话

(训练数据:问答数据,高质量对话)

2、微调方法-LoRA、QLoRA

LoRA微调最后训练出来的是一个adapter模型,需要与原来的模型进行整合。QLoRA是LoRA方法的改进,首先将基座模型量化为4-bit

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?