【任务安排】:

Task03:过拟合、欠拟合及其解决方案;梯度消失、梯度爆炸;循环神经网络进阶(1天)

Task04:机器翻译及相关技术;注意力机制与Seq2seq模型;Transformer(1天)

Task05:卷积神经网络基础;leNet;卷积神经网络进阶(1天)

Task03:

过拟合、欠拟合及其解决方案

- 过拟合、欠拟合的概念

- 权重衰减

- 丢弃法

梯度消失、梯度爆炸

- 梯度消失和梯度爆炸

- 考虑到环境因素的其他问题

- Kaggle房价预测

循环神经网络进阶

- 深度卷积神经网络(AlexNet)

- 使用重复元素的网络(VGG)

- ⽹络中的⽹络(NiN)

LeNet、AlexNet和VGG:先以由卷积层构成的模块充分抽取 空间特征,再以由全连接层构成的模块来输出分类结果。

NiN:串联多个由卷积层和“全连接”层构成的小⽹络来构建⼀个深层⽹络。 - GoogLeNet

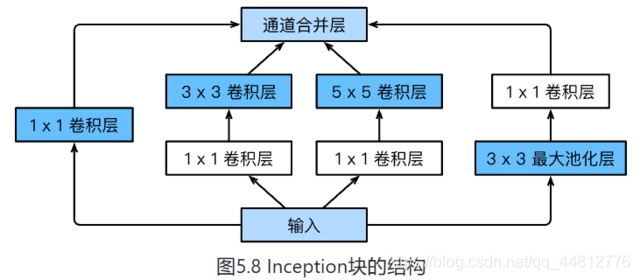

由Inception基础块组成。

Inception块相当于⼀个有4条线路的⼦⽹络。它通过不同窗口形状的卷积层和最⼤池化层来并⾏抽取信息,并使⽤1×1卷积层减少通道数从而降低模型复杂度。

可以⾃定义的超参数是每个层的输出通道数,我们以此来控制模型复杂度。

Task04:

机器翻译及相关技术

机器翻译(MT):将一段文本从一种语言自动翻译为另一种语言,用神经网络解决这个问题通常称为神经机器翻译(NMT)。

主要特征:输出是单词序列而不是单个单词。 输出序列的长度可能与源序列的长度不同。

注意力机制与Seq2seq模型

- 注意力层显式地选择相关的信息。

- 注意层的内存由键-值对组成,因此它的输出接近于键类似于查询的值。

Transformer

- CNNs 易于并行化,却不适合捕捉变长序列内的依赖关系。

- RNNs 适合捕捉长距离变长序列的依赖,但是却难以实现并行化处理序列。

为了整合CNN和RNN的优势,创新性地使用注意力机制设计了Transformer模型。该模型利用attention机制实现了并行化捕捉序列依赖,并且同时处理序列的每个位置的tokens,上述优势使得Transformer模型在性能优异的同时大大减少了训练时间。

Task05:

卷积神经网络基础

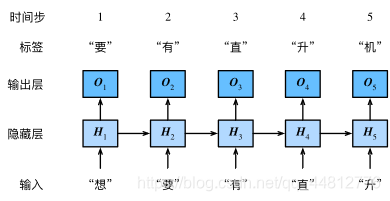

我们的目的是基于当前的输入与过去的输入序列,预测序列的下一个字符。循环神经网络引入一个隐藏变量H,用Ht表示H在时间步t的值。Ht的计算基于Xt和Ht−1,可以认为Ht记录了到当前字符为止的序列信息,利用Ht对序列的下一个字符进行预测。

leNet

卷积神经网络就是含卷积层的网络。 LeNet交替使用卷积层和最大池化层后接全连接层来进行图像分类。

卷积神经网络进阶

RNN存在的问题:梯度较容易出现衰减或爆炸(BPTT)

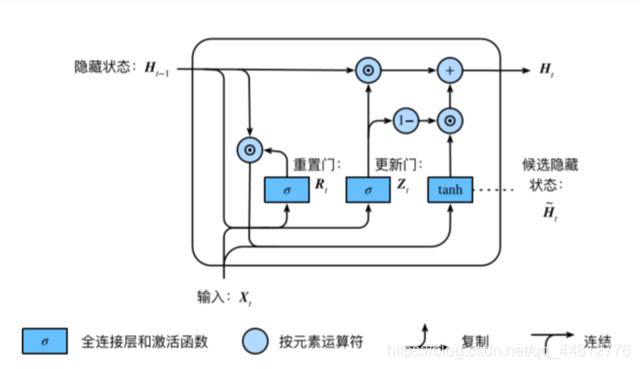

⻔控循环神经⽹络:捕捉时间序列中时间步距离较⼤的依赖关系

GRU:

• 重置⻔有助于捕捉时间序列⾥短期的依赖关系;

• 更新⻔有助于捕捉时间序列⾥⻓期的依赖关系。

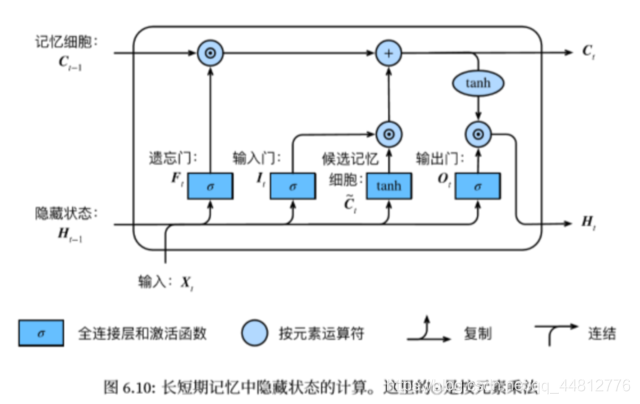

LSTM:

长短期记忆long short-term memory :

遗忘门:控制上一时间步的记忆细胞 输入门:控制当前时间步的输入

输出门:控制从记忆细胞到隐藏状态

记忆细胞:⼀种特殊的隐藏状态的信息的流动

本文深入探讨深度学习关键概念,包括过拟合、欠拟合的解决方案,梯度消失与爆炸问题,循环神经网络(RNN)、卷积神经网络(CNN)及注意力机制等进阶主题。覆盖LeNet、AlexNet、VGG、NiN、GoogLeNet等经典模型,解析机器翻译、Transformer模型原理,以及GRU、LSTM在序列处理中的应用。

本文深入探讨深度学习关键概念,包括过拟合、欠拟合的解决方案,梯度消失与爆炸问题,循环神经网络(RNN)、卷积神经网络(CNN)及注意力机制等进阶主题。覆盖LeNet、AlexNet、VGG、NiN、GoogLeNet等经典模型,解析机器翻译、Transformer模型原理,以及GRU、LSTM在序列处理中的应用。

1263

1263

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?