目录

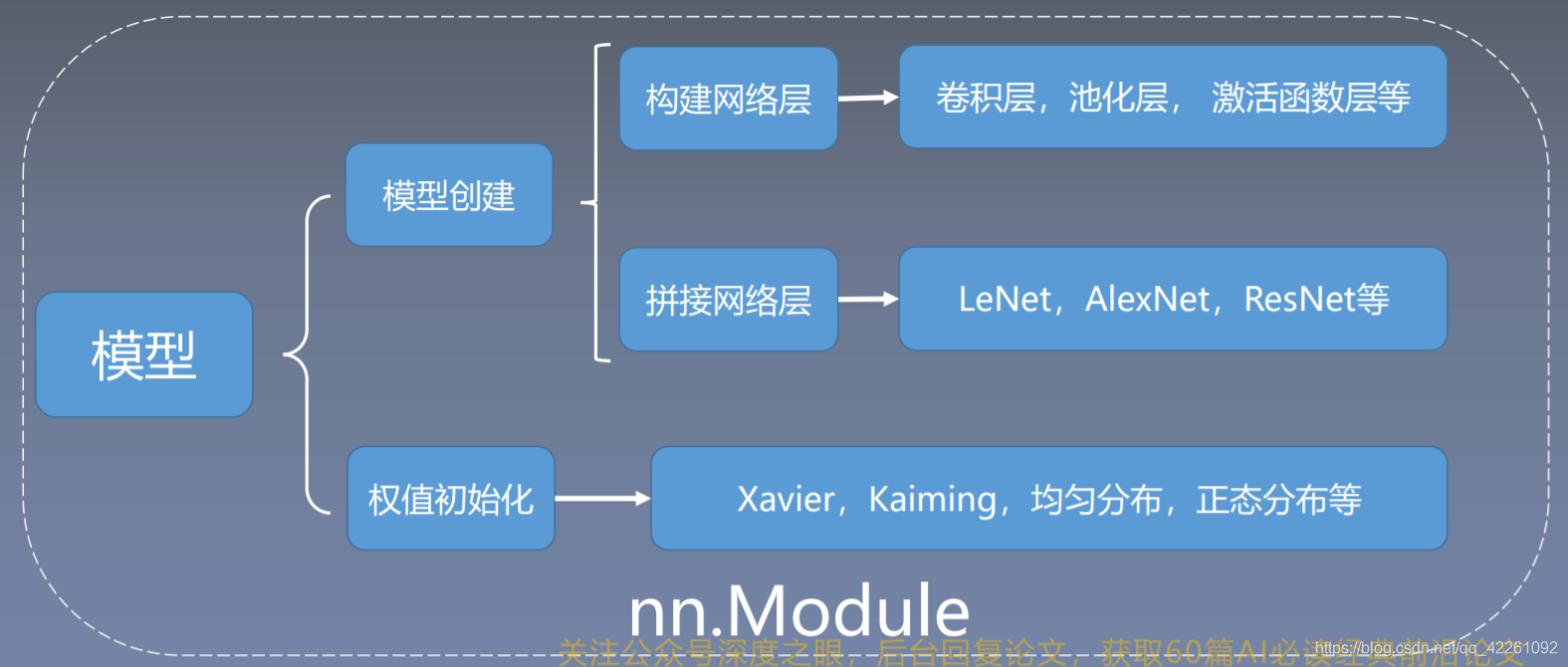

网络模型创建步骤

nn.Module属性

1、网络模型创建步骤

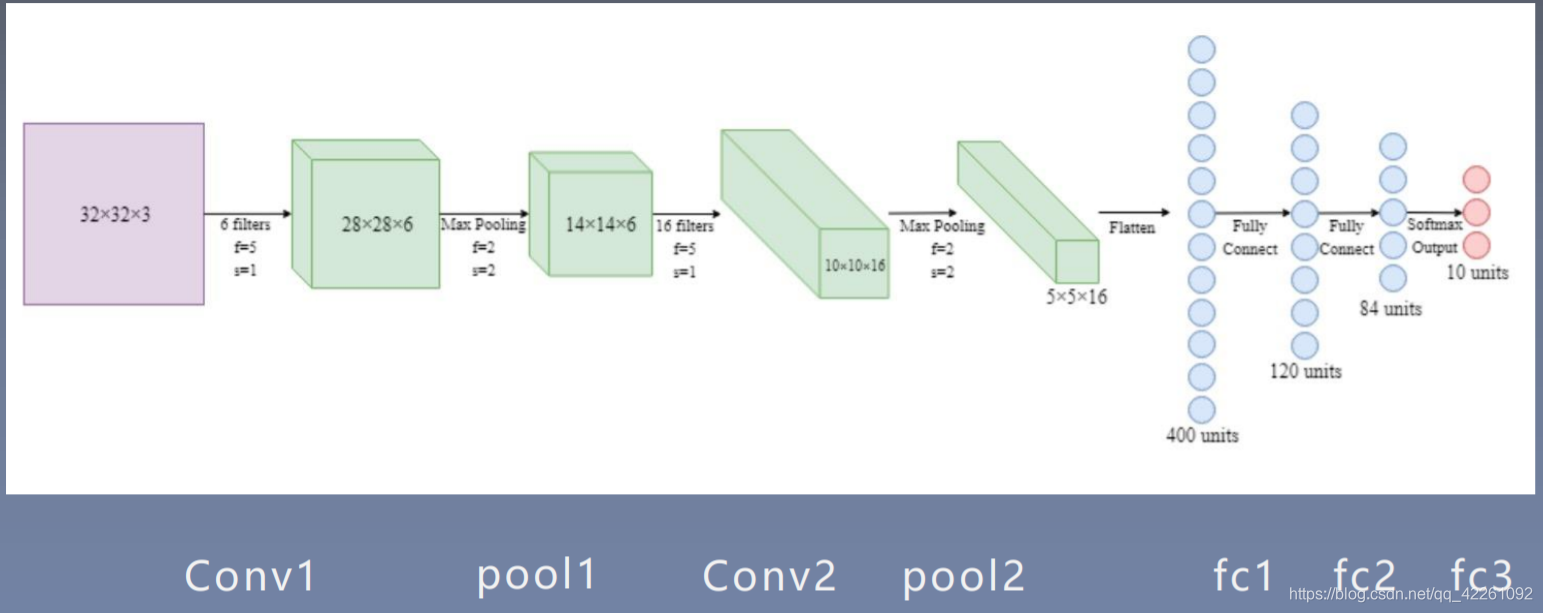

每一个卷积层、池化层和全连接层等都是一些模块(即网络层都是一些子模块);

各网络模型都是由子模块组成的;

节点就是张量数据(在网络模型图中就是正方形的),边就是运算;

-

模型构建的两个要素

构建子模块是在_ _init()_ _中

拼接子模块实际是前向传播的一个实现在forward()中

-

Alexnet网络搭建代码示例

import torchvision

import torch.nn as nn

import torch

from collections import OrderedDict

alexnet_ori = torchvision.models.AlexNet()

print(alexnet_ori._modules['features']._modules.keys())

class AlexNet(nn.Module):

#类的输入参数详见__init__魔法方法的形参

def __init__(self, num_classes=1000):

super(AlexNet, self).__init__()

self.features = nn.Sequential(OrderedDict({

'conv1': nn.Conv2d(3, 64, kernel_size=11, stride=4, padding=2),

'relu1': nn.ReLU(inplace=True),

'maxpool1': nn.MaxPool2d(kernel_size=3, stride=2),

'conv2': nn.Conv2d(64, 192, kernel_size=5, padding=2),

'relu2': nn.ReLU(inplace=True),

'maxpool2': nn.MaxPool2d(kernel_size=3, stride=2),

'conv3': nn.Conv2d(192, 384, kernel_size=3, padding=1),

'relu3': nn.ReLU(inplace=True),

'conv4': nn.Conv2d(384, 256, kernel_size=3, padding=1),

'relu4': nn.ReLU(inplace=True),

'conv5': nn.Conv2d(256, 256, kernel_size=3, padding=1),

'relu5': nn.ReLU(inplace=True),

'maxpool5':nn.MaxPool2d(kernel_size=3, stride=2),

}))

self.avgpool = nn.AdaptiveAvgPool2d((6, 6))

self.classifier = nn.Sequential(OrderedDict({

'dropout1': nn.Dropout(),

'linear1': nn.Linear(256 * 6 * 6, 4096),

'relu1': nn.ReLU(inplace=True),

'dropout2': nn.Dropout(),

'linear2': nn.Linear(4096, 4096),

'relu2': nn.ReLU(inplace=True),

'linear3': nn.Linear(4096, num_classes),

}))

def forward(self, x):

x = self.features(x)

x = self.avgpool(x)

x = torch.flatten(x, 1)

x = self.classifier(x)

return x

alexnet = AlexNet(num_classes=2)

print(alexnet._modules['features']._modules.keys())2、nn.Module属性

-

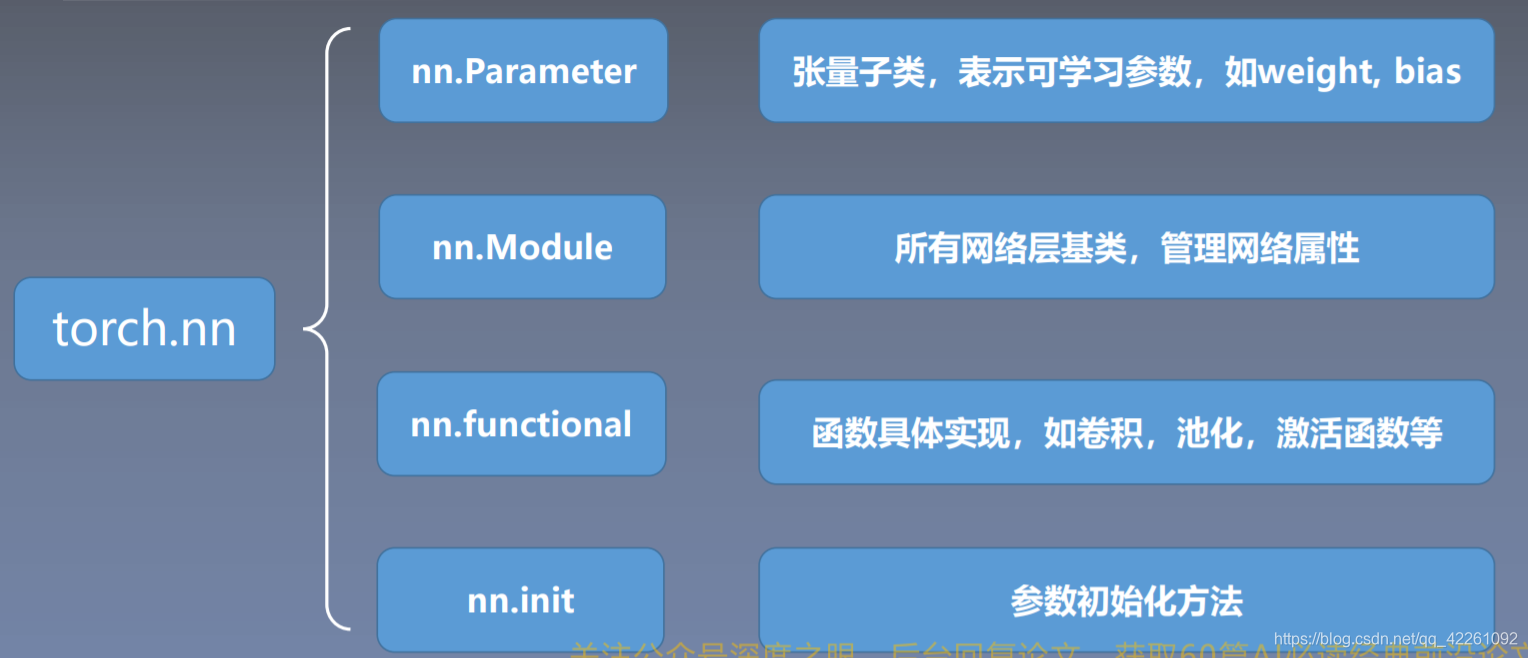

torch.nn是torch的一个神经网络模块

-

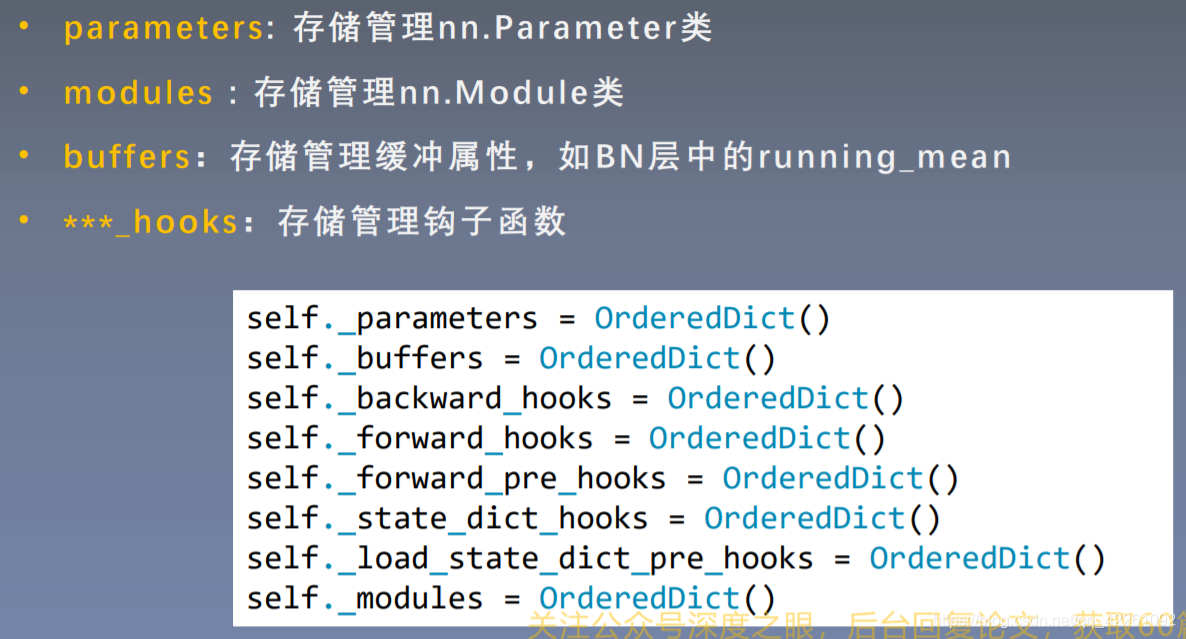

nn.Model类的的8个属性

nn.Module是所有网络层基类,用来管理网络属性。所有的网络模型比如说LeNet模型,包括模型的所有子模块,卷积层、池化层也是一个nn.Module类

-

网络模型继承自nn.Module类,卷积、池化等子模块也继承自nn.Module类

LeNet网络继承自nn.Module类,

例如LeNet是一个大的model类,可以包含多个子模块,例如包含卷积层、池化层等

本文介绍了深度学习网络模型的创建步骤,强调了模型构建的两大要素:子模块的初始化和前向传播实现。通过AlexNet的代码示例展示了如何构建网络结构,并详细解析了nn.Module类的属性及其在构建网络模型中的作用。此外,讨论了网络模型如何通过子模块组合以及张量运算来形成复杂的神经网络结构。

本文介绍了深度学习网络模型的创建步骤,强调了模型构建的两大要素:子模块的初始化和前向传播实现。通过AlexNet的代码示例展示了如何构建网络结构,并详细解析了nn.Module类的属性及其在构建网络模型中的作用。此外,讨论了网络模型如何通过子模块组合以及张量运算来形成复杂的神经网络结构。

2073

2073

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?