Objects as

Points 2019 Xingyi Zhou, Dequan Wang, Philipp Krahenb ¨uhl

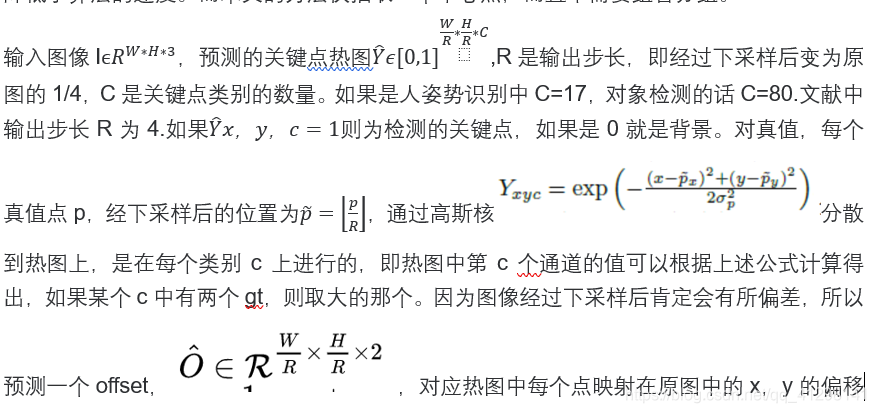

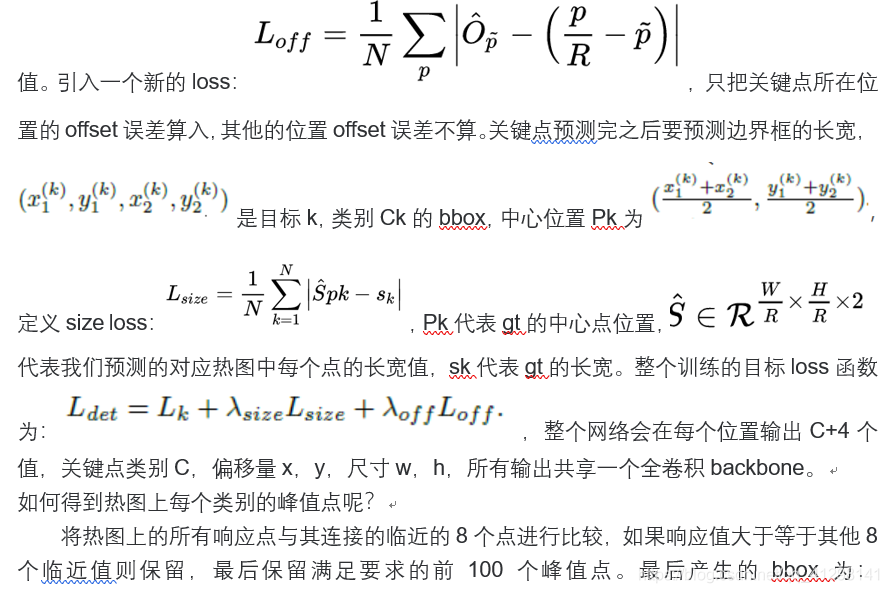

我们在对象的边界框中心用一个点表示对象(参见图2),然后直接从中心位置的图像特征返回其他属性,如对象大小、尺寸、3D范围、方向和姿态。目标检测是一个标准的关键点估计问题。将图像输入到一个完全卷积网络中生成一个热图,热图的峰值对应对象的中心。每个峰值的图像特征预测对象边界框的高度和weight。

本文的方法与基于锚的单步方法密切相关,但有所区别,一:CenterNet分配锚是基于位置的,而不是框重叠。没有手工设置阈值区分前景还是背景 二:每个对象只有一个锚,所以不需要极大值抑制。仅仅在关键点热图中抽取局部峰值。 三。CenterNet使用了一个更大的输出分辨率(输出步长为4),,传统的对象检测输出步长为16.

相关工作:通过区域分类的对象检测:R-CNN,从大量候选区域中枚举对象位置,进行裁剪,再对每个区域proposal使用深度网络。Fast R-CNN,不用裁剪图像特征,节省计算,这两个方法都依赖于低层的区域proposal方法。

使用隐式锚对象检测:Faster R-CNN 使用RPN生成区域建议,与真值框Iou>0.7的标记为前景,<0.3的为背景,其他的忽略,每个生成的区域建议要进行分类。

基于关键点估计的对象检测:CornerNet检测两个边界框的角落作为关键点。ExtremeNet检测所有对象的上,左,下,右,中心点。但是这些方法都需要再关键点之后进行组合分组,降低了算法的速度。而本文的方法仅抽取一个中心点,而且不需要组合分组。

Objects as Points提出以对象边界框中心的点来表示对象,通过深度学习网络预测对象属性。这种方法避免了锚点分配和极大值抑制,提高了检测效率。与R-CNN、Fast R-CNN等传统方法对比,CenterNet使用更高分辨率的输出,简化了检测流程,仅检测中心点,无须后续关键点组合。

Objects as Points提出以对象边界框中心的点来表示对象,通过深度学习网络预测对象属性。这种方法避免了锚点分配和极大值抑制,提高了检测效率。与R-CNN、Fast R-CNN等传统方法对比,CenterNet使用更高分辨率的输出,简化了检测流程,仅检测中心点,无须后续关键点组合。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

625

625

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?