引言

Transformer的自注意力机制可以进行远距离建模,在视觉的各个领域表现出强大的能力。然而在VAN中使用大核分解同样可以得到很好的效果。这也反映了卷积核的发展趋势,从一开始的大卷积核到vgg中采用堆叠的小卷积核代替大卷积核。

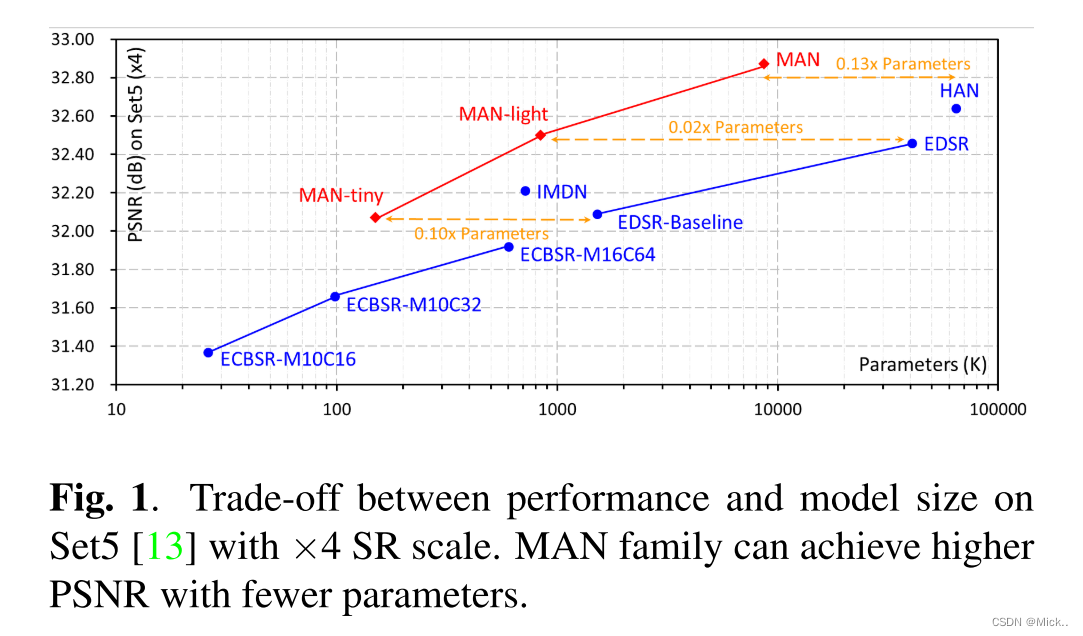

上图展现了MAN网络在同样的性能下具有更少的参数量。

提高模型性能,通常有三种方法:

- 更大的数据集

- 更好的训练策略

- 更好的网络结构

引言部分作者介绍了RCAN,RDN,MSRN的网络结构。作者之所以会提出这样的网络结构是因为:首先,transformer在各个领域大放光彩,但是作者认为transformer中的自注意力机制具有二次复杂度(就是太复杂了)。而出现的VAN(大核注意力机制)简单的堆叠卷积同样可以达到远距离建模的作用。所以作者产生了idea,就是应用VAN中的LKA(大核分解)来组建网络结构。作者为了最大化LKA的作用,作者采取了transformer的结构,而不是应用RCAN的架构。我们都知道transformer中包含了自注意力和MLP。但是作者认为MLP结构太过于复杂,用于低级视觉处理任务有点大材小用&#x

本文提出了一种名为MAN的多尺度注意力网络,用于图像超分辨率任务。MAN采用大内核注意力机制(LKA)和门控空间注意力单元(GSAU),在减少参数量的同时提升模型性能。实验表明,MAN在多个数据集上表现优于现有先进的SR模型。

本文提出了一种名为MAN的多尺度注意力网络,用于图像超分辨率任务。MAN采用大内核注意力机制(LKA)和门控空间注意力单元(GSAU),在减少参数量的同时提升模型性能。实验表明,MAN在多个数据集上表现优于现有先进的SR模型。

订阅专栏 解锁全文

订阅专栏 解锁全文

376

376

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?