本文记录我个人在使用vllm部署私有大模型的时候遇到的困难和详细部署过程。一上来就先给出我测试部署成功的环境组合:

(2024年12月)python3.10 + torch2.5.1 + cuda12.4 + vllm0.6.5

一、环境准备

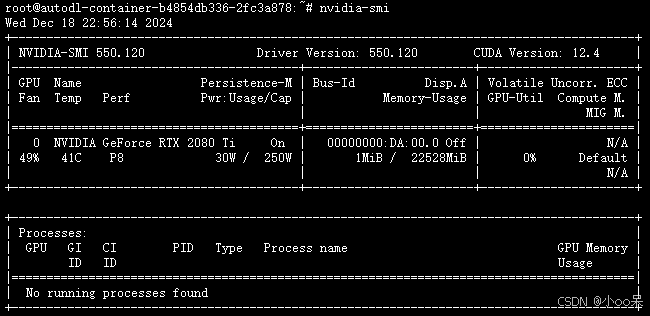

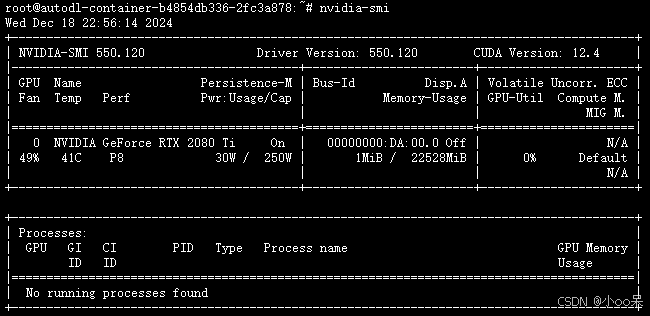

查看一下cuda版本:nvidia-smi

购买的服务器预装什么样的环境都无所谓,只需要cuda是12.4就行。

接下来用conda创建一个虚拟环境:选择Python3.10和torch2.5.1的cuda12.

本文记录我个人在使用vllm部署私有大模型的时候遇到的困难和详细部署过程。一上来就先给出我测试部署成功的环境组合:

(2024年12月)python3.10 + torch2.5.1 + cuda12.4 + vllm0.6.5

查看一下cuda版本:nvidia-smi

购买的服务器预装什么样的环境都无所谓,只需要cuda是12.4就行。

接下来用conda创建一个虚拟环境:选择Python3.10和torch2.5.1的cuda12.

3万+

3万+

3053

3053

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?