【论文解读】:STGAFormer: Spatial-temporal Gated Attention Transformer based Graph Neural Network for Traffic Flow Forecasting

论文链接:https://www.sciencedirect.com/science/article/abs/pii/S156625352400006X

一、引言

交通流量预测是智能交通系统(ITS)中的关键组成部分,尤其是在面对交通流动的动态变化和突发事件时,预测的难度显著增加。本文提出了一种基于图神经网络(GNN)的空间-时间门控注意力变换器(STGAFormer)模型,旨在处理交通流量预测中的这些挑战。

传统的时间序列方法(如ARIMA、VAR)在处理非线性特征和空间拓扑结构复杂的城市交通网络时存在不足。近年来,深度学习尤其是图神经网络(GNN)和变换器(Transformer)的结合,逐渐成为解决这一问题的主流方法。

当前问题:

1.交通流的时空特征呈现出相当大的复杂性。在先前的研究中,在数据嵌入阶段,时间和空间数据被输入到单独的时间和空间模块中进行特征提取,然后进行融合。然而,这种方法不能有效地揭示交通流中复杂的时空关系。此外,许多模型严重依赖于城市网络的预定义结构,如距离邻接矩阵和相似邻接矩阵。这可能会导致交通网络空间特征的提取不足。例如,两个传感器不是物理连接的,而是表现出相似的交通流,或者是连接的,但表现出不同的流,不能用预定义的邻接矩阵来捕获。此外,交通流特征具有明显的周期性。然而,目前的方法要么不考虑周期性,要么基于多个输入周期进行预测,这增加了模型的输入体积,并可能导致模型评估期间的偏差比较。

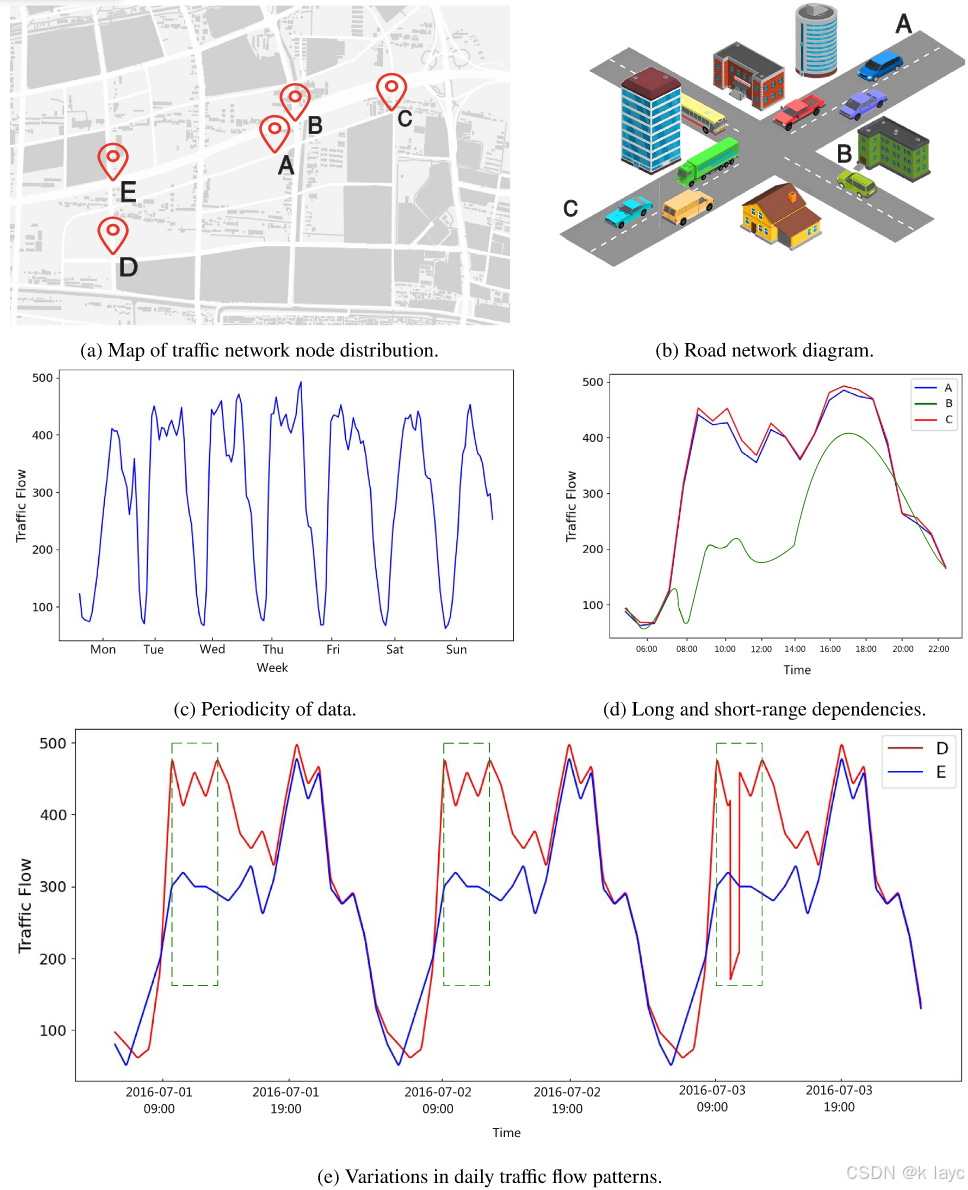

2.交通网络具有空间异质性。如图1(b)和图1(d)所示,尽管A和B接近,但由于位于同一交叉口的不同道路上,它们可能经历明显不同的交通流。同样,即使 A 和 C 彼此相距很远,它们可能在交通流量上表现出显着的相似性,因为它们位于同一道路的上游和下游段上。

3.交通流也表现出时间异质性。如图1(e)所示,两个不同的位置D和E在早上显示不同的流动,但在晚上表现出相似的流动。这表明交通流在空间和时间上都动态变化。此外,以前的大多数模型都没有尝试解释不可预见的交通事件。例如,如图1(e)所示,传感器D在前两天表现出相似的流量变化,但由于位置D的事故,第三天的下午发生了剧烈的变化。当发生此类事件时,它会显着降低我们模型的预测性能,这反映在模型评估指标的波动中。因此,考虑模型设计中突然的交通事故可以显著提高预测精度。

二、模型结构

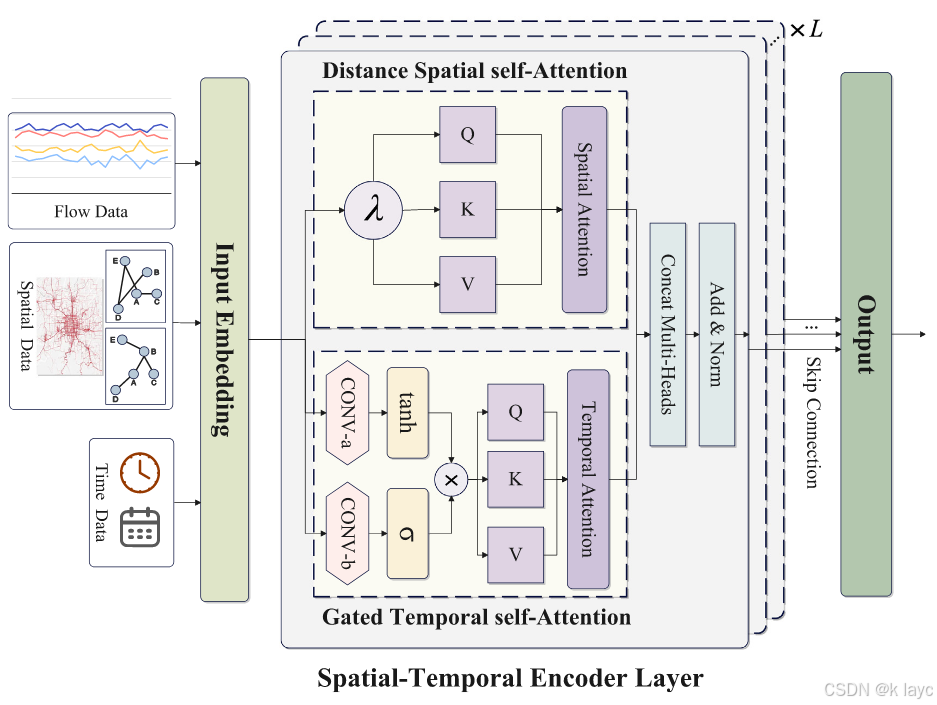

STGAFormer模型的整体架构由三个主要部分组成:

- 输入嵌入层:该层整合了多维数据,包括交通流量特征、时间特征和空间特征,使用卷积操作融合不同维度的信息。

- 空间-时间编码层:该层使用多头自注意力机制(multi-head attention)来分别处理时间和空间特征。关键创新包括门控时间自注意力和距离空间自注意力模块。

- 输出层:该层对空间-时间编码层的输出进行维度调整,并通过跳跃连接(skip connection)和全连接层生成最终预测。

2.1 输入嵌入层

在输入嵌入阶段,模型首先通过全连接层将输入数据转化为高维表示。然后,结合交通网络的邻接矩阵(基于距离和自适应矩阵)进行空间嵌入,同时利用变换器的位置信息进行时间周期性特征嵌入。

公式:

-

自适应邻接矩阵的生成:

A a d p = SoftMax ( ReLU ( E 1 E 2 T ) ) A_{adp} = \text{SoftMax}(\text{ReLU}(E_1 E_2^T)) Aadp=SoftMax(ReLU(E1E2T)) -

网络的拉普拉斯矩阵计算:

Δ = I − D − 1 2 A D − 1 2 \Delta = I - D^{-\frac{1}{2}} A D^{-\frac{1}{2}} Δ=I−D−21AD−21

时序部分包含周期性,也就是划分周和天为周期,形成周的7个特征以及天的一个特征。

因此,总的嵌入层输出为:

x

e

=

x

f

+

x

s

+

x

t

x_e = x_f + x_s + x_t

xe=xf+xs+xt

2.2 空间-时间编码层

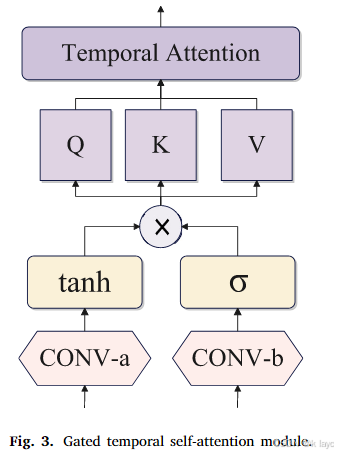

STGAFormer的空间-时间编码层由两个核心模块组成:

-

门控时间自注意力(Gated Temporal Self-Attention):用于提取局部和全局的时间特征。该模块通过过滤器和门控机制来动态调整输入数据,捕捉交通流变化的趋势。

- 公式:

X

t

x

=

filter

⊙

gate

X_{tx} = \text{filter} \odot \text{gate}

Xtx=filter⊙gate

- 公式:

X

t

x

=

filter

⊙

gate

X_{tx} = \text{filter} \odot \text{gate}

Xtx=filter⊙gate

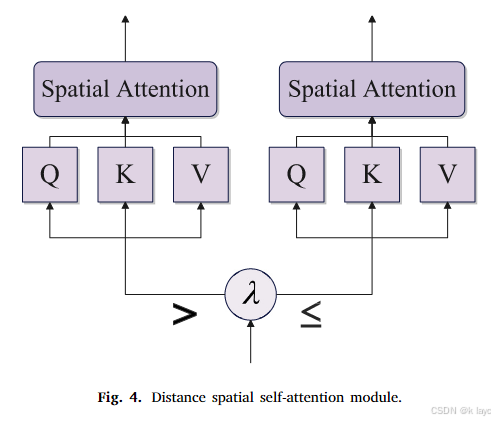

-

距离空间自注意力(Distance Spatial Self-Attention):用于捕捉节点间的空间关系。该模块通过阈值将空间节点分为两类,分别用于提取邻近区域和远距离区域的特征。

- 公式: Z s = ⊕ ( Z s 1 , Z s 2 ) Z_s = \oplus (Z_{s1}, Z_{s2}) Zs=⊕(Zs1,Zs2)

2.3 输出层

输出层负责调整空间-时间编码层的输出维度,并通过跳跃连接和全连接层生成最终的预测结果。采用多步预测策略,以减少预测误差的积累。

三、实验结果

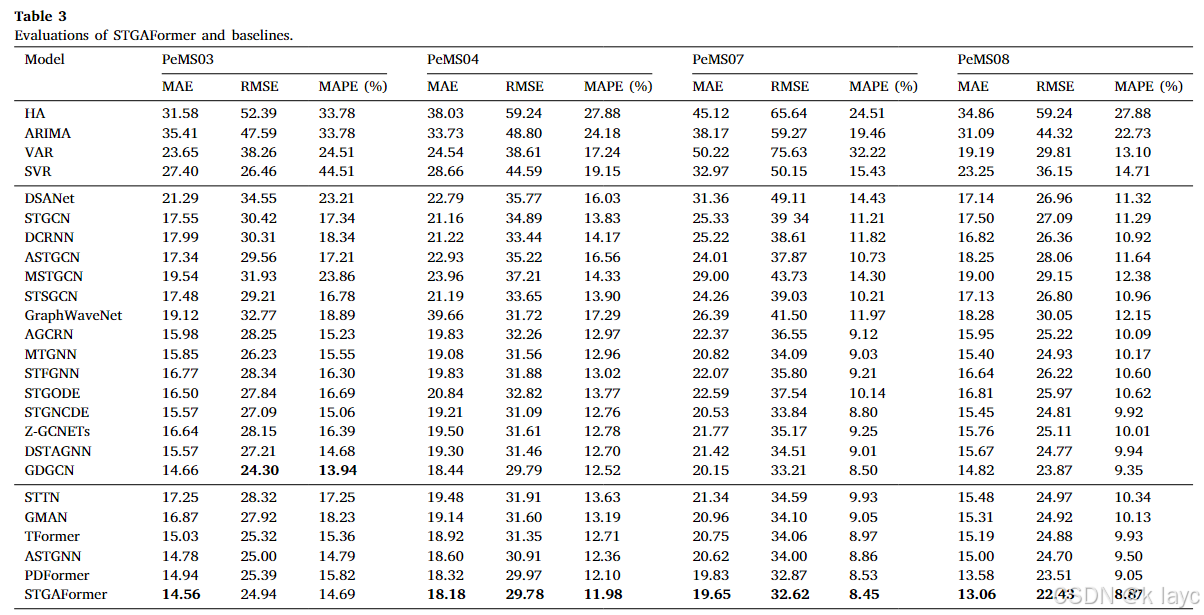

实验在四个公开的真实世界数据集上进行:PeMS03、PeMS04、PeMS07、PeMS08。通过与多种基线模型的比较,STGAFormer在大多数评估指标上表现出色,尤其是在MAE指标上,PeMS08数据集的改进达到3.82%。

3.1 评价指标

使用MAE、MAPE和RMSE作为评估指标:

- MAE(Mean Absolute Error):绝对误差的平均值。

- MAPE(Mean Absolute Percentage Error):绝对百分比误差的平均值。

- RMSE(Root Mean Squared Error):均方根误差。

3.2 比较结果

STGAFormer在各个数据集上的表现都超过了其他基线模型,特别是在处理突发交通事件时,STGAFormer的优势尤为明显。相比之下,基于变换器的模型(如PDFormer)在短期预测上的表现与STGAFormer相当,但在长期预测时,STGAFormer表现更为优越。

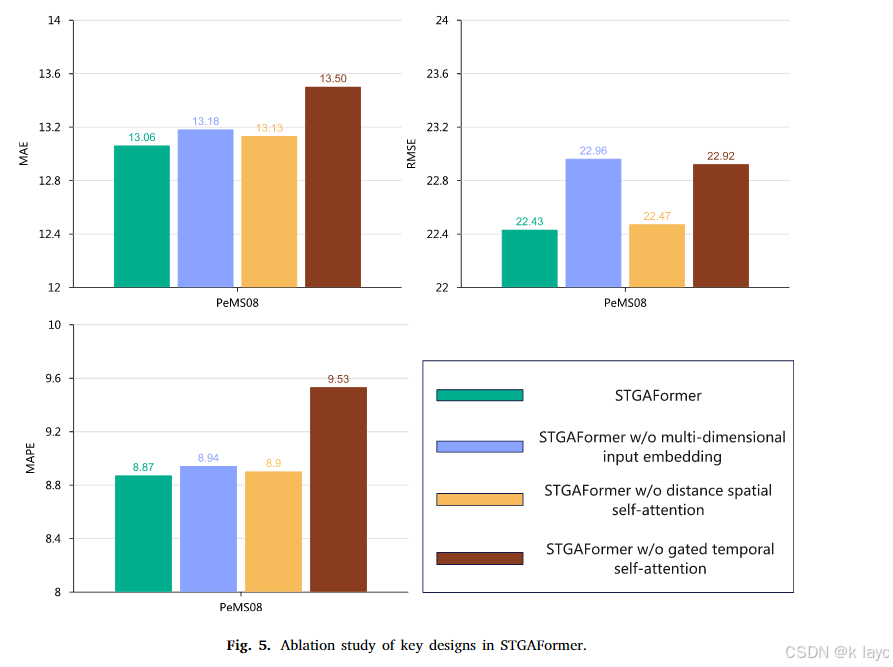

四、创新点总结

- 多维输入嵌入:结合动态图和周期性特征,有效地融合空间-时间特征。

- 距离空间自注意力:通过阈值分割空间节点,精确捕捉远近节点的空间依赖。

- 门控时间自注意力:同时考虑局部和全局时间特征,尤其对于长时间预测和突发事件的适应性强。

五、结论

STGAFormer模型在处理复杂交通流量预测任务时表现出了显著的优势,尤其是在融合空间-时间特征、处理突发事件和长期预测方面。未来的工作将集中在优化模型效率,以便更好地应用于实际的交通管理和规划中。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?